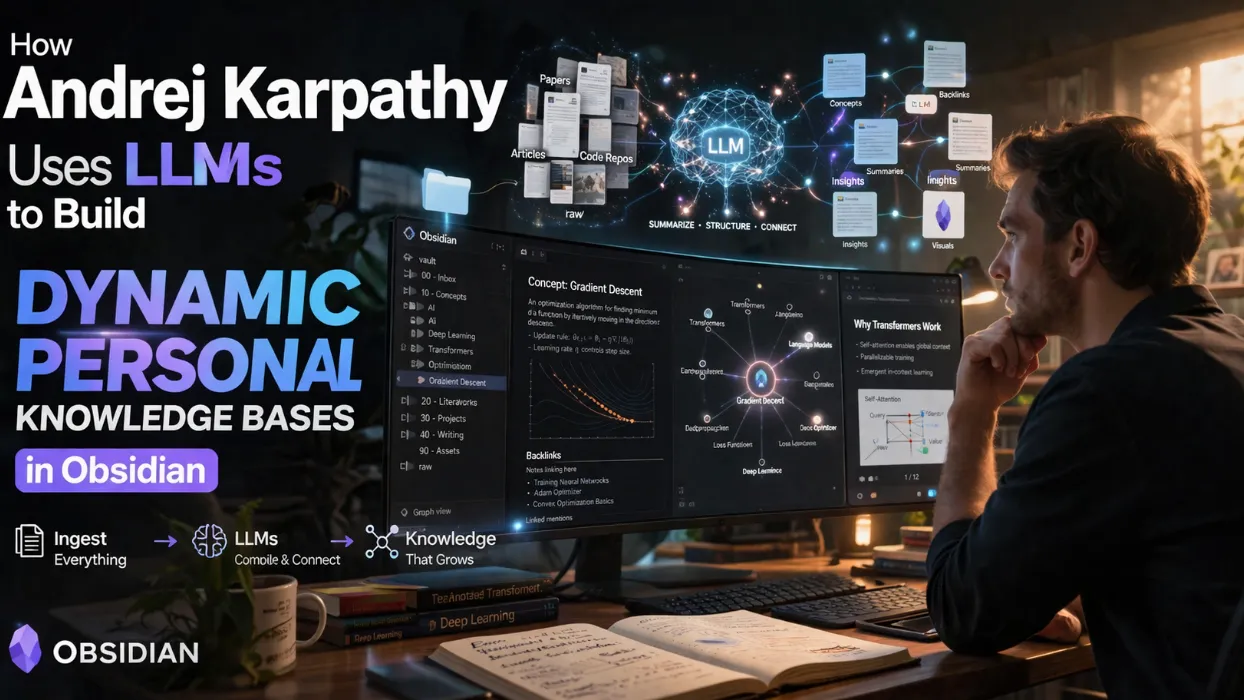

Wie Andrej Karpathy LLMs nutzt, um dynamische persönliche Wissensbasen in Obsidian zu erstellen

Zentrale Erkenntnisse

- Andrej Karpathys System nimmt Rohdokumente (Paper, Artikel, Repos, Bilder) in ein

raw/-Verzeichnis auf und verwendet dann LLMs, um sie schrittweise in ein strukturiertes Markdown-Wiki mit Zusammenfassungen, Rückverweisen, Konzeptartikeln und Verknüpfungen zu kompilieren. - Obsidian dient als leichtgewichtige Frontend-Anwendung zum Betrachten von Rohdaten, kompiliertem Wiki und generierten Ausgaben wie Marp-Folien oder Matplotlib-Plots, wobei das LLM fast das gesamte Schreiben und die Wartung übernimmt.

- Bei größeren Umfängen (~100 Artikel, ~400K Wörter) erfolgen komplexe Q&A-Interaktionen mit minimaler RAG-Abhängigkeit; das LLM hält Indizes und Zusammenfassungen automatisch für effizienten Kontextabruf aktuell.

- Linting über LLM-Health-Checks identifiziert Inkonsistenzen, ergänzt fehlende Daten, schlägt Verbindungen vor und regt neue Artikel an, um die Datenintegrität sicherzustellen.

- Die Ausgaben gehen über Text hinaus und umfassen gerendertes Markdown, Folien, Visualisierungen oder dynamisches HTML, die oft wieder ins Wiki eingepflegt werden, um Wissen im Laufe der Zeit zu verdichten.

- Die Annahme in der Community hebt Erweiterungen hervor wie die Trennung von Agenten zur Kontaminationskontrolle, synthetische Daten für Feinabstimmung und kurzlebige Wikis, die pro Anfrage erstellt werden.

Der Wandel von Code zur Wissensmanipulation

Analysen zeigen eine grundlegende Veränderung in der Token-Zuweisung: aktuelle Frontier-LLMs übertreffen in der Wissenssynthese gegenüber reiner Codegenerierung. Karpathy berichtet, dass ein großer Teil seines Token-Durchsatzes nun strukturiertes Wissen manipuliert, das als Markdown-Dateien und Bilder gespeichert ist, anstatt flüchtiger Terminal-Ausgaben.

Dieser Arbeitsablauf verwandelt passiven Forschungsverbrauch in eine aktive, sich selbst verbessernde Wissensbasis. Rohquellen sammeln sich in einem dedizierten Verzeichnis an. Ein LLM "kompiliert" sie dann schrittweise – erstellt Zusammenfassungen, kategorisiert Inhalte in Konzepte, verfasst verlinkte Artikel und legt Rückverweise an.

Benchmarks aus ähnlichen persönlichen Systemen deuten darauf hin, dass, sobald ein Wiki eine kritische Masse erreicht, die Anfragekomplexität dramatisch skaliert, ohne dass der Retrieval-Aufwand proportional steigt.

Datenaufnahme und Kompilierungsprozess

Die Pipeline beginnt mit gezielter Sammlung:

-B Quellenverarbeitung: Forschungspaper, Artikel, GitHub-Repos, Datensätze und Bilder landen in raw/. Webinhalte werden über den Obsidian Web Clipper in Markdown konvertiert, Bilder werden lokal heruntergeladen, um direkten LLM-Referenzen zu dienen.

- Inkrementelle Kompilierung: LLMs verarbeiten neue Dokumente zunächst einzeln, dann mit Mustererkennung für Effizienz. Anweisungen wie "füge dieses neue Dokument in unser Wiki ein" lösen Kategorisierung, Zusammenfassung und Verlinkung aus.

- Strukturerstellung: Das resultierende Wiki enthält:

- Dokument-spezifische Zusammenfassungen

- Konzept-basierte Artikel

- Bidirektionale Rückverweise

- Verzeichnis-basierte Organisation

Feedback aus der Community deutet darauf hin, dass Stapelverarbeitung oder mehrstufige Pipelines die Verzeichnisentscheidungen bei größeren Aufnahmen verbessern, obwohl Karpathy die frühen Phasen für die Qualitätskontrolle mit menschlicher Einbindung gestaltet.

Obsidian als ideales Frontend

Obsidian fungiert als minimalistische "IDE" für das System:

Gleichzeitige Ansichten von Rohquellen, kompiliertem Wiki und Visualisierungen.

- Plugins wie Marp ermöglichen direkte Folienrendering aus LLM-generiertem Markdown.

-Mit Grafikansichten und Backlink-Navigation lassen sich emergente Verbindungen aufdecken.

Experten weisen darauf hin, dass Obsidians lokale Markdown-Basis Lock-in-Effekte minimiert, während es benutzerdefinierte Tools unterstützt. Alternativen wie VS Code mit Markdown-Erweiterungen existieren, aber Obsidians Ökosystem beschleunigt visuelle und interaktive Erkundung.

In Community-Implementierungen zeigen sich Trennungsszenarien: Man bewahrt ein persönliches Vault mit hohem Signalwert parallel zu einem agentenorientierten "unordentlichen" Vault, um Kontamination durch generierte Inhalte zu vermeiden.

Fortgeschrittene Q&A und Output-Generierung

Skaliert unterstützt das Wiki anspruchsvolles Abfragen:

-

LLMs navigieren das gesamte Korpus und nutzen selbst-gewartete Indizes und Zusammenfassungen.

-

Bei ~400K Wörtern verarbeiten Kontextfenster verwandte Cluster effizient ohne aufwändige Vector-RAG.

-

Outputs passen sich Bedürfnissen an: Markdown-Berichte, Marp-Präsentationen, Matplotlib-Diagramme oder sogar dynamisches HTML/JS für interaktive Filterung und Visualisierungen.

Generierte Artefakte fließen oft zurück ins Wiki und schaffen einen selbstverstärkenden Kreislauf, in dem Erkundungen zukünftige Abfragen verbessern. Lex Fridman und andere berichten von ähnlichen Setups für Podcast-Recherche oder unterwegs-Sprachinteraktionen via temporärer Mini-Wikis.

LLM-gesteuertes Linting und Wartung

Ein herausstechendes Merkmal sind automatisierte "Health Checks":

-"Erkenne inkonsistente Aussagen über Quellen hinweg, die Wochen auseinander aufgenommen wurden.

-"Fülle Lücken mit Web-Such-Tools.

-"Identifiziere neuartige Verbindungen und Kandidaten-Artikel.

-"Schlage Folgefragen vor, um die Abdeckung zu vertiefen.

Dies verwandelt das Wiki von einem statischen Repository in einen lebendigen Forschungspartner. Das Risiko veralteter Daten steigt mit dem Wachstum; versionierte Audits und inkrementelle Updates mildern Drift effektiver als einmalige Aufnahmen.

Aufkommende Tools und zukünftige Erkundungen

Nutzer erweitern den Kern mit:

-"Benutzerdefinierten CLIs oder einfachen Suchmaschinen, die LLMs als Tools übergeben werden.

-"Synthetischer Datengenerierung gepaart mit Fine-Tuning, um Wiki-Wissen in Modellgewichte einzubetten.

-"Ephemerer Wiki-Generierung: Eine einzelne Abfrage erzeugt eine vollständige, gelintete, iterierte Wissensbasis vor dem finalen Bericht – weit über einfaches Decoding hinaus.

In der Community geteilte Architekturdiagramme visualisieren Phasen von der Aufnahme über Kompilierung, Abfrage und Verbesserung. Produkte, die dies für Nicht-Entwickler überbrücken, stellen eine klare Chance dar, da jede Organisation unstrukturierte "raw/"-Daten pflegt, die auf Kompilierung warten.

Vergleiche mit traditionellen PKMs (Persönlichem Wissensmanagement) heben Vorteile hervor: LLM-Automatisierung reduziert manuelle Kuratierung um 80–90% in aktiven Forschungsdomänen, während Backlinks und Graphen Erkenntnisse aufdecken, die Menschen übersehen könnten.

Herausforderungen und bewährte Praktiken

- Skalierungsmanagement: Zusammenfassungen können veralten; priorisieren Sie frische Differenzen und Audits.

- Kontaminationskontrolle: Isolieren Sie von Agenten generierte Inhalte bis zur Überprüfung.

- Inkrementelle Einführung: Beginnen Sie klein, lassen Sie Muster entstehen, bevor Sie vollständige Autonomie gewähren.

- Einfache Tooling: Flache Markdown-Verzeichnisse mit

AGENTS.md-Schemas reichen aus; Over-Engineering verzögert den Mehrwert.

Aktionsfähige Erkenntnis: Beginnen Sie mit einem Forschungsthema. Sammeln Sie 10–20 Quellen, lassen Sie ein LLM das initiale Wiki kompilieren, und iterieren Sie dann Anfragen und Linting. Messen Sie den Mehrwert anhand der Anfragentiefe und der eingesparten Zeit im Vergleich zu traditioneller Suche/Notizenaufnahme.

Fazit

Andrej Karpathys LLM-gestützter Wissensdatenbank-Workflow markiert eine praktische Evolution in der Art und Weise, wie Forscher und Praktiker mit Informationen interagieren. Indem die Kompilierung, Wartung und Synthese fähigen Modellen delegiert wird, während Obsidian für intuitive Interaktion erhalten bleibt, erreichen Nutzer ein tieferes Verständnis mit geringerer Reibung.

Dieser Ansatz verstärkt sich mit der Zeit: Jede Anfrage stärkt die Basis, jeder Linting-Durchlauf erhöht die Integrität. Mit dem Fortschritt von Frontier-Modellen können umfassendere Tools erwartet werden, die ganze ephemerale Wikis aus natürlichen Fragen automatisieren.

Implementieren Sie noch heute eine minimale Version – nehmen Sie Ihre nächste Forschungsgruppe auf und lassen Sie ein LLM das Fundament bauen. Der Wechsel vom Konsumieren von Wissen zum aktiven Kultivieren könnte persönliche und organisatorische Intelligenz im agentenbasierten Zeitalter neu definieren.

Beginnen Sie klein, iterieren Sie unermüdlich und beobachten Sie, wie Ihr persönliches Wiki zu einem echten intellektuellen Multiplikator wird.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Anthropic Mythos AI Unbefugter Zugang: Wie eine Discord-Gruppe das 'zu gefährliche' Cybersicherheitsmodell geknackt hat

Wie man 'Computer Use Plugin Unavailable' in der OpenAI Codex App behebt

Was ist OmniShow? Das KI-Framework, das die Generierung von Human-Object-Interaction-Videos revolutioniert

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.