¿Qué es LongCat-Next? El revolucionario modelo nativo multimodal de IA de Meituan explicado

Puntos Clave

- LongCat-Next es un modelo base multimodal nativo de código abierto desarrollado por el equipo LongCat de Meituan, lanzado en marzo de 2026.

- Unifica texto, visión (imágenes) y audio en un único espacio de tokens discretos utilizando el paradigma de Autoregresión Nativa Discreta (DiNA) y la predicción del siguiente token (NTP).

- Construido sobre la arquitectura principal LongCat-Flash-Lite MoE (A3B: ~68.500 millones de parámetros totales, 3.000 millones activos), es compatible con comprensión y generación entre modalidades con un sesgo inductivo mínimo.

- Las innovaciones clave incluyen el tokenizador dNaViT (Transformador de Visión Nativa Discreta de cualquier resolución), que permite una alta compresión (hasta 28×) manteniendo la calidad, especialmente en la representación de texto.

- Los benchmarks muestran un rendimiento competitivo frente a modelos especializados en comprensión visual, generación de imágenes, comprensión del habla e interacción vocal de baja latencia.

- Totalmente de código abierto bajo la licencia MIT en Hugging Face y GitHub, con código de inferencia y una demostración en vivo disponible.

¿Qué es LongCat-Next?

LongCat-Next representa un cambio significativo en la arquitectía de IA multimodal. A diferencia de los sistemas tradicionales "parcheados" que acoplan codificadores visuales o módulos de habla a un núcleo de modelo de lenguaje, este modelo trata todas las modalidades como elementos nativos dentro de un único marco unificado.

Desarrollado por el equipo LongCat de Meituan, LongCat-Next lexicaliza las modalidades como tokens discretos. Las imágenes, formas de onda de audio y texto se tokenizan en un vocabulario compartido, permitiendo al modelo procesarlas y generarlas usando el mismo objetivo autoregresivo: predecir el siguiente token.

Este enfoque de Autoregresión Nativa Discreta (DiNA) minimiza la complejidad arquitectónica y los sesgos inductivos más allá del paradigma de modelado del lenguaje. El resultado es un sistema más elegante y escalable capaz de verdaderas capacidades multimodales de cualquiera a cualquiera.

Arquitectura Central e Innovaciones Técnicas

Autoregresión Nativa Discreta (DiNA)

En esencia, LongCat-Next extiende el paradigma de predicción del siguiente token a todas las modalidades. Tokenizadores emparejados convierten las entradas en ID discretos:

- Texto: Tokenización estándar de subpalabras.

- Visión: Procesada mediante dNaViT — un Transformador de Visión Nativa Discreta de cualquier resolución que maneja tamaños de imagen variables sin artefactos de parcheo fijo o redimensionado.

- Audio: Convertido en tokens discretos compatibles con comprensión, generación y conversación de baja latencia.

Todos los tokens se alimentan a una arquitectura principal MoE (Mezcla de Expertos) compartida. Esto permite razonamiento multimodal cruzado sin problemas, como describir una imagen mientras se genera audio relacionado o viceversa.

Escala y Eficiencia del Modelo

- Columna Vertebral: LongCat-Flash-Lite MoE con aproximadamente 68.5 mil millones de parámetros totales y 3 mil millones de parámetros activos por paso de inferencia.

- Eficiencia: El enfoque de tokens discretos y el diseño MoE mantienen la inferencia ligera en comparación con modelos densos de capacidad similar.

- Compresión: Logra una fuerte calidad generativa con altas tasas de compresión (por ejemplo, 28× para imágenes), destacándose especialmente en la representación precisa de texto dentro de los elementos visuales generados.

La arquitectura soporta tanto la comprensión multimodal (por ejemplo, respuesta a preguntas visuales, transcripción de voz con contexto) como la generación (por ejemplo, texto a imagen, edición de imágenes a través de tokens, síntesis de voz).

Rendimiento y Evaluaciones

El análisis de los informes técnicos publicados y las evaluaciones de la comunidad indica que LongCat-Next ofrece resultados de nivel industrial en múltiples dominios:

- Comprensión Visual: Competitivo con modelos especializados de visión y lenguaje en evaluaciones que involucran escenas complejas, documentos y entradas de cualquier resolución. Maneja de manera efectiva fórmulas matemáticas densas, imágenes con mucho OCR y fotografías del mundo real.

- Generación de Imágenes: Mantiene una alta fidelidad y coherencia, con una notable fortaleza en la representación de texto legible dentro de las imágenes — una debilidad común en muchos sistemas multimodales.

- Audio/Voz: Destaca en la comprensión avanzada del habla, conversaciones de voz de baja latencia y clonación de voz personalizable. Soporta interacciones multimodales naturales, como hablar mientras se referencia contenido visual.

- Tareas Transmodales: Fuerte rendimiento en tareas unificadas, como la generación de subtítulos para imágenes con descripciones de audio o la creación de elementos visuales a partir de indicaciones habladas.

Las evaluaciones lo posicionan como altamente competitivo dentro de los marcos discretos, a menudo igualando o acercándose a sistemas más grandes o especializados mientras ofrece una mayor simplicidad arquitectónica.

Los comentarios de la comunidad sugieren ventajas particulares en casos extremos del mundo real, como el escaneo de documentos con poca luz o los diálogos de modalidad mixta.

Cómo Difiere LongCat-Next de los Modelos Multimodales Tradicionales

La mayoría de los modelos de lenguaje multimodal grandes (MLLMs) actuales dependen de un núcleo centrado en el lenguaje con codificadores auxiliares:

- Los datos visuales se proyectan en el espacio de incrustaciones del LLM a través de adaptadores o atención cruzada.

- Los módulos de audio a menudo son flujos de trabajo separados.

Esto crea desafíos de alineación, aumenta la latencia y genera inestabilidades en el entrenamiento.

Ventajas de LongCat-Next:

- Espacio de Tokens Unificado: Todas las modalidades se convierten en "lenguaje nativo" para el modelo, reduciendo las brechas entre modalidades.

- Objetivo Único: La predicción pura del siguiente token en todo simplifica el entrenamiento y la escalabilidad.

- Sesgo Reducido: Inducción de sesgos adicionales mínima más allá de la autorregresión.

- Simplicidad de Despliegue: La columna vertebral compartida facilita la optimización de la inferencia y el servicio multimodal.

Este cambio de paradigma busca acercar la IA a la gestión de las señales entrelazadas del mundo físico (vista, sonido, texto) de manera cohesiva.

Comenzando con LongCat-Next

Acceso y Recursos

- Hugging Face: meituan-longcat/LongCat-Next — pesos del modelo, safetensors e integración con Transformers.

- GitHub: Repositorio completo que incluye código de inferencia, implementación modular e informe técnico en PDF.

- Demo: Experiencia interactiva en longcat.chat/longcat-next.

- Licencia: MIT — adecuada para investigación y aplicaciones comerciales.

Consejos de Uso Básico

El modelo admite las tuberías estándar de Transformers con extensiones personalizadas para entradas multimodales. Ejemplos de patrones de código (del repositorio):

# Pseudocódigo para inferencia multimodal

from transformers import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained("meituan-longcat/LongCat-Next")

# Tokenizar entradas mixtas (texto + imagen + audio)

inputs = tokenizer.process_multimodal(prompt, image=image_tensor, audio=audio_tensor)

outputs = model.generate(inputs)

Consejos Avanzados:

- Utilice dNaViT para imágenes de cualquier resolución para evitar pérdida de calidad al redimensionar.

- Para tareas de generación, experimente con control a nivel de token para una mejor consistencia multimodal.

- Use cuantización (por ejemplo, versiones de 4 bits disponibles en repositorios de la comunidad) para implementación en hardware de consumo.

Errores Comunes y Casos Especiales

- Gestión del Presupuesto de Tokens: Las entradas de audio largas o de alta resolución consumen más tokens; priorice regiones clave o use estrategias de compresión.

- Alineación Multimodal: Aunque está unificada, las tareas intercaladas complejas pueden requerir una cuidadosa ingeniería de prompts para una coherencia óptima.

- Optimización de Inferencia: Los modelos MoE se benefician de configuraciones de paralelismo de expertos; consulte el repositorio de inferencia dedicado para mejores prácticas.

- Consideraciones de Hardware: La precisión completa requiere una cantidad significativa de VRAM; comience con variantes cuantizadas para pruebas.

Monitoree las discusiones de la comunidad para conocer técnicas de ajuste fino emergentes y adaptaciones específicas a la aplicación.

Aplicaciones Potenciales e Implicaciones Futuras

LongCat-Next abre las puertas a sistemas de IA más integrados:

- Agentes del Mundo Real: Robots o aplicaciones que perciben imágenes, procesan voz y responden multimodalmente en un solo modelo.

- Herramientas Creativas: Generación unificada de imagen+audio+texto para creación de contenido.

- Accesibilidad: Comprensión mejorada de documentos con interacción por voz.

- IA del Mundo Físico: Un paso hacia modelos que tratan las entradas sensoriales con tanta fluidez como el lenguaje.

Como lanzamiento de código abierto, invita a los desarrolladores a crear extensiones, ajustes finos y variantes específicas del dominio, acelerando el progreso multimodal.

Conclusión

LongCat-Next se destaca como un avance reflexivo en el modelado multimodal nativo. Al unificar las modalidades bajo un marco autorregresivo discreto, simplifica la arquitectura mientras ofrece un rendimiento competente en ver, crear y hablar.

Para desarrolladores, investigadores y entusiastas de la IA, este modelo de código abierto proporciona una base práctica para experimentar con capacidades verdaderamente de cualquier-a-cualquier. Explora el repositorio de Hugging Face, revisa el informe técnico y prueba la demo en vivo para experimentar de primera mano el paradigma DiNA.

Comienza a construir con LongCat-Next hoy y contribuye al panorama en evolución de la IA multimodal unificada.

¿Listo para sumergirte? Visita la demo oficial o clona el repositorio de GitHub para empezar a experimentar.

Continue Reading

More articles connected to the same themes, protocols, and tools.

¿Qué es OC Maker? La Herramienta de IA que Revoluciona la Creación de Personajes Originales en 2026

Acceso No Autorizado al Anthropic Mythos AI: Cómo un Grupo de Discord Infringió el Modelo de Ciberseguridad 'Demasiado Peligroso'

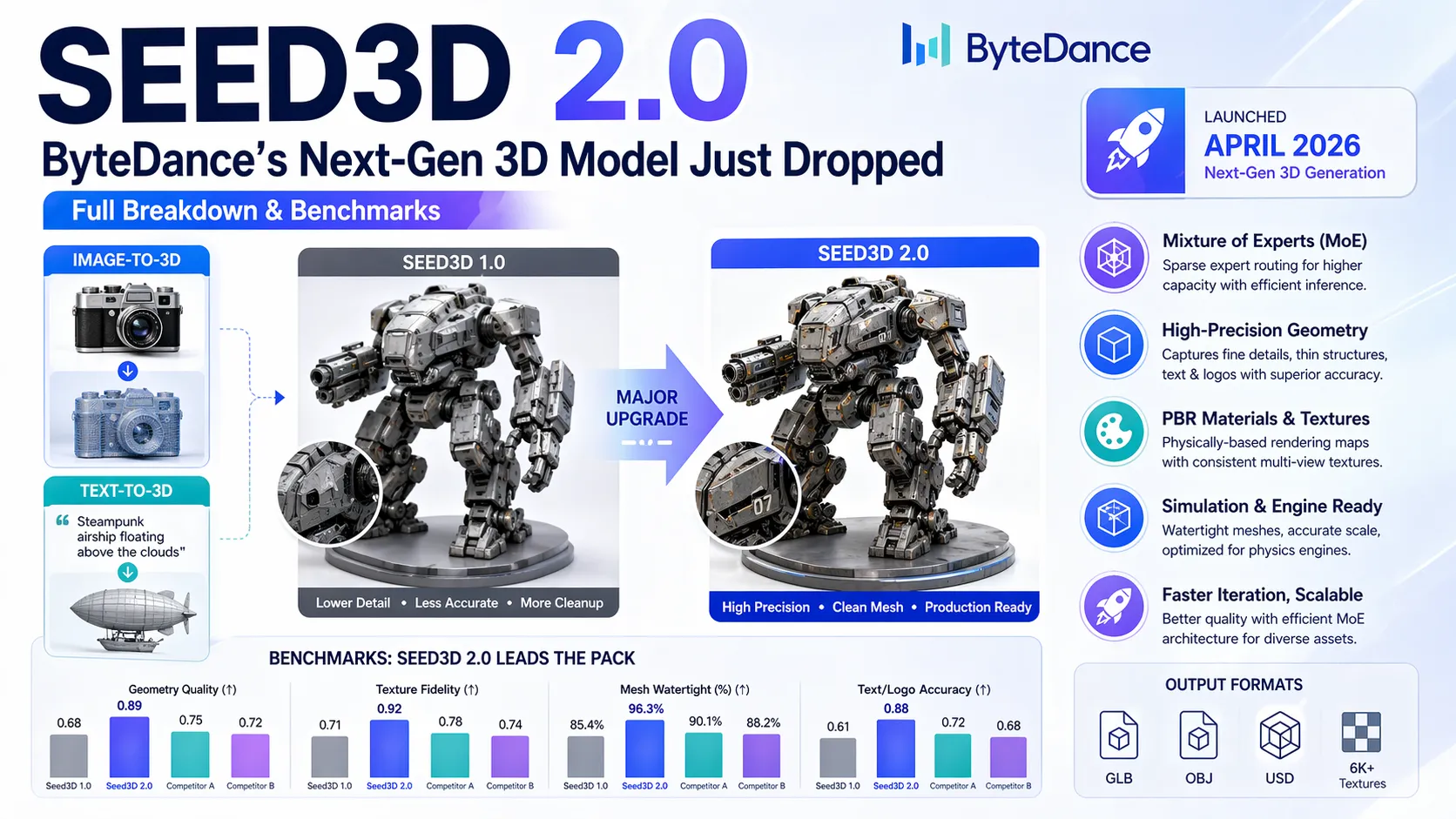

Seed3D 2.0: El nuevo modelo 3D de ByteDance ya está disponible – Análisis completo y pruebas de rendimiento

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.