Acceso No Autorizado al Anthropic Mythos AI: Cómo un Grupo de Discord Infringió el Modelo de Ciberseguridad 'Demasiado Peligroso'

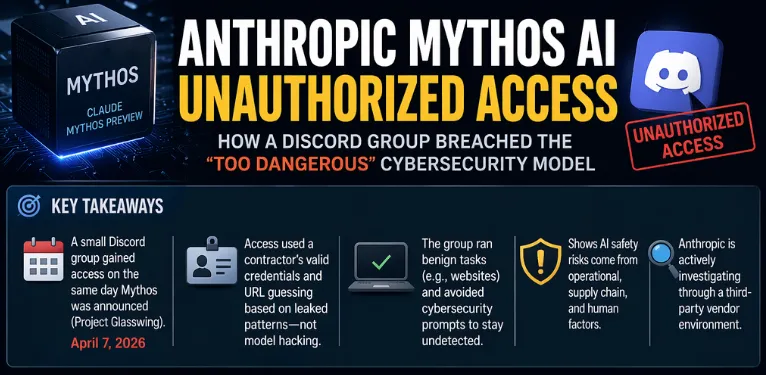

Conclusiones clave

- Un pequeño grupo de Discord obtuvo acceso al restringido Mythos de Anthropic (Claude Mythos Preview) el mismo día en que fue anunciado para pruebas limitadas bajo el Proyecto Glasswing.

- El acceso se basó en las credenciales legítimas de un contratista externo combinadas con la adivinanza de la URL del endpoint basada en patrones filtrados en la violación de datos de Mercor — no en un hackeo sofisticado del modelo.

- El grupo utilizó el modelo para tareas benignas como construir sitios web simples, evitando deliberadamente indicaciones relacionadas con ciberseguridad para eludir la detección.

- El incidente subraya que los riesgos de seguridad de la IA a menudo provienen de factores operativos, de la cadena de suministro y humanos, y no solo de las capacidades centrales del modelo.

- Anthropic está investigando activamente el acceso no autorizado a través de uno de los entornos de sus proveedores externos.

¿Qué es el modelo de IA Mythos de Anthropic?

Anthropic desarrolló Mythos como un modelo de IA altamente avanzado especializado en tareas de ciberseguridad. Según la compañía, demuestra capacidades sin precedentes para identificar y explotar vulnerabilidades de día cero en los principales sistemas operativos y navegadores web.

Los puntos de referencia y las pruebas internas supuestamente mostraron a Mythos generando miles de posibles exploits donde modelos anteriores no produjeron ninguno. Esto llevó a Anthropic a clasificarlo como demasiado arriesgado para su lanzamiento público, limitando el acceso inicial a socios seleccionados, incluidos Apple, Amazon, Cisco y otras organizaciones bajo la iniciativa Proyecto Glasswing.

El modelo fue posicionado como una herramienta defensiva para ayudar a grandes empresas y gobiernos a fortalecer sus sistemas contra amenazas emergentes potenciadas por IA. Sin embargo, su potencial ofensivo generó alertas sobre los riesgos de proliferación si cayera en manos malintencionadas.

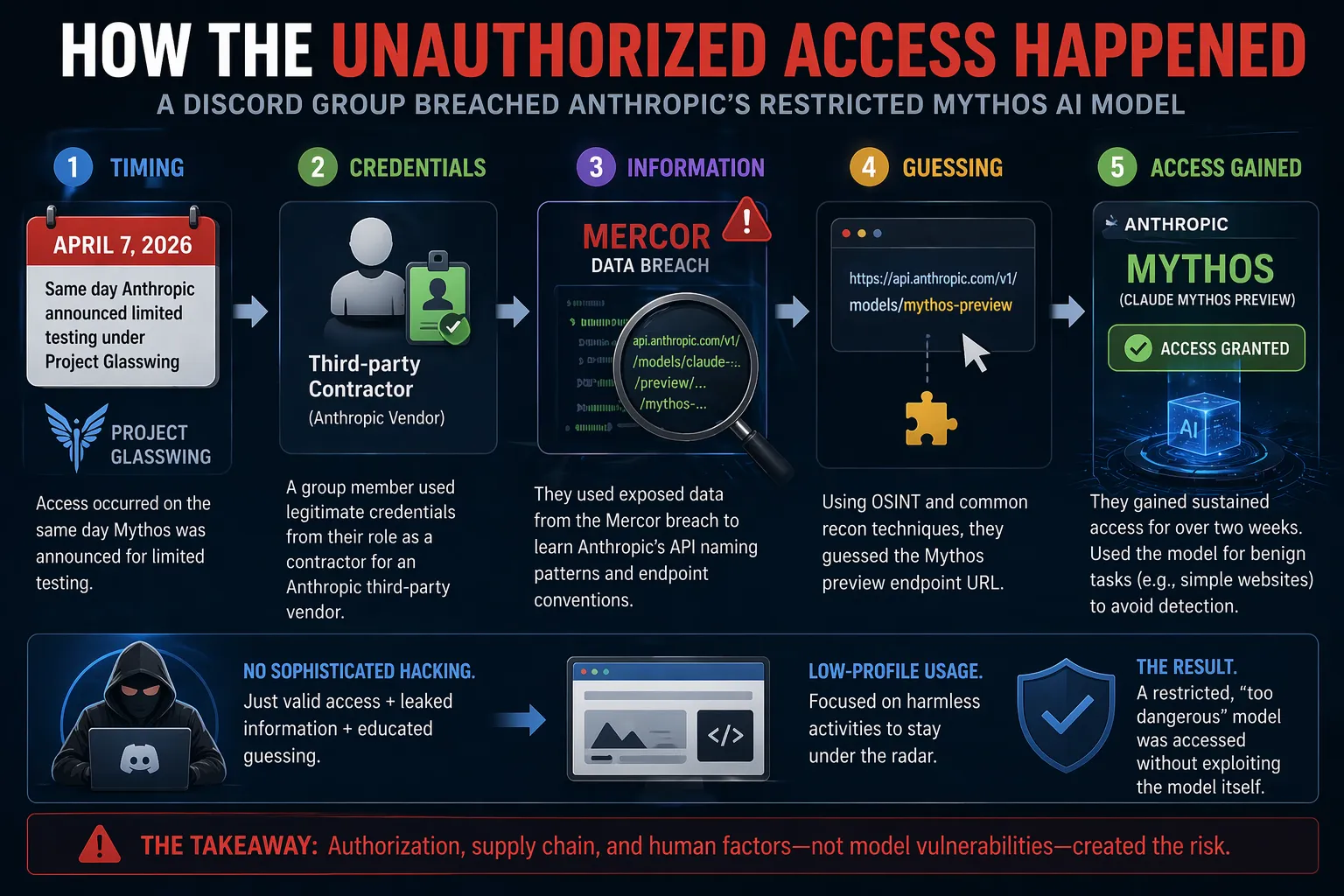

Cómo ocurrió el acceso no autorizado

El análisis de los informes indica que la violación fue notablemente sencilla, en lugar de una explotación de alta tecnología del modelo en sí:

- Momento: El acceso ocurrió el 7 de abril de 2026, el mismo día que Anthropic anunció la disponibilidad limitada para pruebas.

- Método: Miembros de un canal privado de Discord (centrado en rastrear modelos de IA no lanzados) utilizaron:

- Credenciales legítimas de un miembro del grupo que trabajaba como contratista para un proveedor externo de Anthropic (involucrado en la evaluación del modelo).

- Conocimiento de las convenciones de nomenclatura de endpoints de la API de Anthropic, derivadas de una violación de datos a gran escala reciente en la startup de IA Mercor.

- Adivinación educada de la URL del endpoint de vista previa de Mythos utilizando técnicas comunes de reconocimiento en internet.

La combinación permitió un acceso sostenido durante más de dos semanas. El grupo proporcionó capturas de pantalla y una demostración en vivo a periodistas para verificar sus afirmaciones.

Cabe destacar que evitaron ejecutar prompts de ciberseguridad de alto riesgo, optando en cambio por actividades inofensivas como generar sitios web simples. Este enfoque discreto probablemente les ayudó a permanecer indetectados por más tiempo.

Por qué Importa Esta Violación: Más Allá de los Pesos del Modelo

Los comentarios de la comunidad y las discusiones de expertos sugieren que este incidente subraya una verdad crítica en la seguridad de la IA: los eslabones más débiles suelen ser procedimentales y centrados en lo humano, en lugar de las salvaguardas técnicas del modelo.

Los puntos de referencia de Mythos se centraron en sus capacidades cibernéticas, sin embargo, la exposición en el mundo real se derivó de:

- Vulnerabilidades de la cadena de suministro: Contratistas y proveedores externos con acceso legítimo.

- Patrones de infraestructura predecibles: Convenciones de nomenclatura reutilizables para endpoints de modelos.

- Amplificación de fugas de datos: Información de violaciones no relacionadas (por ejemplo, Mercor) que habilita el reconocimiento.

- Suposiciones de confianza: Dependencia excesiva en entornos controlados sin suficiente aislamiento o monitoreo del acceso de proveedores.

Las comparaciones con incidentes anteriores de IA muestran un patrón: muchos modelos "peligrosos" enfrentan desafíos de contención no por ataques adversarios a los pesos, sino por brechas operativas. Este caso se asemeja a dejar un arma avanzada en una habitación cerrada mientras la puerta lateral del edificio permanece abierta.

Los casos límite incluyen:

- Credenciales compartidas entre contratistas o socios.

- Migas de pan públicas (patrones en GitHub, documentación) que ayudan a predecir URLs.

- Puntos ciegos de monitoreo cuando el uso se mantiene por debajo de ciertos umbrales de riesgo.

Escollos Comunes en el Despliegue de IA Restringida

El análisis de lanzamientos de IA de alto riesgo similares revela problemas recurrentes:

- Énfasis excesivo en la alineación del modelo, mientras se subinvierte en controles de acceso en tiempo de ejecución y auditorías.

- Incorporación de proveedores y socios sin permisos detallados y limitados en el tiempo, ni detección de anomalías.

- Nomenclatura y previsibilidad de endpoints que facilitan el reconocimiento para personas internas informadas.

- Fallo en la segmentación de entornos entre pruebas internas, evaluación de proveedores y acceso limitado de socios.

Las estrategias de mitigación avanzadas debatidas en círculos de ciberseguridad incluyen:

- Endpoints dinámicos y efímeros con autenticación estricta.

- Monitorización conductual que alerta incluso sobre patrones de uso benignos desde fuentes inesperadas.

- Rotación regular de convenciones de nomenclatura y alcances de credenciales.

- Auditorías de seguridad de la cadena de suministro centradas en las vías de acceso de contratistas.

Implicaciones para la Seguridad de la IA y la Ciberseguridad

El incidente de Mythos plantea cuestiones más amplias sobre la gobernanza de potentes tecnologías de IA de doble uso. Aunque el grupo no convirtió el modelo en un arma, la facilidad de acceso demuestra lo rápido que las capacidades restringidas pueden difundirse a través de redes informales.

Las instituciones financieras, gobiernos y empresas que probaban Mythos deben ahora reevaluar no solo el valor defensivo del modelo, sino también los riesgos de vectores de exposición similares. Los reguladores ya están monitoreando los acontecimientos, con debates en foros como el Consejo de Estabilidad Financiera destacando preocupaciones sistémicas.

Las comparaciones con otras empresas de IA muestran que Anthropic no está sola: muchas organizaciones lidian con el equilibrio entre la velocidad de innovación y una contención robusta en despliegues basados en la nube.

Conclusión

El acceso no autorizado al modelo Mythos de Anthropic sirve como un recordatorio oportuno de que la verdadera seguridad de la IA va mucho más allá de los datos de entrenamiento y las técnicas de alineación. La seguridad operativa, la integridad de la cadena de suministro y los factores humanos juegan roles igualmente decisivos.

A medida que las capacidades de la IA en dominios sensibles como la ciberseguridad continúan avanzando, las organizaciones deben priorizar una gobernanza de acceso integral junto al desarrollo de modelos. Las partes interesadas en IA, ciberseguridad y políticas deberían seguir de cerca los resultados de la investigación de Anthropic y considerar mejores prácticas reforzadas para despliegues restringidos.

Para los profesionales que trabajan con sistemas de IA de vanguardia, revisar la gestión interna de proveedores, la seguridad de endpoints y los protocolos de monitorización es un paso inmediato recomendado para reducir riesgos de exposición similares.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Anthropic Mythos AI Unauthorized Access: How a Discord Group Breached the 'Too Dangerous' Cybersecurity Model

Google invierte hasta $40 mil millones en Anthropic con soporte de computación de 5GW: la carrera armamentística de la IA entra en una nueva era

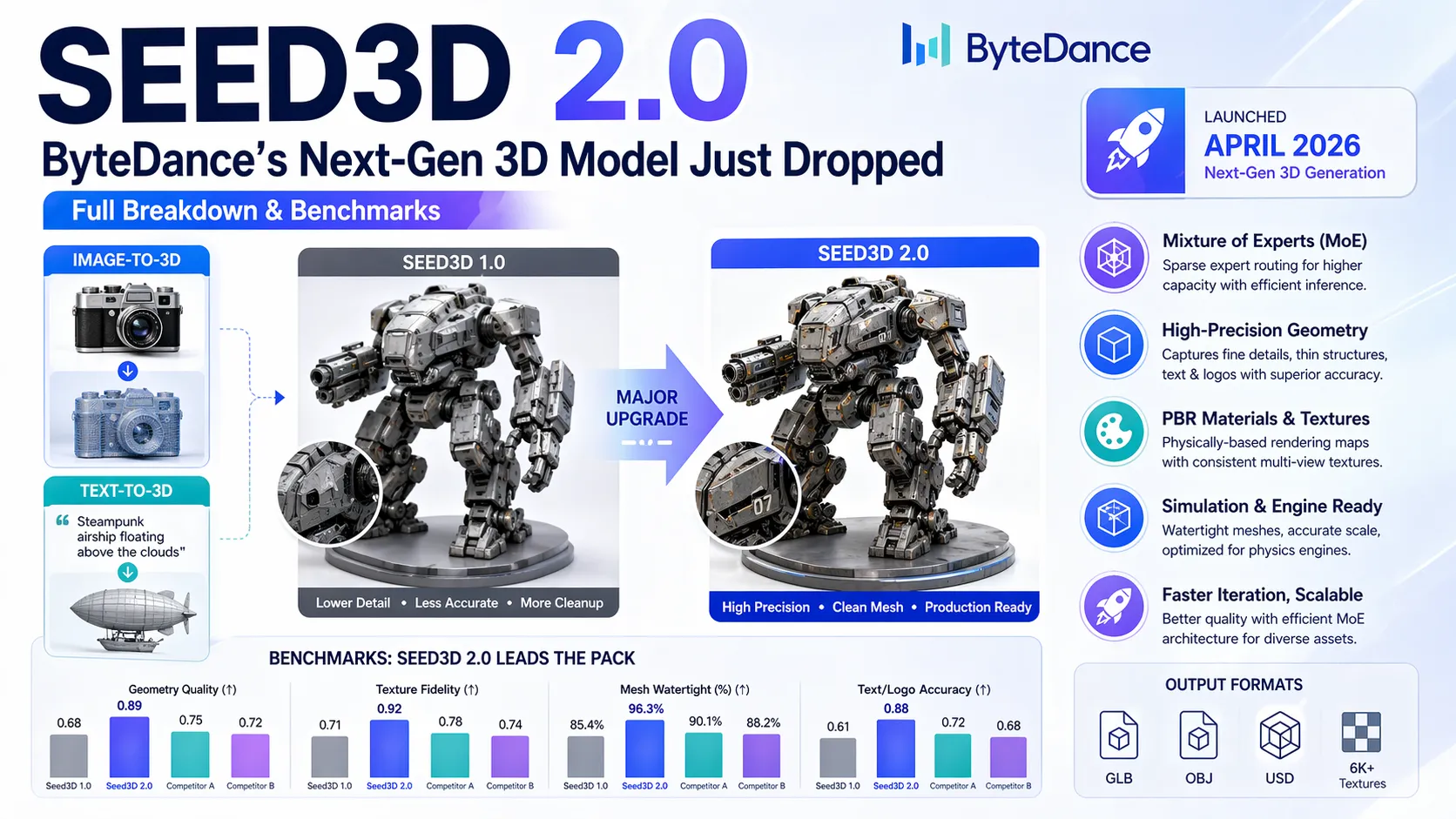

Seed3D 2.0: El nuevo modelo 3D de ByteDance ya está disponible – Análisis completo y pruebas de rendimiento

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.