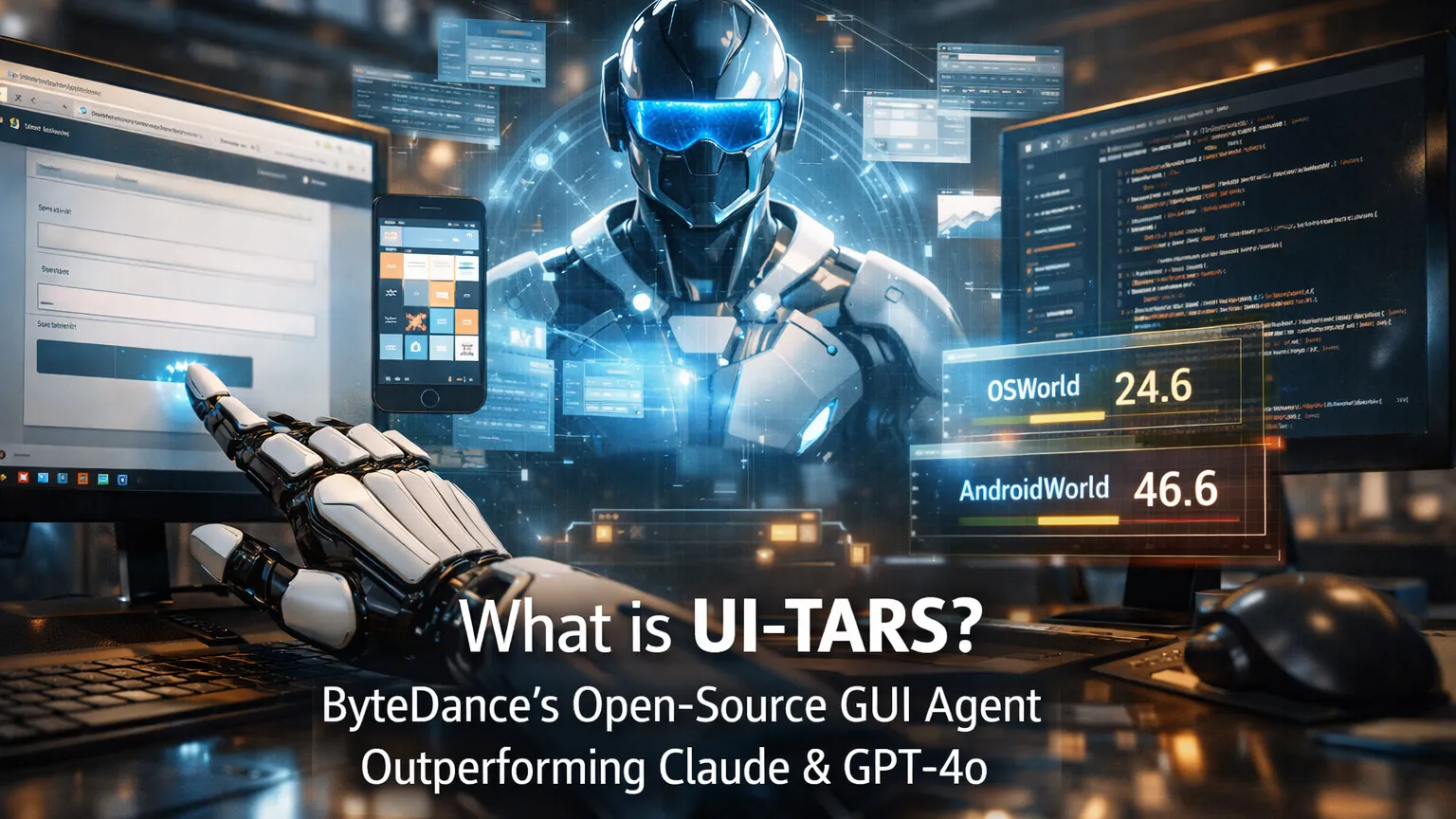

Qu'est-ce que UI-TARS ? L'agent d'interface graphique open source de ByteDance surpassant Claude et GPT-4o

Points clés

- UI-TARS signifie User Interface — Task Automation and Reasoning System (Interface Utilisateur — Système de Raisonnement et d'Automatisation de Tâches). C'est un agent natif GUI open-source développé par ByteDance (la maison mère de TikTok).

- C'est un modèle multimodal vision-langage (VLM) qui perçoit uniquement des captures d'écran et exécute des actions humaines (clic de souris, frappe clavier, défilement) sur des environnements bureau, navigateur et mobile.

- Contrairement aux frameworks reposant lourdement sur des prompts et des modèles commerciaux, UI-TARS est un modèle entraîné de bout en bout incorporant un raisonnement de type Système 2, une modélisation d'actions unifiée et un apprentissage en ligne réflexif.

- UI-TARS-1.5 (publié en avril 2025) obtient des résultats à la pointe sur plus de 10 benchmarks GUI, notamment OSWorld (24.6@50 étapes) et AndroidWorld (46.6), surpassant Claude 3.7 et GPT-4o.

- Disponible en plusieurs tailles (7B recommandé pour des exécutions locales) avec une application dédiée UI-TARS Desktop et une intégration MCP pour des flux de travail augmentés par outils.

Qu'est-ce que UI-TARS ?

UI-TARS est le modèle agent GUI natif pionnier de ByteDance, conçu pour interagir automatiquement avec les interfaces graphiques. Publié début 2025 avec la mise à jour UI-TARS-1.5 en avril 2025, il représente un changement par rapport aux frameworks d'agents modulaires vers un modèle vision-langage unifié et de bout en bout.

Le modèle prend des captures d'écran brutes comme seule entrée visuelle et produit des actions précises telles que des clics de souris (gauche, droit, double), des glisser-déposer, des saisies au clavier, du défilement et des séquences complexes — le tout sans dépendre de l'accès au DOM, d'arbres d'accessibilité ou d'APIs prédéfinies.

Cette approche basée uniquement sur les captures d'écran rend UI-TARS très généralisable à travers les plateformes (Windows, macOS, Linux, Android, navigateurs web) et robuste face aux changements d'interface qui perturbent les outils d'automatisation traditionnels.

Innovations techniques fondamentales

UI-TARS introduit plusieurs avancées qui expliquent ses performances supérieures :

- Perception améliorée : Entraîné sur d'immenses jeux de données de captures d'écran GUI pour une compréhension sensible au contexte et un étiquetage précis des éléments.

- Modélisation d'actions unifiée : Standardise les actions dans un espace unique à travers les plateformes, permettant un ancrage précis de la vision vers les entrées de bas niveau (coordonnées de souris, appuis de touches).

- Raisonnement Système 2 : Incorpore une réflexion délibérée multi-étapes, incluant la décomposition de tâches, la réflexion, la reconnaissance de jalons et la récupération d'erreurs avant d'agir.

- Entraînement itératif avec traces en ligne réflexives : Utilise des centaines de machines virtuelles pour générer, filtrer et affiner automatiquement des traces d'interaction. Le modèle apprend de ses propres erreurs via un ajustement réflexif avec une intervention humaine minimale.

Ces innovations permettent à UI-TARS de passer à l'échelle efficacement au moment de l'inférence et de s'adapter à de nouvelles interfaces de manière plus fiable que les agents basés sur l'ingénierie de prompts.

Tests de Performance

L'analyse des évaluations officielles montre que UI-TARS-1.5 mène constamment les benchmarks des agents d'interface graphique :

, - OSWorld : 24,6 (50 étapes) et 22,7 (15 étapes) — surpassant Claude (22,0 / 14,9).

- AndroidWorld : 46,6 — dépassant GPT-4o (34,5).

- Résultats SOTA supplémentaires sur plus de 10 benchmarks couvrant la perception, l'ancrage et l'exécution de tâches complètes.

Les benchmarks indiquent que la combinaison d'une perception basée sur la vision et d'un raisonnement intégré réduit l'accumulation d'erreurs dans les tâches à long terme par rapport aux agents qui reposent fortement sur l'appel d'outils externes ou les APIs d'accessibilité.

UI-TARS Desktop et l'Écosystème d'Agents

ByteDance fournit des implémentations pratiques au-delà du modèle de base :

-

UI-TARS Desktop : Une application Electron multiplateforme qui transforme le modèle en un agent de bureau natif. Les utilisateurs donnent des instructions en langage naturel, et l'agent visualise l'écran et contrôle la souris/le clavier.

-

Agent TARS : Une pile d'agents multimodaux plus large prenant en charge le terminal, le navigateur et les intégrations de produits. -B**.

-

Intégration MCP : Prend en charge le Model Context Protocol, permettant une combinaison transparente avec d'autres serveurs MCP (par exemple, base de données, Linear ou outils Playwright) pour des workflows hybrides.

L'agent de bureau prend en charge à la fois l'inférence locale (utilisant des modèles de Hugging Face) et l'opération à distance, avec des mises à jour récentes ajoutant des fonctionnalités gratuites de contrôle à distance d'ordinateur et de navigateur.

Comment UI-TARS se Compare aux Autres Agents d'Utilisation Informatique

| Agent | Type d'Entrée | Architecture | Open Source | Point Fort Principal | Avantage Notable en Benchmark |

|---|---|---|---|---|---|

| UI-TARS-1.5 | Capture d'écran seulement | VLM de bout en bout + Raisonnement | Oui | Généralisation & Réflexion | OSWorld, AndroidWorld |

| Utilisation Informatique Claude | Capture d'écran + API | Prompted + Utilisation d'Outils | Non | Sécurité & Écosystème | Fort mais inférieur sur les tâches longues |

| OpenAI Operator / CUA | Capture d'écran | Propriétaire | Non | Intégration avec ChatGPT | Compétitif mais fermé |

| Utilisation Informatique Anthropic | Capture d'écran | Base Claude 3.5/3.7 | Non | Fiabilité dans les environnements contrôlés | Scores inférieurs à UI-TARS |

Les retours de la communauté suggèrent que UI-TARS excelle dans les tâches de bureau ouvertes et réalistes où les éléments d'interface changent fréquemment ou manquent de métadonnées d'accessibilité propres.

Cas d'utilisation et Applications

- Automatisation de Bureau : Remplissage de formulaires, édition de documents, gestion de fichiers, ou exécution de flux de travail logiciels complexes (par exemple, des séquences Photoshop).

- Tâches Navigateur : Scraping web, soumission de formulaires, processus en ligne multi-étapes sans sélecteurs fragiles.

- Automatisation Mobile & Jeux : Interaction avec des applications Android et environnements de jeu virtuels.

- Développement & Tests : Génération et exécution de tests basés sur l'interface graphique ou reproduction visuelle de bugs.

- Systèmes d'Agents Hybrides : Combinaison avec des serveurs MCP pour des tâches nécessitant à la fois des actions sur l'interface graphique et un accès aux données backend.

Conseils Avancés, Cas Limites et Pièges Courants

- Déploiement Local : Le modèle 7B fonctionne efficacement sur du matériel grand public (surtout les versions quantifiées sur Apple Silicon via MLX). Utilisez des configurations compatibles LM Studio ou Ollama pour une inférence à coût zéro.

- Considérations de Sécurité : L'exécution d'un agent de bureau complet nécessite un sandboxing prudent. Limitez les permissions et surveillez les actions dans des environnements sensibles.

- Tâches à Long Terme : Exploitez les capacités de réflexion du modèle en fournissant des jalons clairs dans les prompts. L'auto-correction itérative améliore significativement les taux de réussite.

- Pièges à Éviter :

- Trop compter sur des captures d'écran uniques pour des interfaces utilisateur très dynamiques (combinez avec une mémoire à court terme ou des outils MCP).

- Ignorer les nuances d'actions spécifiques à la plateforme (par exemple, la mise à l'échelle des coordonnées sur différentes résolutions d'écran).

- S'attendre à des performances parfaites sur des interfaces hautement personnalisées ou à faible contraste sans fine-tuning.

Pour de meilleurs résultats, associez UI-TARS avec des prompts structurés incluant une décomposition des tâches et des critères de succès.

Pour Commencer

- Visitez les dépôts GitHub officiels : bytedance/UI-TARS pour le modèle et bytedance/UI-TARS-desktop pour l'application de bureau.

- Téléchargez les modèles depuis Hugging Face (ByteDance-Seed/UI-TARS-1.5-7B).

- Pour un test rapide, essayez l'application de bureau ou les démos basées sur navigateur.

- Explorez l'intégration MCP pour des agents utilisant des outils avancés.

Conclusion

UI-TARS représente une avancée significative dans l'automatisation d'interface graphique en offrant un agent véritablement natif et open-source qui voit l'écran comme un humain et raisonne avant d'agir. Ses solides performances de référence, son apprentissage réflexif et son implémentation pratique de bureau le positionnent comme une alternative majeure aux agents d'utilisation informatique commerciaux fermés en 2026.

Les développeurs et utilisateurs avancés cherchant à automatiser des tâches d'interface graphique répétitives ou à construire des agents multimodaux plus performants devraient explorer UI-TARS dès aujourd'hui. Commencez avec le modèle 7B et l'application de bureau pour expérimenter directement l'automatisation par capture d'écran, puis étendez-la avec des outils MCP pour des flux de travail de production.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.