Qu’est-ce qu’OmniShow ? Le framework d’IA qui révolutionne la génération de vidéos d’interaction humain-objet

Points clés

- OmniShow est un framework d’IA multimodal de bout en bout dédié à la Génération de Vidéos d’Interaction Humain-Objet (HOIVG). Il unifie les prompts textuels, les images de référence, l’audio et les séquences de poses pour produire des vidéos haute fidélité avec des interactions réalistes entre humains et produits.

- Construit sur un Multimodal Diffusion Transformer de 12,3 milliards de paramètres, il introduit la Unified Channel-wise Conditioning et la Gated Local-Context Attention pour résoudre le compromis entre contrôlabilité et qualité tout en garantissant une synchronisation précise.

- Les benchmarks sur le nouveau HOIVG-Bench montrent qu’OmniShow obtient des résultats state-of-the-art sur les tâches R2V, RA2V, RP2V et la tâche unique RAP2V, surpassant des modèles tels que HunyuanCustom, HuMo-17B, VACE et Phantom-14B en fidélité d’apparence, cohérence des mouvements et synchronisation audio-visuelle.

- Les applications pratiques excellent dans le e-commerce, permettant de créer des vidéos de démonstration de produits en qualité studio en quelques minutes sans tournage physique, avec un support pour des plans longs jusqu’à 10 secondes et une sortie en 720p.

- L’entraînement avancé via la stratégie Decoupled-Then-Joint résout le problème de rareté des données et délivre un niveau industriel de plausibilité physique, de préservation d’identité et de dynamiques naturelles de préhension et de contact.

Qu’est-ce qu’OmniShow ?

OmniShow est un framework d’IA de pointe spécialement conçu pour la Génération de Vidéos d’Interaction Humain-Objet (HOIVG). Il synthétise des vidéos réalistes montrant des humains en interaction avec des objets — comme présenter, saisir ou utiliser des produits — tout en se conditionnant simultanément sur plusieurs entrées : le texte pour la sémantique, les images de référence pour la fidélité visuelle, l’audio pour la synchronisation et les poses pour le contrôle du mouvement.

Publié en avril 2026 par des chercheurs affiliés à ByteDance, OmniShow comble une lacune critique des outils actuels de génération vidéo. Les modèles traditionnels ne gèrent souvent qu’une ou deux modalités et peinent à maintenir des interactions stables et physiquement plausibles sur la durée. OmniShow unifie les quatre modalités dans un seul système de bout en bout, produisant des résultats cinématographiques adaptés au e-commerce, aux contenus courts et au divertissement interactif.

L’analyse du framework montre qu’il privilégie l’utilité dans le monde réel : les sorties conservent une apparence cohérente des personnages et des objets, une dynamique de mouvement naturelle et une physique de contact robuste, même dans des scénarios complexes.

Fonctionnalités principales d’OmniShow

OmniShow offre un contrôle multimodal grâce à quatre modes de génération principaux :

- Reference-to-Video (R2V) : Génère des vidéos HOI haute fidélité à partir de texte et d’images de référence, avec une excellente préservation de l’apparence du produit.

- Reference + Audio-to-Video (RA2V) : Ajoute la synchronisation audio pour les mouvements des lèvres, les gestes et les avatars expressifs qui parlent ou chantent.

- Reference + Pose-to-Video (RP2V) : Intègre des séquences de poses pour des trajectoires de mouvement précises tout en garantissant des interactions authentiques avec les objets.

- Full Multimodal (RAP2V) : Combine toutes les entrées pour les sorties les plus contrôlables — premier conditionnement joint de l’industrie.

Autres capacités :

- Support des plans longs jusqu’à 10 secondes à 24 ips et en résolution 720p.

- Réalisme physique : préhension stable, pénétrations minimales et ombres/éclairage cohérents.

- Préservation de l’identité : apparence constante des humains et des objets sur tous les frames.

- Workflows optimisés pour le cloud pour les plateformes e-commerce telles que Shopify, Amazon et TikTok Shop.

Ces fonctionnalités rendent OmniShow particulièrement précieux pour la création de contenu à grande échelle où la précision est essentielle.

Comment fonctionne OmniShow : Architecture technique

OmniShow est construit sur le Multimodal Diffusion Transformer (MMDiT) Waver 1.0 de 12,3 milliards de paramètres, utilisant la diffusion latente avec flow matching. La vidéo est compressée via un VAE en tokens latents, puis débruitée itérativement tout en étant conditionnée par les entrées multimodales.

Innovations clés

- Unified Channel-wise Conditioning : Les images de référence et les séquences de poses sont encodées via VAE et injectées directement dans les canaux de features par concaténation avec les tokens vidéo bruités et les tokens de pseudo-frames. Des masques binaires contrôlent l’activation, associés à une perte de reconstruction de référence. Cela préserve une haute qualité visuelle sans la dégradation courante des méthodes à base d’adaptateurs.

- Gated Local-Context Attention : Les features audio (extraites via Wav2Vec 2.0) sont regroupées avec un contexte de fenêtre glissante (taille 5) et injectées via une attention masquée dans des blocs à double flux. Un vecteur de gating apprenable stabilise l’entraînement et module l’influence, assurant un alignement précis action-son avec seulement 2,5 % d’augmentation de la taille du modèle.

- Decoupled-Then-Joint Training : Pour pallier la rareté des données multimodales complètes, des modèles R2V et A2V séparés sont entraînés sur des jeux de données hétérogènes, puis fusionnés (ratio 6:4 favorisant la sensibilité à l’audio). Le fine-tuning joint sur des données RA2V et RAP2V de haute qualité débloque des capacités émergentes sans surapprentissage.

Le pipeline traite les entrées en parallèle, les fusionne de manière cross-modale et les raffine via la diffusion — produisant des vidéos qui semblent dirigées par un réalisateur plutôt que génériquement animées.

Benchmarks de performance et comparaisons

Les benchmarks sur le HOIVG-Bench personnalisé (135 clips divers de 5 secondes avec références humain/objet, poses et audio) démontrent la supériorité d’OmniShow :

- R2V : Leader en cohérence de référence (FaceSim 0.759, NexusScore 0.876) et en qualité globale tout en maintenant un fort alignement textuel.

- RA2V & RP2V : Surpasse HunyuanCustom, HuMo-17B, AnchorCrafter et VACE sur les métriques de synchronisation (Sync-C/Sync-D), la précision des poses (AKD/PCK) et la qualité vidéo (AES/IQA).

- RAP2V : Support complet unique ; bat les baselines en cascade sur presque toutes les métriques, notamment la cohérence du mouvement et la plausibilité physique.

Les retours de la communauté et des chercheurs soulignent la réduction significative des artefacts dans les interactions complexes par rapport aux approches unimodales ou en cascade. La continuité des plans longs et le respect de la physique constituent des différenciateurs majeurs.

Applications réelles et impact sur le e-commerce

OmniShow excelle dans les scénarios pratiques :

- Démonstrations de produits e-commerce : Créez des vidéos professionnelles d’unboxing, d’utilisation ou d’essayage à partir de simples photos de produit et d’une voix off — réduisant les coûts de production de plusieurs milliers à moins de 10 $ par vidéo.

- Contenu marketing : Générez des shorts style UGC avec des présentateurs IA qui démontrent naturellement les fonctionnalités.

- Flux de travail créatifs : Remixez des vidéos existantes, changez d’objets ou animez des avatars avec des expressions pilotées par l’audio.

Les marques bénéficient d’itérations plus rapides, de taux de conversion plus élevés (ex. : +67 % de CTR sur les réseaux sociaux) et d’une image de marque cohérente sans studio ni mannequins.

Conseils avancés pour des résultats optimaux

Pour maximiser la qualité :

- Utilisez des images de référence haute résolution, de face et avec un éclairage neutre pour une meilleure préservation de l’identité.

- Fournissez des prompts textuels clairs et concis décrivant les actions et les angles de caméra ; associez-les à des séquences de poses précises pour les interactions complexes main-objet.

- Pour l’audio, utilisez des voix off propres avec un fps correspondant ; testez d’abord des clips courts pour affiner la synchronisation.

- Utilisez le mode RAP2V pour les cas limites (gestion de plusieurs objets, mouvements de caméra) — commencez par R2V puis ajoutez les conditions de manière itérative.

Problèmes courants et comment les éviter

- Entrées conflictuelles : Des poses trop complexes associées à un audio mal assorti peuvent causer un léger flou ou des artefacts lors de mouvements intenses ; résolvez en simplifiant d’abord une modalité.

- Effets de la rareté des données : Bien que l’entraînement atténue ce problème, des références de faible qualité réduisent la fidélité — validez toujours vos entrées selon les standards du HOIVG-Bench.

- Biais des courts clips dans l’évaluation : Les résultats réels peuvent varier au-delà de 5 secondes ; générez et vérifiez les séquences complètes pour la cohérence temporelle.

- Dépendance excessive aux valeurs par défaut : Un réglage personnalisé du gating et des masques dans les configurations avancées donne de meilleurs résultats que l’utilisation zero-shot.

Le respect de ces points garantit des vidéos fiables et prêtes pour la production.

Conclusion

OmniShow représente un bond majeur dans la génération de vidéos contrôlables, rendant le contenu professionnel d’interaction humain-objet accessible à grande échelle. Son approche multimodale unifiée, soutenue par des innovations rigoureuses et des benchmarks solides, établit un nouveau standard de réalisme et de praticité dans les outils vidéo IA.

Pour les équipes e-commerce, les créateurs ou les chercheurs prêts à transformer leur production vidéo, explorez la page officielle du projet ou les implémentations commerciales pour commencer dès aujourd’hui à générer des vidéos HOI cinématographiques. L’avenir du storytelling produit est arrivé — un prompt multimodal précis à la fois.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Qu'est-ce qu'OC Maker ? L'outil d'IA révolutionnant la création de personnages originaux en 2026

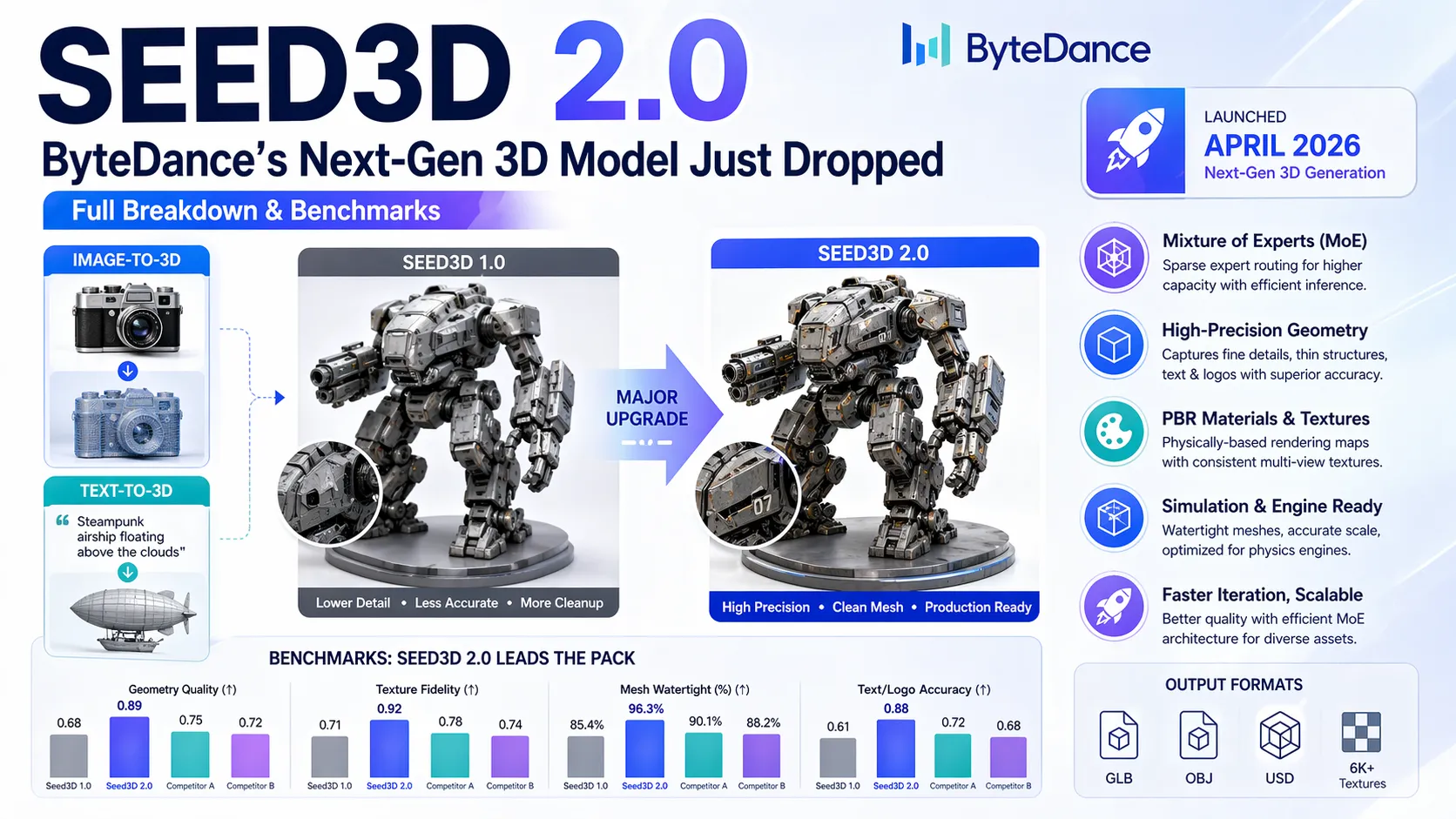

Seed3D 2.0 : Le modèle de nouvelle génération 3D de ByteDance est arrivé – Analyse complète et benchmarks

Was ist OmniShow? Das KI-Framework, das die Generierung von Human-Object-Interaction-Videos revolutioniert

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.