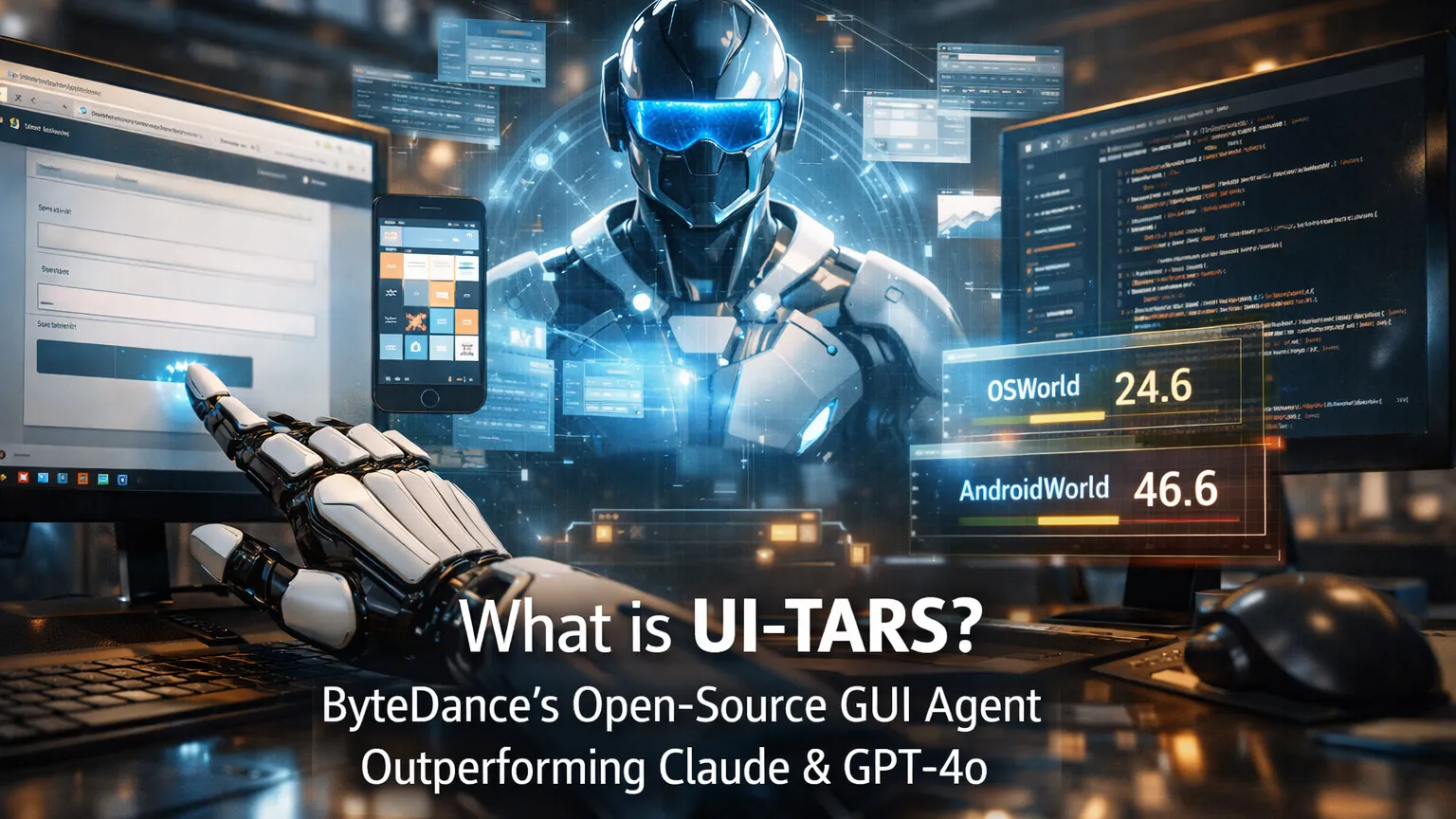

Was ist UI-TARS? ByteDances Open-Source GUI-Agent übertrifft Claude & GPT-4o

Wichtigste Erkenntnisse

- UI-TARS steht für User Interface — Task Automation and Reasoning System, ein quelloffener native GUI Agent, entwickelt von ByteDance (dem Mutterunternehmen von TikTok).

- Es ist ein multimodales Vision-Language Model (VLM), das ausschließlich Screenshots wahrnimmt und menschenähnliche Maus-, Tastatur- und Scroll-Aktionen auf Desktop-, Browser- und Mobilgeräteumgebungen ausführt.

- Im Gegensatz zu prompt-lastigen Frameworks, die auf kommerziellen Modellen basieren, ist UI-TARS ein End-to-End trainiertes Modell, das System-2-Denkvermögen, einheitliche Aktionsmodellierung und reflektierendes Online-Lernen integriert.

- UI-TARS-1.5 (veröffentlicht im April 2025) erzielt Spitzenergebnisse bei mehr als 10 GUI-Benchmarks, darunter OSWorld (24,6@50 Schritte) und AndroidWorld (46,6), und übertrifft dabei Claude 3.7 und GPT-4o.

- Verfügbar in mehreren Größen (7B wird für lokale Ausführungen empfohlen), mit einer dedizierten UI-TARS Desktop-Anwendung und MCP-Integration für werkzeuggestützte Workflows.

Was ist UI-TARS?

UI-TARS ist ByteDances wegweisendes native GUI Agent Model, entwickelt für die automatisierte Interaktion mit grafischen Benutzeroberflächen. Anfang 2025 veröffentlicht und im April 2025 mit dem UI-TARS-1.5-Update aktualisiert, markiert es einen Wechsel von modularen Agenten-Frameworks hin zu einem vereinheitlichten, End-to-End Vision-Language Model.

Das Modell nimmt reine Screenshots als einzige visuelle Eingabe und gibt präzise Aktionen wie Mausklicks (links, rechts, doppelt), Ziehen, Tastatureingabe, Scrollen und komplexe Sequenzen aus – alles ohne Zugriff auf DOM, Accessibility-Trees oder vordefinierte APIs.

Dieser rein auf Screenshots basierende Ansatz macht UI-TARS hochgradig generalisierbar über verschiedene Plattformen hinweg (Windows, macOS, Linux, Android, Webbrowser) und robust gegenüber UI-Änderungen, die traditionelle Automatisierungswerkzeuge zum Scheitern bringen.

Zentrale technische Innovationen

UI-TARS führt mehrere bahnbrechende Neuerungen ein, die seine überlegene Leistung erklären:

- Erweiterte Wahrnehmung: Trainiert auf umfangreichen GUI-Screenshot-Datensätzen für kontextbewusstes Verständnis und präzise Elementbeschriftung.

- Einheitliche Aktionsmodellierung: Standardisiert Aktionen über verschiedene Plattformen hinweg in einem einzigen Raum und ermöglicht so eine genaue Verankerung von visuellen Eingaben auf niedriger Ebene (Mauskoordinaten, Tastendrücke).

- System-2-Denkvermögen: Integriert bewusstes, mehrstufiges Denken, einschließlich Aufgabenzerlegung, Reflexion, Meilensteinerkennung und Fehlerbehebung, bevor gehandelt wird.

- Iteratives Training mit reflektierenden Online-Traces: Nutzt Hunderte von virtuellen Maschinen, um automatisch Interaktions-Traces zu generieren, zu filtern und zu verfeinern. Das Modell lernt aus seinen eigenen Fehlern durch Reflektions-Finetuning mit minimalem menschlichem Eingriff.

Diese Innovationen ermöglichen es UI-TARS, zur Inferenzzeit effektiv zu skalieren und sich zuverlässiger an neue Benutzeroberflächen anzupassen als prompt-engineerte Agenten.

Leistungsbenchmarks

Analysen offizieller Auswertungen zeigen, dass UI-TARS-1.5 in GUI-Agent-Benchmarks durchgängig führt:

- OSWorld: 24,6 (50 Schritte) und 22,7 (15 Schritte) – übertrifft Claude (22,0 / 14,9).

- AndroidWorld: 46,6 – übertrifft GPT-4o (34,5).

- Zusätzliche SOTA-Ergebnisse über 10+ Benchmarks hinweg, die Wahrnehmung, Grounding und vollständige Aufgabenausführung abdecken.

Die Benchmarks zeigen, dass die Kombination aus bildbasierter Wahrnehmung und integrierter Logik die Fehlerakkumulation in langfristigen Aufgaben im Vergleich zu Agenten reduziert, die stark auf externe Tool-Aufrufe oder Accessibility-APIs angewiesen sind.

UI-TARS Desktop und Agent-Ökosystem

ByteDance bietet über das Basismodell hinaus praktische Implementierungen:

- UI-TARS Desktop: Eine plattformübergreifende Electron-Anwendung, die das Modell in einen nativen Desktop-Agenten verwandelt. Nutzer geben natürliche Sprachbefehle, und der Agent betrachtet den Bildschirm und steuert Maus/Tastatur.

- Agent TARS: Ein umfassenderer multimodaler Agenten-Stack, der Terminal, Browser und Produktintegrationen unterstützt.

- MCP-Integration: Unterstützt das Model Context Protocol, was eine nahtlose Kombination mit anderen MCP-Servern (z.B. für Datenbank, Linear oder Playwright-Tools) für hybride Workflows ermöglicht.

Der Desktop-Agent unterstützt sowohl lokale Inferenz (mit Modellen von Hugging Face) als auch Fernsteuerung, wobei kürzliche Updates kostenlose Fernsteuerungsfunktionen für Computer und Browser hinzugefügt haben.

Wie sich UI-TARS mit anderen Computer-Use-Agenten vergleicht

| Agent | Eingabetyp | Architektur | Open Source | Hauptstärke | Bemerkenswerter Benchmark-Vorteil |

|---|---|---|---|---|---|

| UI-TARS-1.5 | Nur Screenshot | End-to-End VLM + Reasoning | Ja | Generalisierung & Reflexion | OSWorld, AndroidWorld |

| Claude Computer Use | Screenshot + API | Prompt-basiert + Tool Use | Nein | Sicherheit & Ökosystem | Stark, aber schwächer bei langen Aufgaben |

| OpenAI Operator / CUA | Screenshot | Proprietär | Nein | Integration mit ChatGPT | Wettbewerbsfähig, aber geschlossen |

| Anthropic Computer Use | Screenshot | Claude 3.5/3.7 Backbone | Nein | Zuverlässigkeit in kontrollierten Umgebungen | Niedrigere Scores als UI-TARS |

Feedback aus der Community deutet darauf hin, dass UI-TARS in offenen, realen Desktop-Aufgaben hervorragend abschneidet, bei denen sich UI-Elemente häufig ändern oder saubere Accessibility-Metadaten fehlen.

Anwendungsfälle und Einsatzgebiete

- Desktop-Automatisierung: Formulare ausfüllen, Dokumente bearbeiten, Dateien verwalten oder komplexe Software-Workflows ausführen (z.B. Photoshop-Abläufe).

- Browser-Aufgaben: Web-Scraping, Formularübermittlungen, mehrstufige Online-Prozesse ohne störanfällige Selektoren.

- Mobil- & Spieleautomatisierung: Interaktion mit Android-Apps und virtuellen Spielumgebungen.

- Entwicklung & Testing: Generierung und Ausführung von GUI-basierten Tests oder visuelles Reproduzieren von Fehlern.

- Hybride Agentensysteme: Kombination mit MCP-Servern für Aufgaben, die sowohl GUI-Aktionen als auch Backend-Datenzugriff erfordern.

Fortgeschrittene Tipps, Randfälle und häufige Fehlerquellen

- Lokale Bereitstellung: Das 7B-Modell läuft effizient auf Consumer-Hardware (insbesondere quantisierte Versionen auf Apple Silicon via MLX). Verwenden Sie LM Studio oder Ollama-kompatible Setups für kostenfreie Inferenz.

- Sicherheitsüberlegungen: Der Betrieb eines vollständigen Desktop-Agenten erfordert sorgfältige Sandboxing. Beschränken Sie Berechtigungen und überwachen Sie Aktionen in sensiblen Umgebungen.

-Komplexe Langzeitaufgaben**: Nutzen Sie die Reflexionsfähigkeiten des Modells durch klare Meilensteine in den Prompts. Iterative Selbstkorrektur verbessert die Erfolgsquote erheblich.

-Risiken zu vermeiden**:

- Übermäßiges Vertrauen auf einzelne Screenshots für hochdynamische UIs (kombinieren Sie diese mit Kurzzeitgedächtnis oder MCP-Tools).

- Vernachlässigung plattformspezifischer Aktionsnuancen (z.B. Koordinatenskalierung über verschiedene Bildschirmauflösungen).

- Erwartung perfekter Leistung bei stark angepassten oder kontrastarmen Oberflächen ohne Fine-Tuning.

Für optimale Ergebnisse kombinieren Sie UI-TARS mit strukturierten Prompts, die Aufgabenzerlegung und Erfolgskriterien enthalten.

Erste Schritte

- Besuchen Sie die offiziellen GitHub-Repositories: bytedance/UI-TARS für das Modell und bytedance/UI-TARS-desktop für die Desktop-Anwendung.

- Laden Sie Modelle von Hugging Face herunter (ByteDance-Seed/UI-TARS-1.5-7B).

- Testen Sie für einen schnellen Einstieg die Desktop-App oder browserbasierten Demos.

- Erkunden Sie die MCP-Integration für fortgeschrittene tool-verwendende Agenten.

Fazit

UI-TARS markiert einen bedeutenden Fortschritt in der GUI-Automatisierung durch einen echt nativen, Open-Source-Agenten, der den Bildschirm wie ein Mensch sieht und vor der Aktion reflektiert. Seine starke Benchmark-Leistung, reflektives Lernen und praktische Desktop-Implementierung positionieren ihn als führende Alternative zu geschlossenen kommerziellen Computer-Use-Agenten im Jahr 2026.

Entwickler und Power-User, die repetitive GUI-Aufgaben automatisieren oder leistungsfähigere multimodale Agenten aufbauen möchten, sollten UI-TARS jetzt erkunden. Beginnen Sie mit dem 7B-Modell und der Desktop-Anwendung, um Screenshot-gesteuerte Automatisierung aus erster Hand zu erleben, und erweitern Sie sie dann mit MCP-Tools für Produktions-Workflows.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.