O que é o LongCat-Next? O Explicado Modelo de IA Multimodal Nativo e Pioneiro da Meituan

Principais Conclusões

- LongCat-Next é um modelo de base multimodal nativo de código aberto desenvolvido pela equipe LongCat da Meituan, lançado em março de 2026.

- Ele unifica texto, visão (imagens) e áudio em um único espaço de tokens discretos usando o paradigma de Autoregressão Nativa Discreta (DiNA) e a previsão de próximo token (NTP).

- Construído sobre a arquitetura principal LongCat-Flash-Lite MoE (A3B: ~68,5B parâmetros totais, 3B ativos), ele suporta compreensão e geração entre modalidades com viés indutivo mínimo.

- Inovações principais incluem o tokenizador dNaViT (Discrete Native any-Resolution Vision Transformer), permitindo alta compressão (até 28×) enquanto preserva a qualidade, especialmente na renderização de texto.

- Benchmarks mostram desempenho competitivo contra modelos especializados em compreensão visual, geração de imagem, compreensão de fala e interação vocal de baixa latência.

- Totalmente de código aberto sob licença MIT no Hugging Face e GitHub, com código de inferência e uma demonstração ao vivo disponíveis.

O Que É o LongCat-Next?

O LongCat-Next representa uma mudança significativa na arquitetura de IA multimodal. Diferente dos sistemas tradicionais de "remendo" que acoplam codificadores de visão ou módulos de fala a um núcleo de modelo de linguagem, este modelo trata todas as modalidades como elementos nativos dentro de um framework unificado.

Desenvolvido pela equipe LongCat da Meituan, o LongCat-Next lexicaliza modalidades como tokens discretos. Imagens, formas de onda de áudio e texto são tokenizados em um vocabulário compartilhado, permitindo que o modelo os processe e gere usando o mesmo objetivo autoregressivo: prever o próximo token.

Esta abordagem de "Autoregressão Nativa Discreta" (DiNA) minimiza a complexidade arquitetural e os vieses indutivos além do paradigma de modelagem de linguagem. O resultado é um sistema mais elegante e escalável, capaz de verdadeiras capacidades multimodais de qualquer-para-qualquer.

Arquitetura Principal e Inovações Técnicas

Autoregressão Nativa Discreta (DiNA)

No seu cerne, o LongCat-Next estende o paradigma de previsão do próximo token para todas as modalidades. Tokenizadores emparelhados convertem entradas em IDs discretos:

- Texto: Tokenização de subpalavras padrão.

- Visão: Processado via dNaViT — um Vision Transformer nativo discreto de qualquer-resolução que lida com tamanhos de imagem variáveis sem artefatos de remendo fixo ou redimensionamento.

- Áudio: Convertido em tokens discretos que suportam compreensão, geração e conversação de baixa latência.

Todos os tokens alimentam uma arquitetura principal MoE (Mixture of Experts) compartilhada. Isso permite raciocínio multimodal contínuo, como descrever uma imagem enquanto gera áudio relacionado ou vice-versa.

Escala e Eficiência do Modelo

- Backbone: LongCat-Flash-Lite MoE com aproximadamente 68,5 bilhões de parâmetros totais e 3 bilhões de parâmetros ativos por etapa de inferência.

- Eficiência: A abordagem de token discreto e o design MoE mantêm a inferência leve em comparação com modelos densos de capacidade similar.

- Compressão: Alcança qualidade generativa forte em altas taxas de compressão (por exemplo, 28× para imagens), destacando-se particularmente na renderização precisa de texto dentro de visuais gerados.

A arquitetura suporta tanto compreensão multimodal (por exemplo, resposta a perguntas visuais, transcrição de fala com contexto) quanto geração (por exemplo, texto-para-imagem, edição de imagem via tokens, síntese de voz).

Desempenho e Benchmarks

A análise dos relatórios técnicos divulgados e das avaliações da comunidade indica que o LongCat-Next oferece resultados de nível industrial em diversos domínios:

- Compreensão Visual: Competitivo com modelos especializados de visão-linguagem em benchmarks envolvendo cenas complexas, documentos e entradas de qualquer resolução. Lida efetivamente com fórmulas matemáticas densas, imagens ricas em OCR e fotos do mundo real.

- Geração de Imagem: Mantém alta fidelidade e coerência, com força notável na renderização de texto legível dentro das imagens — uma fraqueza comum em muitos sistemas multimodais.

- Áudio/Fala: Destaca-se em compreensão avançada de fala, conversas de voz de baixa latência e clonagem de voz personalizável. Suporta interações multimodais naturais, como falar enquanto referencia conteúdo visual.

- Tarefas Intermodais: Forte desempenho em tarefas unificadas, como legendagem de imagem com descrições de áudio ou geração de visuais a partir de prompts falados.

Os benchmarks o posicionam como altamente competitivo dentro de estruturas discretas, muitas vezes igualando ou aproximando-se de sistemas maiores ou especializados enquanto oferece maior simplicidade arquitetônica.

O feedback da comunidade sugere vantagens particulares em casos de uso reais complexos, como digitalização de documentos com pouca luz ou diálogos de modalidade mista.

Como o LongCat-Next Diferencia-se dos Modelos Multimodais Tradicionais

A maioria dos modelos de linguagem grande multimodal (MLLMs) atuais depende de um núcleo centrado na linguagem com codificadores auxiliares:

- Dados visuais são projetados no espaço de embeddings do LLM via adaptadores ou atenção cruzada.

- Módulos de áudio são frequentemente pipelines separados.

Isso cria desafios de alinhamento, aumento de latência e instabilidades no treinamento.

Vantagens do LongCat-Next:

- Espaço de Token Unificado: Todas as modalidades tornam-se "linguagem nativa" para o modelo, reduzindo lacunas de modalidade.

- Objetivo Único: Pura previsão do próximo token em tudo simplifica o treinamento e o dimensionamento.

- Viés Reduzido: Viés indutivo adicional mínimo além da autoregressão.

- Simplicidade de Implantação: Backbone compartilhado facilita a otimização de inferência e o serviço multimodal.

Esta mudança de paradigma visa aproximar a IA de lidar com os sinais entrelaçados do mundo físico (visão, som, texto) de maneira coesa.

Começando com o LongCat-Next

Acesso e Recursos

- Hugging Face: meituan-longcat/LongCat-Next — pesos do modelo, safetensors e integração com Transformers.

- GitHub: Repositório completo incluindo código de inferência, implementação modular e relatório técnico em PDF.

- Demo: Experiência interativa em longcat.chat/longcat-next.

- Licença: MIT — adequada para aplicações de pesquisa e comerciais.

Dicas Básicas de Uso

O modelo suporta pipelines padrão do Transformers com extensões personalizadas para entradas multimodais. Padrões de código de exemplo (do repositório):

# Pseudocódigo para inferência multimodal

from transformers import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained("meituan-longcat/LongCat-Next")

# Tokenizar entradas mistas (texto + imagem + áudio)

inputs = tokenizer.process_multimodal(prompt, image=image_tensor, audio=audio_tensor)

outputs = model.generate(inputs)

Dicas Avançadas:

- Utilize dNaViT para imagens de qualquer resolução para evitar perda de qualidade no redimensionamento.

- Para tarefas de geração, experimente controle em nível de token para uma consistência cross-modal mais refinada.

- Use quantização (ex: versões de 4-bit disponíveis em repositórios da comunidade) para implantação em hardware de consumo.

Armadilhas Comuns e Casos Específicos

- Gestão do Orçamento de Tokens: Entradas de áudio longas ou de alta resolução consomem mais tokens; priorize regiões-chave ou use estratégias de compressão.

- Alinhamento Cross-Modal: Embora unificado, tarefas intercaladas complexas podem exigir engenharia de prompt cuidadosa para coerência ideal.

- Otimização da Inferência: Modelos MoE beneficiam-se de configurações de paralelismo de especialistas; consulte o repositório dedicado de inferência para melhores práticas.

- Considerações de Hardware: Precisão completa requer VRAM significativa; comece com variantes quantizadas para testes.

Monitore as discussões da comunidade para técnicas de fine-tuning emergentes e adaptações específicas para aplicações.

Aplicações Potenciais e Implicações Futuras

O LongCat-Next abre portas para sistemas de IA mais integrados:

- Agentes do Mundo Real: Robôs ou aplicativos que percebem elementos visuais, processam fala e respondem multimodalmente em um único modelo.

- Ferramentas Criativas: Geração unificada de imagem+áudio+texto para criação de conteúdo.

- Acessibilidade: Compreensão aprimorada de documentos com interação por voz.

- IA para o Mundo Físico: Um passo em direção a modelos que tratam entradas sensoriais com a mesma fluência que a linguagem.

Como uma versão open-source, convida desenvolvedores a construir extensões, fine-tunes e variantes específicas de domínio, acelerando o progresso multimodal.

Conclusão

O LongCat-Next se destaca como um avanço cuidadosamente pensado na modelagem multimodal nativa. Ao unificar modalidades sob uma estrutura autorregressiva discreta, ele simplifica a arquitetura enquanto oferece um desempenho capaz em ver, criar e falar.

Para desenvolvedores, pesquisadores e entusiastas de IA, este modelo de código aberto fornece uma base prática para experimentar com capacidades verdadeiras de qualquer-para-qualquer. Explore o repositório no Hugging Face, revise o relatório técnico e teste a demonstração ao vivo para experienciar o paradigma DiNA em primeira mão.

Comece a construir com o LongCat-Next hoje e contribua para o cenário em evolução da IA multimodal unificada.

Pronto para mergulhar? Visite a demonstração oficial ou clone o repositório no GitHub para começar a experimentar.

Continue Reading

More articles connected to the same themes, protocols, and tools.

O Que É o OC Maker? A Ferramenta de IA que Está Revolucionando a Criação de Personagens Originais em 2026

Acesso Não Autorizado à IA Mythos da Anthropic: Como um Grupo do Discord Violou o Modelo de Cibersegurança 'Muito Perigoso'

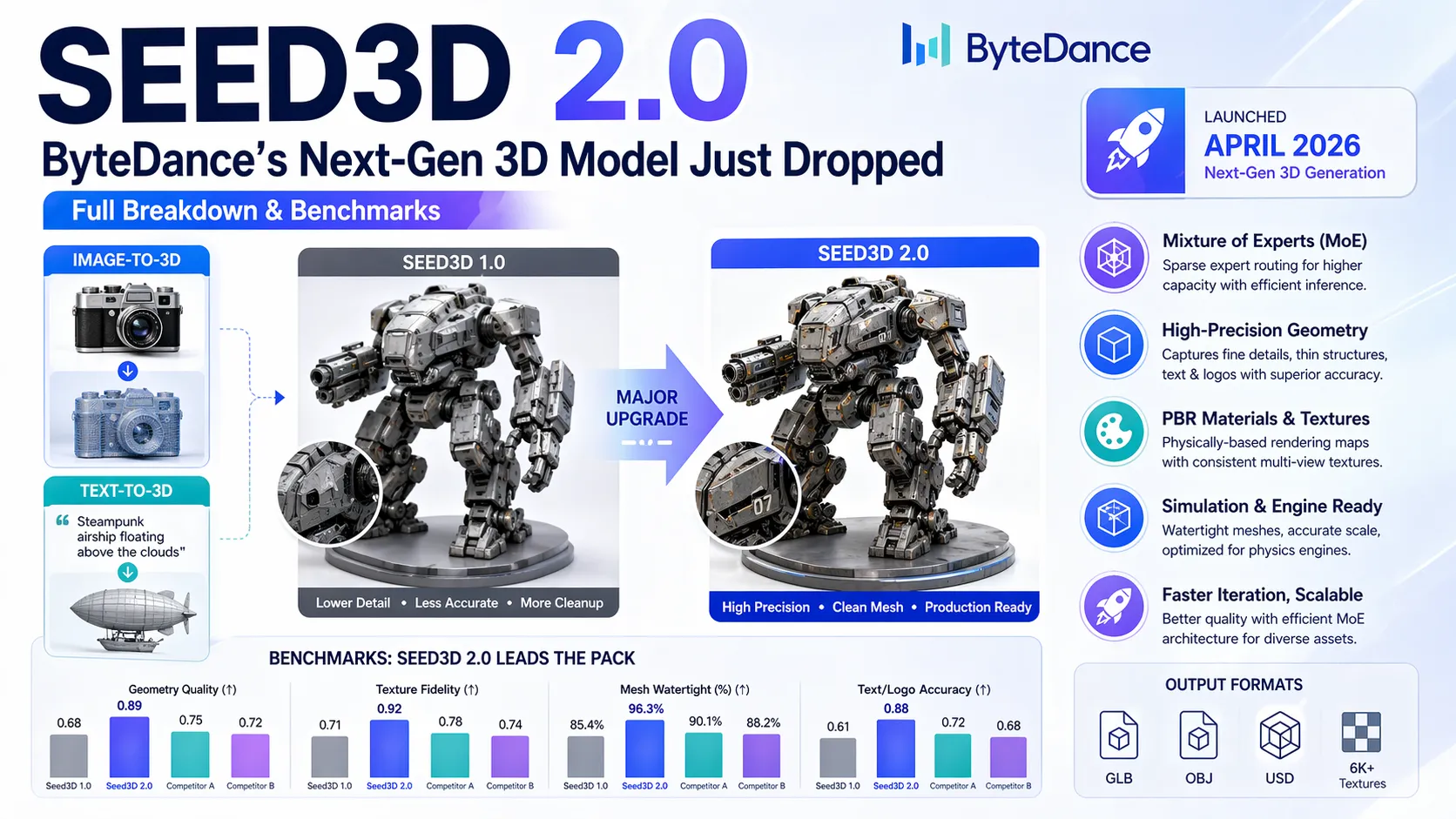

Seed3D 2.0: O Modelo 3D de Nova Geração da ByteDance já está Disponível – Análise Completa e Benchmarks

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.