Cómo Andrej Karpathy Utiliza LLMs para Construir Bases de Conocimiento Personal Dinámicas en Obsidian

Puntos Clave

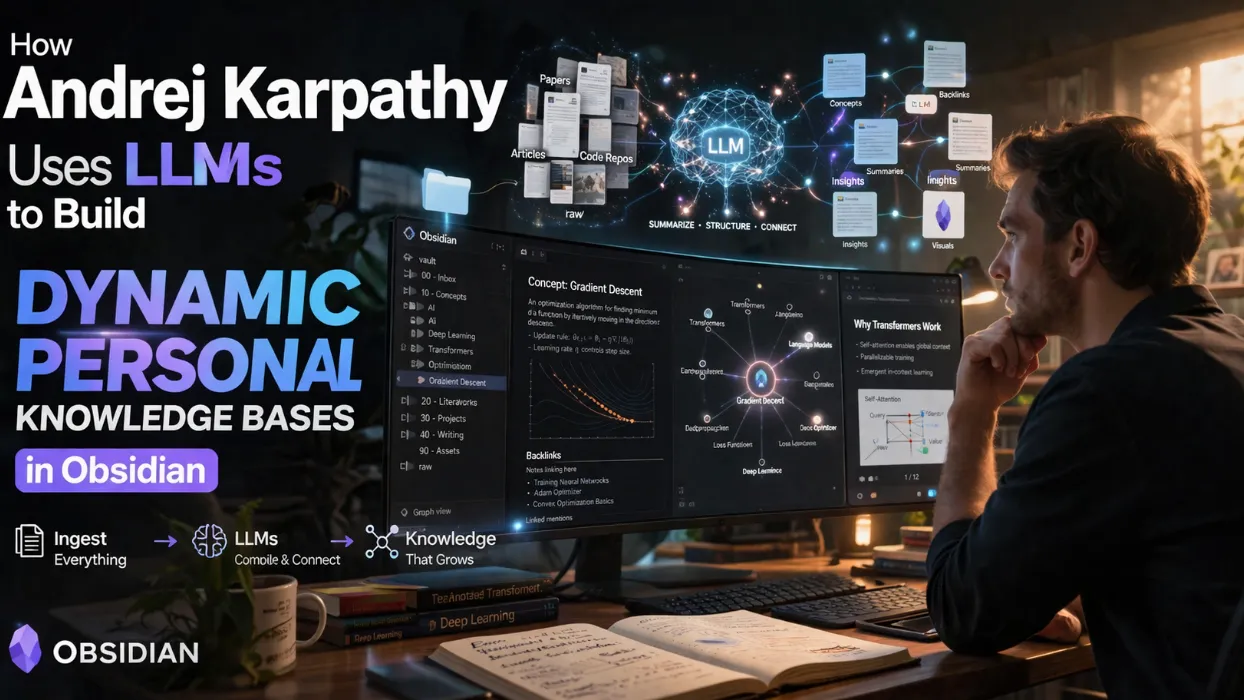

- El sistema de Andrej Karpathy ingiere documentos sin procesar (artículos, papers, repositorios, imágenes) en un directorio

raw/, luego usa LLMs para compilarlos incrementalmente en una wiki estructurada en Markdown con resúmenes, enlaces bidireccionales, artículos de conceptos e interconexiones. - Obsidian sirve como el frontend ligero para visualizar datos sin procesar, la wiki compilada y salidas generadas como diapositivas de Marp o gráficos de Matplotlib, con el LLM encargándose de casi toda la escritura y el mantenimiento.

- A escala (~100 artículos, ~400K palabras), se logra Q&A complejo con mínima dependencia de RAG; el LLM mantiene automáticamente índices y resúmenes para recuperación eficiente de contexto.

- La verificación mediante linting con LLM identifica inconsistencias, imputa datos faltantes, sugiere conexiones y propone nuevos artículos, garantizando la integridad de los datos.

- Las salidas se extienden más allá del texto para incluir Markdown renderizado, diapositivas, visualizaciones o HTML dinámico, que a menudo se archivan nuevamente en la wiki para acumular conocimiento con el tiempo.

- La adopción de la comunidad destaca extensiones como la separación de agentes para control de contaminación, datos sintéticos para fine-tuning y wikis efímeros generados por consulta.

El Cambio de Código a Manipulación del Conocimiento

El análisis muestra un cambio fundamental en la asignación de tokens: los LLMs de última generación recientes destacan en la síntesis de conocimiento sobre la generación pura de código. Karpathy reporta que una gran fracción de su capacidad de procesamiento de tokens ahora manipula conocimiento estructurado almacenado como archivos Markdown e imágenes, en lugar de salidas terminales efímeras.

Este flujo de trabajo transforma el consumo pasivo de investigación en una base de conocimiento activa y auto-mejorable. Las fuentes sin procesar se acumulan en un directorio dedicado. Un LLM luego las "compila" incrementalmente: generando resúmenes, categorizando el contenido en conceptos, redactando artículos enlazados y estableciendo enlaces bidireccionales.

Los benchmarks de sistemas personales similares indican que una vez que una wiki alcanza una masa crítica, la complejidad de las consultas escala dramáticamente sin aumentos proporcionales en la sobrecarga de recuperación.

Proceso de Ingestión y Compilación de Datos

El pipeline comienza con una recolección específica:

-[Manejo de Fuentes]: Artículos de investigación, papers, repositorios de GitHub, datasets e imágenes llegan a raw/. El contenido web se convierte a Markdown mediante Obsidian Web Clipper, descargándose las imágenes localmente para referencia directa del LLM.

- [Compilación Incremental]: Los LLMs procesan nuevos documentos uno por uno inicialmente, luego aplican coincidencia de patrones para mayor eficiencia. Instrucciones como "archiva este nuevo documento en nuestra wiki" activan la categorización, resumización y enlazado.

- [Creación de Estructura]: La wiki resultante presenta:

- Resúmenes por documento

- Artículos a nivel de concepto

- Enlaces bidireccionales

- Organización basada en directorios

La retroalimentación de la comunidad sugiere que el procesamiento por lotes o pipelines de múltiples etapas mejoran las decisiones de directorio para ingesta de gran volumen, aunque Karpathy mantiene las etapas iniciales con humanos en el bucle para calidad.

Obsidian como el Frontend Ideal

Obsidian funciona como un "IDE" minimalista para el sistema:

– Vistas simultáneas de fuentes en bruto, el wiki compilado y visualizaciones. – Complementos como Marp permiten renderizar presentaciones directamente desde Markdown generado por LLMs. – Las vistas de grafo y la navegación por enlaces inversos revelan conexiones emergentes.

Los expertos señalan que la base de Obsidian, basada en Markdown y prioridad local, minimiza el lock-in mientras admite herramientas personalizadas. Existen alternativas como VS Code con extensiones de Markdown, pero el ecosistema de Obsidian acelera la exploración visual e interactiva.

En las implementaciones comunitarias surgen estrategias de separación: mantener un almacén personal de alta señal junto con un almacén "desordenado" orientado al agente, para evitar la contaminación del contenido generado.

Generación Avanzada de Q&A y Salidas

Una vez escalado, el wiki admite consultas sofisticadas:

– Los LLMs navegan todo el corpus, aprovechando índices y resúmenes autogestionados. – Con ~400K palabras, las ventanas de contexto manejan grupos relacionados de forma eficiente sin necesidad de RAG vectorial pesado. – Las salidas se adaptan a las necesidades: informes en Markdown, presentaciones Marp, figuras de Matplotlib o incluso HTML/JS dinámico para filtrado interactivo y visualizaciones.

Los artefactos generados a menudo se retroalimentan al wiki, creando un ciclo de crecimiento exponencial donde las exploraciones mejoran las consultas futuras. Lex Fridman y otros informan de configuraciones similares para investigar podcasts o interacciones de voz sobre la marcha a través de mini-wikis temporales.

Linting y Mantenimiento Impulsado por LLM

Una característica destacada son las "comprobaciones de salud" automatizadas:

– Detectar afirmaciones inconsistentes entre fuentes ingeridas con semanas de diferencia. – Rellenar lagunas utilizando herramientas de búsqueda web. – Identificar conexiones novedosas y artículos candidatos. – Sugerir preguntas de seguimiento para profundizar en la cobertura.

Esto convierte el wiki de un repositorio estático en un compañero de investigación vivo. Con el crecimiento, aumentan los riesgos de datos obsoletos; las auditorías versionadas y las actualizaciones incrementales mitigan la desviación más eficazmente que las ingestas únicas.

Herramientas Emergentes y Exploraciones Futuras

Los usuarios amplían el núcleo con:

– CLIs personalizados o motores de búsqueda simples entregados a los LLMs como herramientas. – Generación de datos sintéticos combinada con fine-tuning para incrustar el conocimiento del wiki en los pesos del modelo. – Generación efímera de wikis: una sola consulta genera una base de conocimiento completa, depurada e iterada, antes del informe final — mucho más allá de una simple decodificación.

Los diagramas arquitectónicos compartidos en la comunidad visualizan las etapas, desde la ingesta hasta la compilación, consulta y mejora. Los productos que acerquen esto a los no desarrolladores representan una oportunidad clara, ya que toda organización mantiene datos "raw/" no estructurados esperando ser compilados.

Las comparaciones con los PKM tradicionales (gestión personal del conocimiento) destacan las ventajas: la automatización mediante LLM reduce la curación manual en un 80-90% en dominios de investigación activa, mientras que los enlaces inversos y los grafos sacan a la luz ideas que los humanos podrían pasar por alto.

Retos y Buenas Prácticas

- Gestión de Escala: Los resúmenes pueden quedar obsoletos; prioriza las diferencias recientes y las auditorías.

- Control de Contaminación: Aísla el contenido generado por agentes hasta que sea verificado.

- Adopción Incremental: Empieza con poco, deja que surjan patrones antes de la autonomía total.

- Sencillez de Herramientas: Directorios planos de Markdown con esquemas

AGENTS.mdson suficientes; sobre-ingeniería retrasa la obtención de valor.

Perspectiva accionable: Comienza con un tema de investigación. Recopila 10-20 fuentes, pide a un modelo de lenguaje grande (LLM) que compile la wiki inicial, luego itera consultas y limpieza. Mide el valor por la profundidad de las consultas y el tiempo ahorrado frente a la búsqueda/toma de notas tradicional.

Conclusión

El flujo de trabajo de base de conocimiento impulsada por LLM de Andrej Karpathy marca una evolución práctica en cómo investigadores y profesionales interactúan con la información. Al delegar la compilación, el mantenimiento y la síntesis a modelos capaces mientras se retiene Obsidian para la interacción intuitiva, los usuarios logran una comprensión más profunda con menos fricción.

Este enfoque se compone con el tiempo: cada consulta fortalece la base, cada proceso de limpieza eleva la integridad. A medida que los modelos de vanguardia avanzan, espera herramientas más amplias que automaticen wikis efímeras completas a partir de preguntas naturales.

Implementa una versión mínima hoy: ingiere tu próximo lote de investigación y deja que un LLM construya los cimientos. El cambio de consumir conocimiento a cultivarlo activamente podría redefinir la inteligencia personal y organizativa en la era agentiva.

Empieza con poco, itera incansablemente, y observa cómo tu wiki personal evoluciona hasta convertirse en un verdadero multiplicador intelectual.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Acceso No Autorizado al Anthropic Mythos AI: Cómo un Grupo de Discord Infringió el Modelo de Ciberseguridad 'Demasiado Peligroso'

¿Qué es OmniShow? El framework de IA que revoluciona la generación de videos de interacción humano-objeto

Guía de Prompt para OpenAI GPT-5.5: Tutorial Paso a Paso

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.