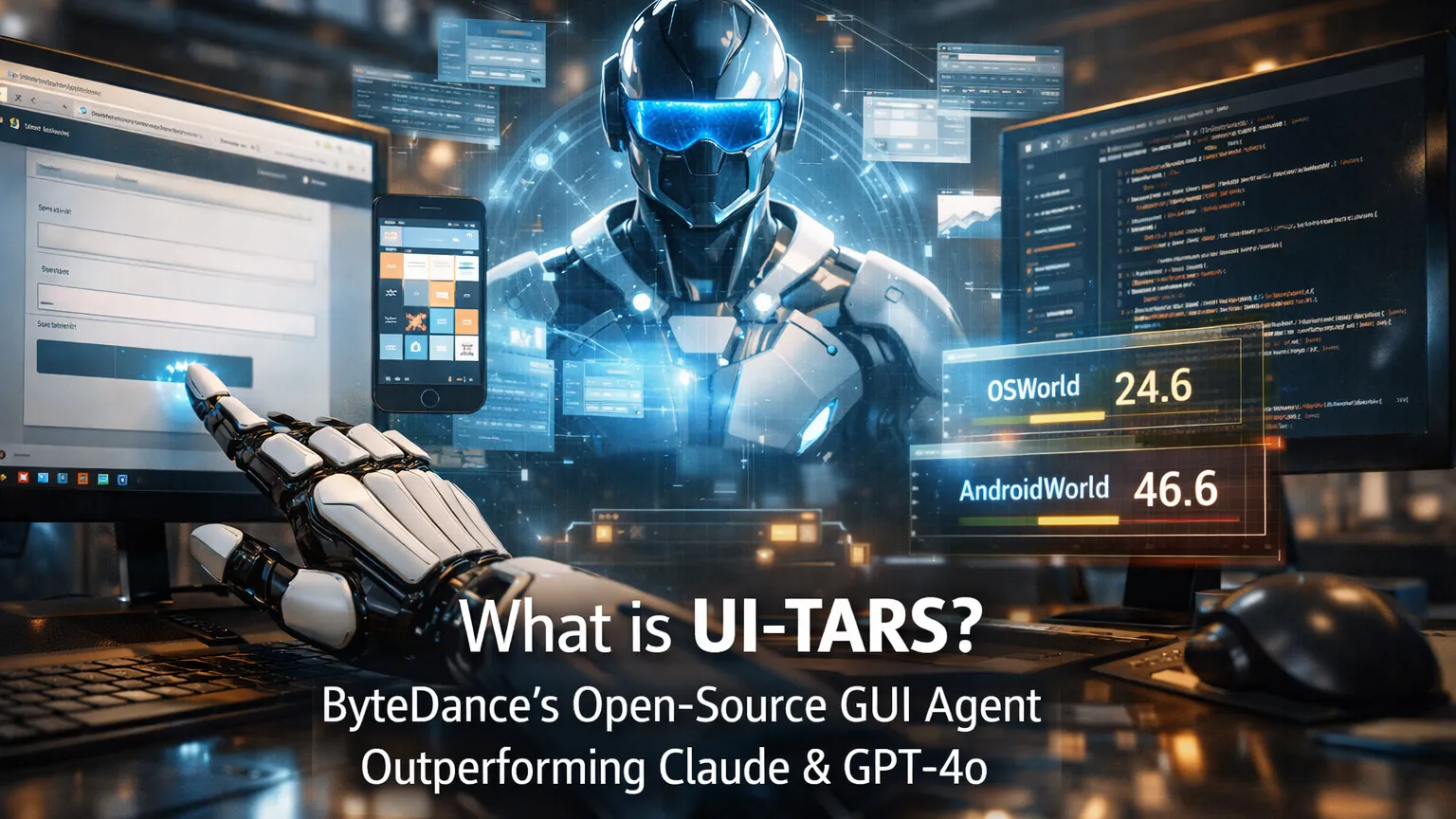

O que é o UI-TARS? O Agente de Interface Gráfica de Código Aberto da ByteDance que Supera Claude e GPT-4o

Principais Conclusões

- UI-TARS significa User Interface — Task Automation and Reasoning System (Interface do Usuário — Sistema de Automação e Raciocínio de Tarefas), um agente de GUI nativo de código aberto desenvolvido pela ByteDance (controladora do TikTok).

- É um modelo de linguagem visual multimodal (VLM) que percebe apenas capturas de tela e executa ações semelhantes às humanas de mouse, teclado e rolagem em ambientes de desktop, navegador e dispositivos móveis.

- Ao contrário de estruturas que dependem muito de prompts e de modelos comerciais, UI-TARS é um modelo treinado de ponta a ponta que incorpora raciocínio do Sistema-2, modelagem de ação unificada e aprendizado online reflexivo.

- UI-TARS-1.5 (lançado em abril de 2025) alcança resultados de ponta em mais de 10 benchmarks de GUI, incluindo OSWorld (24,6@50 passos) e AndroidWorld (46,6), superando Claude 3.7 e GPT-4o.

- Disponível em vários tamanhos (7B recomendado para execuções locais) com um aplicativo dedicado UI-TARS Desktop e integração MCP para fluxos de trabalho aumentados por ferramentas.

O que é UI-TARS?

UI-TARS é o pioneiro modelo de agente de GUI nativo da ByteDance, projetado para interação automatizada com interfaces gráficas do usuário. Lançado no início de 2025 com a atualização UI-TARS-1.5 em abril de 2025, representa uma mudança das estruturas de agentes modulares para um modelo de linguagem visual unificado e de ponta a ponta.

O modelo utiliza capturas de tela brutas como sua única entrada visual e gera ações precisas, como cliques do mouse (esquerdo, direito, duplo), arrastar, entrada de teclado, rolagem e sequências complexas — tudo sem depender de acesso ao DOM, árvores de acessibilidade ou APIs predefinidas.

Esta abordagem baseada apenas em capturas de tela torna o UI-TARS altamente generalizável entre plataformas (Windows, macOS, Linux, Android, navegadores web) e robusto contra mudanças na UI que quebram ferramentas de automação tradicionais.

Inovações Técnicas Centrais

O UI-TARS introduz várias inovações que explicam seu desempenho superior:

- Percepção Aprimorada: Treinado em grandes conjuntos de dados de capturas de tela de GUI para compreensão contextual e legendagem precisa de elementos.

- Modelagem de Ação Unificada: Padroniza ações em um único espaço entre plataformas, permitindo uma fundamentação precisa da visão para entradas de baixo nível (coordenadas do mouse, pressionamentos de teclas).

- Raciocínio do Sistema-2: Incorpora um pensamento deliberado de múltiplas etapas, incluindo decomposição de tarefas, reflexão, reconhecimento de marcos e recuperação de erros antes de agir.

- Treinamento Iterativo com Traços Online Reflexivos: Utiliza centenas de máquinas virtuais para gerar, filtrar e refinar automaticamente traços de interação. O modelo aprende com seus próprios erros por meio de ajuste reflexivo com intervenção humana mínima.

Essas inovações permitem que o UI-TARS seja eficazmente escalável no momento da inferência e se adapte a novas interfaces de forma mais confiável do que os agentes baseados em engenharia de prompts.

Benchmarks de Desempenho

A análise de avaliações oficiais mostra que o UI-TARS-1.5 lidera consistentemente os benchmarks de agentes de GUI:

-Trad-

- OSWorld: 24.6 (50 passos) e 22.7 (15 passos) — superando o Claude (22.0 / 14.9).

- AndroidWorld: 46.6 — superando o GPT-4o (34.5).

- Resultados SOTA adicionais em mais de 10 benchmarks, abrangendo percepção, grounding e execução de tarefas completas.

Os benchmarks indicam que a combinação de percepção baseada em visão e raciocínio integrado reduz o acúmulo de erros em tarefas de longo horizonte, em comparação com agentes que dependem fortemente de chamadas de ferramentas externas ou APIs de acessibilidade.

UI-TARS Desktop e Ecossistema de Agentes

A ByteDance fornece implementações práticas além do modelo base:

- UI-TARS Desktop: Um aplicativo Electron multiplataforma que transforma o modelo em um agente de desktop nativo. Os usuários fornecem instruções em linguagem natural e o agente visualiza a tela e controla o mouse/teclado.

- Agent TARS: Uma pilha de agentes multimodais mais ampla, suportando integrações de terminal, navegador e produtos.

- Integração MCP: Suporta o Model Context Protocol, permitindo a combinação perfeita com outros servidores MCP (por exemplo, banco de dados, Linear ou ferramentas Playwright) para fluxos de trabalho híbridos.

O agente de desktop suporta tanto inferência local (usando modelos do Hugging Face) quanto operação remota, com atualizações recentes adicionando recursos gratuitos de controle remoto de computador e navegador.

Como o UI-TARS se Compara a Outros Agentes de Uso de Computador

| Agente | Tipo de Entrada | Arquitetura | Código Aberto | Ponto Forte Principal | Destaque em Benchmark |

|---|---|---|---|---|---|

| UI-TARS-1.5 | Somente captura de tela | VLM de ponta a ponta + Raciocínio | Sim | Generalização & Reflexão | OSWorld, AndroidWorld |

| Claude Computer Use | Captura de tela + API | Prompt + Uso de Ferramentas | Não | Segurança & Ecossistema | Forte, mas inferior em tarefas longas |

| OpenAI Operator / CUA | Captura de tela | Proprietária | Não | Integração com ChatGPT | Competitivo, mas fechado |

| Anthropic Computer Use | Captura de tela | Base Claude 3.5/3.7 | Não | Confiabilidade em ambientes controlados | Pontuações menores que UI-TARS |

O feedback da comunidade sugere que o UI-TARS se destaca em tarefas de desktop do mundo real e de final aberto, onde os elementos da UI mudam frequentemente ou carecem de metadados de acessibilidade limpos.

Casos de Uso e Aplicações

- Automação de Desktop: Preenchimento de formulários, edição de documentos, gestão de arquivos ou execução de fluxos de trabalho complexos em software (por exemplo, sequências no Photoshop).

- Tarefas no Navegador: Web scraping, submissão de formulários, processos online de múltiplas etapas sem seletores frágeis.

- Automação Mobile e de Jogos: Interação com aplicativos Android e ambientes de jogo virtuais.

- Desenvolvimento e Testes: Geração e execução de testes baseados em GUI ou reprodução visual de bugs.

- Sistemas Híbridos de Agentes: Combinação com servidores MCP para tarefas que exigem tanto ações na GUI quanto acesso a dados do backend.

Dicas Avançadas, Casos Específicos e Armadilhas Comuns

- Implementação Local: O modelo de 7B executa eficientemente em hardware de consumo (especialmente versões quantizadas em Apple Silicon via MLX). Use configurações compatíveis com LM Studio ou Ollama para inferência de custo zero.

- Considerações de Segurança: Executar um agente de desktop completo requer cuidado com o sandboxing. Limite permissões e monitore ações em ambientes sensíveis.

- Tarefas de Longo Horizonte: Utilize as capacidades de reflexão do modelo fornecendo marcos claros nos prompts. A correção automática iterativa melhora significativamente as taxas de sucesso.

- Armadilhas a Evitar:

- Depender excessivamente de capturas de tela únicas para interfaces de usuário altamente dinâmicas (combine com memória de curto prazo ou ferramentas MCP).

- Ignorar nuances específicas de ação da plataforma (por exemplo, escala de coordenadas entre diferentes resoluções de tela).

- Esperar desempenho perfeito em interfaces altamente personalizadas ou de baixo contraste sem fine-tuning.

Para melhores resultados, combine o UI-TARS com prompts estruturados que incluam decomposição de tarefas e critérios de sucesso.

Começando

- Visite os repositórios oficiais do GitHub: bytedance/UI-TARS para o modelo e bytedance/UI-TARS-desktop para a aplicação de desktop.

- Baixe os modelos do Hugging Face (ByteDance-Seed/UI-TARS-1.5-7B).

- Para testes rápidos, experimente a aplicação de desktop ou as demonstrações baseadas no navegador.

- Explore a integração com MCP para agentes avançados que utilizam ferramentas.

Conclusão

UI-TARS representa um avanço significativo na automação de GUI, oferecendo um agente verdadeiramente nativo e de código aberto que vê a tela como um humano e raciocina antes de agir. Seu forte desempenho em benchmarks, aprendizado reflexivo e implementação prática para desktop posicionam-no como uma alternativa líder aos agentes comerciais fechados de uso de computador em 2026.

Desenvolvedores e usuários avançados que buscam automatizar tarefas repetitivas de GUI ou construir agentes multimodais mais capazes devem explorar o UI-TARS hoje. Comece com o modelo de 7B e a aplicação de desktop para vivenciar em primeira mão a automação orientada por capturas de tela e, depois, estenda-a com ferramentas MCP para fluxos de trabalho de produção.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.