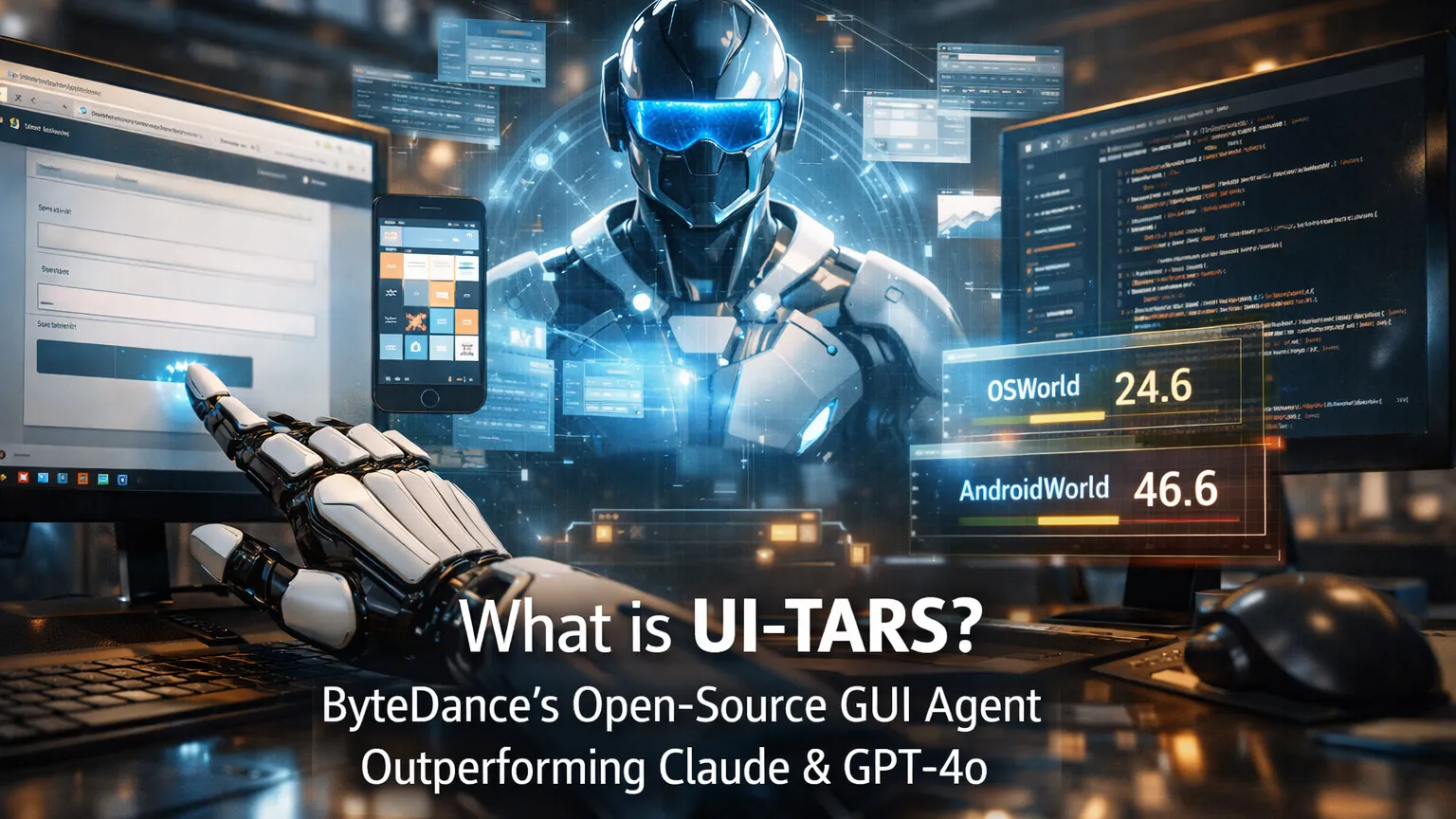

UI-TARSとは何か?ClaudeとGPT-4oを上回るByteDanceのオープンソースGUIエージェント

主なポイント

- UI-TARSは、User Interface — Task Automation and Reasoning Systemの略称で、ByteDance(TikTokの親会社)が開発したオープンソースのネイティブGUIエージェントです。

- これはマルチモーダルな視覚言語モデル(VLM)で、スクリーンショットのみを認識入力とし、デスクトップ、ブラウザ、モバイル環境において、人間のようにマウス、キーボード、スクロール操作を実行します。

- 商用モデルに大きく依存するプロンプト集約型フレームワークとは異なり、UI-TARSは、System-2推論、統合されたアクションモデリング、および反射的オンライン学習を組み込んだエンドツーエンドで学習されたモデルです。

- UI-TARS-1.5(2025年4月リリース)は、10以上のGUIベンチマーク(OSWorld (24.6@50 steps) および AndroidWorld (46.6) を含む)で最先端の結果を達成し、Claude 3.7やGPT-4oを上回っています。

- 複数のサイズで利用可能(ローカル実行には7B推奨)であり、専用のUI-TARS Desktopアプリケーションと、ツール拡張ワークフローのためのMCP統合を備えています。

UI-TARSとは?

UI-TARSは、ByteDanceが開発した、グラフィカルユーザーインターフェースとの自動対話を目的とした先駆的なネイティブGUIエージェントモデルです。2025年初頭にリリースされ、2025年4月のUI-TARS-1.5アップデートを経て、モジュラー型のエージェントフレームワークから、統合されたエンドツーエンド視覚言語モデルへの転換を象徴しています。

このモデルは、生のスクリーンショットを唯一の視覚入力として受け取り、マウスクリック(左、右、ダブル)、ドラッグ、キーボード入力、スクロール、複雑な操作シーケンスなどの精密なアクションを出力します。これらはすべて、DOMアクセス、アクセシビリティツリー、または事前定義されたAPIに依存することなく実行されます。

このスクリーンショットのみのアプローチにより、UI-TARSは様々なプラットフォーム(Windows、macOS、Linux、Android、ウェブブラウザ)に対して高い一般化性能を持ち、従来の自動化ツールを破綻させるUIの変更に対しても強固です。

中核となる技術的革新

UI-TARSは、その優れた性能を説明するいくつかの画期的な技術を導入しています:

拡張された知覚能力:文脈を意識した理解と精密な要素キャプション生成のために、大規模なGUIスクリーンショットデータセットで学習されています。

- 統合されたアクションモデリング:様々なプラットフォームにわたるアクションを単一の空間に標準化し、視覚情報から低レベルの入力(マウス座標、キー押下)への正確な接地(グラウンディング)を可能にします。

System-2推論:行動の前に、意図的な多段階思考(タスク分解、反射(リフレクション)、マイルストーン認識、エラー回復を含む)を組み込んでいます。

反射的オンライントレースを用いた反復的学習:数百台の仮想マシンを利用して、自動的にインタラクショントレースを生成、フィルタリング、洗練します。モデルは、最小限の人間の介入で反射的なチューニングを通じて自身の誤りから学習します。

これらの革新により、UI-TARSは推論時に効果的にスケールし、プロンプトエンジニアリングされたエージェントよりも信頼性高く新しいインターフェースに適応することができます。

性能ベンチマーク

公式評価の分析によると、UI-TARS-1.5はGUIエージェントベンチマークで一貫してリードしています:

e - OSWorld:24.6(50ステップ)および22.7(15ステップ) — Claude(22.0 / 14.9)を上回るパフォーマンス。

- AndroidWorld:46.6 — GPT-4o(34.5)を超える。

- 認識、グラウンディング、および完全タスク実行をカバーする10以上の追加ベンチマークでのSOTA結果。

ベンチマークは、外部ツール呼び出しやアクセシビリティAPIに大きく依存するエージェントと比較して、視覚ベースの認識と組み込み推論の組み合わせが、長期的タスクでのエラー累積を減少させることを示しています。

UI-TARSデスクトップとエージェントエコシステム

ByteDanceは基本モデルを超えた実用的な実装を提供しています:

- UI-TARSデスクトップ:モデルをネイティブデスクトップエージェントに変えるクロスプラットフォームElectronアプリケーション。ユーザーは自然言語指示を与え、エージェントは画面を視認しマウス/キーボードを制御します。

- エージェントTARS:ターミナル、ブラウザ、および製品統合をサポートするより広範なマルチモーダルエージェントスタック。

- MCP統合:Model Context Protocolをサポートし、他のMCPサーバー(例:データベース、Linear、またはPlaywrightツール)とシームレスに組み合わせてハイブリッドワークフローを実現します。

デスクトップエージェントは、ローカル推論(Hugging Faceのモデルを使用)とリモート操作の両方をサポートしており、最近のアップデートでは無料のリモートコンピューターおよびブラウザ制御機能を追加しました。

UI-TARSが他のコンピューター使用エージェントと比較して

| エージェント | 入力タイプ | アーキテクチャ | オープンソース | 主な強み | 注目すべきベンチマーク優位点 |

|---|---|---|---|---|---|

| UI-TARS-1.5 | スクリーンショットのみ | エンドツーエンドVLM + 推論 | はい | 汎化 & 反射 | OSWorld, AndroidWorld |

| Claudeコンピューター使用 | スクリーンショット + API | プロンプト + ツール使用 | いいえ | 安全性 & エコシステム | 強力だが長いタスクでは低い |

| OpenAI Operator / CUA | スクリーンショット | 独自 | いいえ | ChatGPTとの統合 | 競合的だがクローズド |

| Anthropicコンピューター使用 | スクリーンショット | Claude 3.5/3.7バックボーン | いいえ | 制御環境での信頼性 | UI-TARSより低いスコア |

コミュニティからのフィードバックは、UI-TARSが、UI要素が頻繁に変化したりクリーンなアクセシビリティメタデータを欠くような、オープンエンドの現実世界のデスクトップタスクで優れていることを示唆しています。

ユースケースと応用

- デスクトップの自動化: フォームへの入力、ドキュメントの編集、ファイル管理、複雑なソフトウェアワークフローの実行 (例: Photoshopのシーケンス操作)。

- ブラウザタスク: Webスクレイピング、フォーム送信、壊れやすいセレクターに依存しない多段階のオンラインプロセス。

- モバイル&ゲームの自動化: Androidアプリや仮想ゲーム環境とのインタラクション。

- 開発とテスト: GUIベースのテストの生成と実行、視覚的なバグの再現。

- ハイブリッドエージェントシステム: GUI操作とバックエンドデータアクセスの両方を必要とするタスクのために、MCPサーバーと組み合わせる。

高度なヒント、エッジケース、一般的な落とし穴

- ローカルでの導入: 7Bモデルはコンシューマ向けハードウェアで効率的に実行されます (特にMLXを介したApple Silicon上の量子化版)。ゼロコスト推論には、LM StudioまたはOllama互換のセットアップを利用してください。

- セキュリティの考慮事項: 完全なデスクトップエージェントの実行には注意深いサンドボックス化が必要です。権限を制限し、機密性の高い環境でのアクションを監視してください。

- 長期的なタスク: プロンプトに明確なマイルストーンを提供することで、モデルのリフレクション機能を活用できます。反復的な自己修正は成功率を大幅に向上させます。

- 回避すべき落とし穴:

- 非常に動的なUIに対して単一のスクリーンショットに過度に依存すること (短期記憶やMCPツールと組み合わせる)。

- プラットフォーム固有のアクションのニュアンスを無視すること (例: 異なる画面解像度間での座標スケーリング)。

- 高度にカスタマイズされた、または低コントラストなインターフェイスでの完璧なパフォーマンスを、ファインチューニングなしに期待すること。

最良の結果を得るには、タスクの分解と成功基準を含む構造化されたプロンプトとUI-TARSを組み合わせて使用してください。

はじめに

- 公式GitHubリポジトリにアクセス: モデルはbytedance/UI-TARS 、デスクトップアプリケーションはbytedance/UI-TARS-desktop 。

- Hugging Face (ByteDance-Seed/UI-TARS-1.5-7B) からモデルをダウンロード。

- クイックテストには、デスクトップアプリまたはブラウザベースのデモをお試しください。

- 高度なツール利用エージェントのためにMCI連携を探求してください。

まとめ

UI-TARSは、人間のように画面を見て、行動前に推論する、真にネイティブなオープンソースエージェントを提供することで、GUI自動化における重要な進歩を示しています。その強力なベンチマークパフォーマンス、反射的学習、実用的なデスクトップ実装により、2026年におけるクローズドな商用コンピュータ利用エージェントに対する有力な代替手段として位置づけられています。

繰り返しのGUIタスクを自動化したり、より能力の高いマルチモーダルエージェントを構築したい開発者やパワーユーザーは、今すぐUI-TARSを探求すべきです。7Bモデルとデスクトップアプリケーションから始めて、スクリーンショット駆動の自動化を直接体験し、その後、本番ワークフローのためにMCPツールで拡張してください。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.