Qu'est-ce que LongCat-Next ? Explication du modèle d'IA multimodale natif révolutionnaire de Meituan

Principaux points à retenir

- LongCat-Next est un modèle de base multimodal natif open-source développé par l'équipe LongCat de Meituan, publié en mars 2026.

- Il unifie le texte, la vision (images) et l'audio dans un unique espace de tokens discrets en utilisant le paradigme d'Autorégression Natale Discrète (DiNA) et la prédiction du token suivant (NTP).

- Basé sur l'architecture LongCat-Flash-Lite MoE (A3B : ~68,5B paramètres totaux, 3B actifs), il prend en charge la compréhension et la génération transmodales avec un biais inductif minimal.

- Les innovations clés incluent le tokeniseur dNaViT (Transformeur de Vision à Résolution Variable et Natale Discrète), permettant une forte compression (jusqu'à 28×) tout en préservant la qualité, notamment pour le rendu du texte.

- Les benchmarks montrent des performances compétitives face à des modèles spécialisés pour la compréhension visuelle, la génération d'images, la compréhension de la parole et l'interaction vocale à faible latence.

- Entièrement open-source sous licence MIT sur Hugging Face et GitHub, avec le code d'inférence et une démo en ligne disponibles.

Qu'est-ce que LongCat-Next ?

LongCat-Next représente un changement significatif dans l'architecture de l'IA multimodale. Contrairement aux systèmes traditionnels en "patchwork" qui greffent des encodeurs visuels ou des modules de parole sur un cœur de modèle linguistique, ce modèle traite toutes les modalités comme des éléments natifs au sein d'un même cadre unifié.

Développé par l'équipe LongCat de Meituan, LongCat-Next lexicalise les modalités sous forme de tokens discrets. Les images, les formes d'onde audio et le texte sont tokenisés dans un vocabulaire partagé, permettant au modèle de les traiter et de les générer en utilisant le même objectif autorégressif : prédire le token suivant.

Cette approche d'"Autorégression Natale Discrète" (DiNA) minimise la complexité architecturale et les biais inductifs au-delà du paradigme de modélisation du langage. Le résultat est un système plus élégant et scalable, capable de véritables capacités multimodales de tout-à-tout.

Architecture centrale et innovations techniques

Autorégression Natale Discrète (DiNA)

Au cœur de LongCat-Next, le paradigme de prédiction du token suivant est étendu à toutes les modalités. Des paires de tokeniseurs convertissent les entrées en ID discrets :

- Texte : Tokenisation sublexicale standard.

- Vision : Traitée via dNaViT — un Transformeur de Vision à Résolution Variable et Natale Discrète qui gère des tailles d'image variables sans artefacts de redimensionnement ou de division en patchs fixes.

- Audio : Converti en tokens discrets prenant en charge la compréhension, la génération et la conversation à faible latence.

Tous les tokens alimentent une architecture MoE (Mélange d'Experts) partagée. Cela permet un raisonnement transmodal transparent, comme décrire une image tout en générant de l'audio associé, ou vice versa.

Échelle et efficacité du modèle

- Architecture de base : LongCat-Flash-Lite MoE avec approximativement 68,5 milliards de paramètres totaux et 3 milliards de paramètres actifs par étape d'inférence.

- Efficacité : L'approche par tokens discrets et la conception MoE maintiennent l'inférence légère par rapport aux modèles denses de capacités similaires.

- Compression : Atteint une forte qualité générative avec des taux de compression élevés (par exemple, 28× pour les images), excellant particulièrement dans le rendu précis du texte au sein des visuels générés.

L'architecture prend en charge à la fois la compréhension multimodale (par exemple, réponse à des questions visuelles, transcription vocale avec contexte) et la génération (par exemple, texte-à-image, édition d'image via des tokens, synthèse vocale).

Performances et évaluations de référence

L'analyse des rapports techniques publiés et des évaluations communautaires indique que LongCat-Next fournit des résultats de niveau industriel à travers les domaines :

- Compréhension visuelle : Compétitif avec les modèles spécialisés vision-langage sur des évaluations impliquant des scènes complexes, des documents et des entrées à n'importe quelle résolution. Il gère efficacement des formules mathématiques denses, des images riches en OCR et des photos du monde réel.

- Génération d'images : Maintient une haute fidélité et cohérence, avec une force notable dans le rendu de texte lisible au sein des images — une faiblesse courante dans de nombreux systèmes multimodaux.

- Audio/Parole : Excelle dans la compréhension avancée de la parole, les conversations vocales à faible latence et le clonage vocal personnalisable. Il supporte des interactions multimodales naturelles, comme parler tout en faisant référence à un contenu visuel.

- Tâches inter-modales : Forte performance dans les tâches unifiées comme le sous-titrage d'images avec descriptions audio ou la génération de visuels à partir de consignes parlées.

Les évaluations de référence le positionnent comme très compétitif au sein des architectures discrètes, égalant souvent ou approchant des systèmes plus grands ou spécialisés tout en offrant une plus grande simplicité architecturale.

Les retours de la communauté suggèrent des avantages particuliers dans les cas limites du monde réel, comme la numérisation de documents en faible luminosité ou les dialogues en modalités mixtes.

En quoi LongCat-Next diffère des modèles multimodaux traditionnels

La plupart des grands modèles de langage multimodaux (MLLM) actuels reposent sur un cœur centré sur le langage avec des encodeurs auxiliaires :

- Les données visuelles sont projetées dans l'espace d'embeddings du LLM via des adaptateurs ou de l'attention croisée.

- Les modules audio sont souvent des pipelines séparés.

Cela crée des défis d'alignement, une latence accrue et des instabilités lors de l'entraînement.

Les avantages de LongCat-Next :

- Espace de tokens unifié : Toutes les modalités deviennent le "langage natif" du modèle, réduisant les écarts entre modalités.

- Objectif unique : La pure prédiction du token suivant sur tous les contenus simplifie l'entraînement et la mise à l'échelle.

- Biais réduit : Minimalisation des biais inductifs supplémentaires au-delà de l'autorégression.

- Simplicité de déploiement : L'architecture de base partagée facilite l'optimisation de l'inférence et le service multimodal.

Ce changement de paradigme vise à rapprocher l'IA de la capacité à traiter de manière cohésive les signaux entrelacés du monde physique (vue, son, texte).

Pour débuter avec LongCat-Next

Accès et Ressources

- Hugging Face : meituan-longcat/LongCat-Next — poids du modèle, safetensors et intégration Transformers.

- GitHub : Dépôt complet incluant le code d'inférence, l'implémentation modulaire et le rapport technique PDF.

- Démo : Expérience interactive disponible sur longcat.chat/longcat-next.

- Licence : MIT — adaptée à la recherche et aux applications commerciales.

Conseils d'Utilisation de Base

Le modèle prend en charge les pipelines Transformers standard avec des extensions personnalisées pour les entrées multimodales. Exemple de code (extrait du dépôt) :

# Pseudocode pour l'inférence multimodale

from transformers import AutoModelForCausalLM

model = AutoModelForCausalLM.from_pretrained("meituan-longcat/LongCat-Next")

# Tokeniser des entrées mixtes (texte + image + audio)

inputs = tokenizer.process_multimodal(prompt, image=image_tensor, audio=audio_tensor)

outputs = model.generate(inputs)

Conseils Avancés :

- Utilisez dNaViT pour les images à n'importe quelle résolution afin d'éviter la perte de qualité due au redimensionnement.

- Pour les tâches de génération, expérimentez avec un contrôle au niveau des tokens pour une meilleure cohérence intermodale.

- Utilisez la quantification (par exemple, les versions 4 bits disponibles dans les dépôts communautaires) pour un déploiement sur matériel grand public.

Pièges Courants et Cas Particuliers

- Gestion du Budget de Tokens : Les entrées audio de haute résolution ou de longue durée consomment plus de tokens ; priorisez les régions clés ou utilisez des stratégies de compression.

- Alignement Intermodal : Bien qu'unifié, les tâches complexes entrelacées peuvent nécessiter un prompt engineering minutieux pour une cohérence optimale.

- Optimisation de l'Inférence : Les modèles MoE bénéficient de configurations en parallélisme d'experts ; consultez le dépôt dédié à l'inférence pour les meilleures pratiques.

- Considérations Matérielles : La pleine précision nécessite une quantité importante de VRAM ; commencez par les variantes quantifiées pour les tests.

Surveillez les discussions communautaires pour découvrir les techniques de fine-tuning émergentes et les adaptations spécifiques aux applications.

Applications Potentielles et Implications Futures

LongCat-Next ouvre la voie à des systèmes d'IA plus intégrés :

- Agents du Monde Réel : Robots ou applications qui perçoivent les images, traitent la parole et répondent multimodalement dans un seul modèle.

- Outils Créatifs : Génération unifiée image+audio+texte pour la création de contenu.

- Accessibilité : Compréhension améliorée des documents avec interaction vocale.

- IA du Monde Physique : Un pas vers des modèles qui traitent les entrées sensorielles aussi couramment que le langage.

En tant que publication open-source, il invite les développeurs à créer des extensions, des fine-tunes et des variantes spécifiques à des domaines, accélérant ainsi les progrès multimodaux.

Conclusion

LongCat-Next se distingue comme une avancée réfléchie dans la modélisation multimodale native. En unifiant les modalités sous un cadre autorégressif discret, il simplifie l'architecture tout en offrant des performances compétentes pour voir, créer et parler.

Pour les développeurs, les chercheurs et les passionnés d'IA, ce modèle open-source fournit une base pratique pour expérimenter avec de véritables capacités n'importe-quel-à-n'importe-quel. Explorez le dépôt Hugging Face, consultez le rapport technique et testez la démo en ligne pour découvrir le paradigme DiNA de première main.

Commencez à développer avec LongCat-Next dès aujourd'hui et contribuez à l'évolution du paysage de l'IA multimodale unifiée.

Prêt à vous plonger dedans ? Visitez la démo officielle ou clonez le dépôt GitHub pour commencer à expérimenter.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Qu'est-ce qu'OC Maker ? L'outil d'IA révolutionnant la création de personnages originaux en 2026

Google Investit Jusqu'à 40 Milliards de Dollars dans Anthropic avec un Soutien de 5 GW de Puissance Informatique : La Course à l'IA Entre dans une Nouvelle Ère

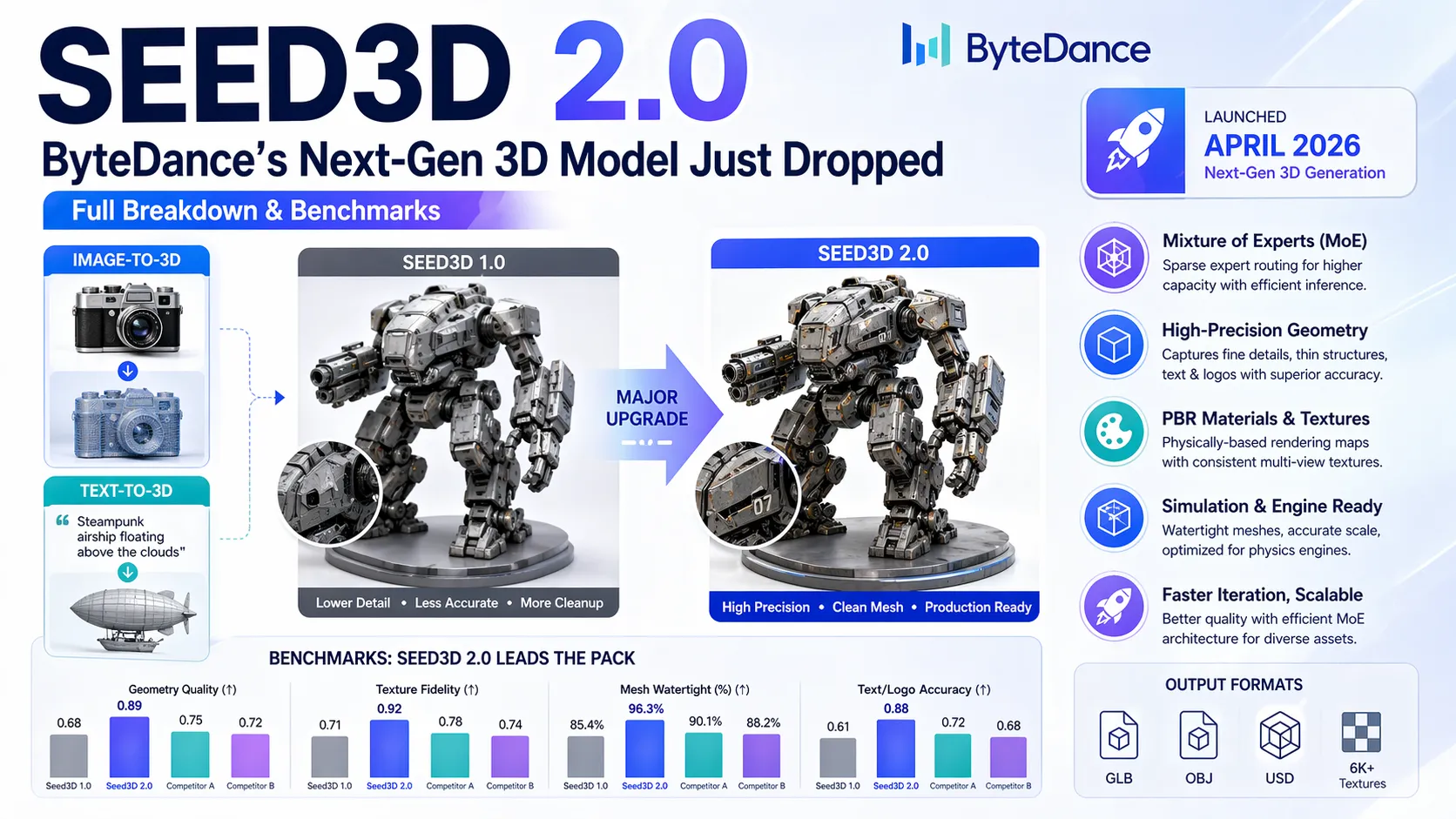

Seed3D 2.0 : Le modèle de nouvelle génération 3D de ByteDance est arrivé – Analyse complète et benchmarks

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.