Was ist LiteLLM? Das universelle Gateway für 140+ LLM-Anbieter im Jahr 2026

Wichtigste Punkte

- LiteLLM ist eine Open-Source-Python-Bibliothek und ein selbst gehostetes KI-Gateway/-Proxy, das eine einzelne OpenAI-kompatible Schnittstelle zu 140+ KI-Modell-Anbietern und 2.500+ Modellen bietet, darunter OpenAI, Anthropic, Google Gemini, AWS Bedrock, Azure, Mistral, Ollama, vLLM und neue Optionen wie Nebius AI.

- Es übernimmt Modell-Routing, Kostenverfolgung, Lastausgleich, Fallbacks, Caching, Guardrails und Observability – und beseitigt gleichzeitig anbieterspezifischen Code.

- Analysen zeigen, dass LiteLLM den Integrationsaufwand für mehrere Anbieter um 60-80% reduziert und über 1 Milliarde Anfragen in Produktionsumgebungen mit mehr als 240 Millionen Docker-Pulls verarbeitet hat.

- Das Projekt bietet sowohl ein leichtgewichtiges Python SDK für die Code-Ebene als auch einen voll ausgestatteten Proxy-Server mit Admin-UI, virtuellen Schlüsseln, Budgets und Unternehmens-Governance (SSO/RBAC in kommerzieller Lizenz verfügbar).

- Stand März 2026 hat LiteLLM etwa 40k GitHub-Sterne und 1.300+ Mitwirkende, mit schnellen Modell-Ergänzungen (z.B. GPT-5.4, Gemini 3.x, FLUX Kontext in v1.82.3) und nativer Unterstützung für Agents und MCP.

Was ist LiteLLM?

LiteLLM fungiert als universeller Übersetzer und operationelle Schicht für Large Language Models. Entwickler rufen jedes unterstützte Modell über das vertraute OpenAI-Format chat.completions auf, während LiteLLM Authentifizierung, Schema-Übersetzung, Wiederholungsversuche und Verbesserungen transparent verwaltet.

Von BerriAI gewartet und von Y Combinator unterstützt, unterstützt LiteLLM Completions, Embeddings, Bildgenerierung, Audiotranskription, Reranking, Batches und sogar A2A-/MCP-Protokolle. Es funktioniert nahtlos sowohl mit kommerziellen Cloud-Anbietern als auch mit lokalen/selbstgehosteten Laufzeitumgebungen.

Kernphilosophie: Einmal schreiben, überall ausführen – Modelle oder Anbieter mit nur einer Konfigurationsänderung wechseln.

Kernfunktionen, die die Nutzung vorantreiben

- Vereinheitlichte OpenAI-kompatible API: Konsistentes Anfrage-/Antwort-Format mit automatischer Fehlerzuordnung über alle Anbieter hinweg.

- KI-Gateway (Proxy-Server): Docker-fähiger zentraler Dienst mit Dashboard, virtuellen Schlüsseln, Budgets pro Schlüssel/Team, Ratenbegrenzung (RPM/TPM) und Lastausgleich.

- Integrierte Kosten- & Ausgabenverwaltung: Echtzeit-Tracking mit benutzerdefinierten Preisen, Anbietermargen und Exporten zu Langfuse, Prometheus, OpenTelemetry und mehr.

- Zuverlässigkeits-Engine: Automatische Fallbacks, Wiederholungsversuche, nutzungsbasiertes oder einfaches Routing, Redis-Caching und Guardrails.

- Observability & Protokollierung: Callbacks für LangSmith, Helicone, Lunary, MLflow und native Prometheus-Metriken.

- Erweiterte Funktionen: Streaming, strukturierte Ausgaben, Function Calling, Policy-as-Code und native MCP-/A2A-Unterstützung.

- Unternehmens-Governance: SSO (Okta, Azure AD), RBAC, Audit-Logs und kostenpflichtige kommerzielle Funktionen für großflächige Bereitstellungen.

SDK vs Proxy: Die richtige Deployment-Strategie auswählen

Python SDK (leichtgewichtig):

- Ideal für Prototyping, Skripte oder direkte Integration in Anwendungen.

- Keine Infrastruktur-Overhead.

Proxy Server (empfohlen für Produktionsumgebungen):

- Zentrale Governance-Schicht, auf die jeder OpenAI-kompatible Client via

base_urlzugreifen kann. - Perfekt für Teams, die Schlüsselmanagement, Budgets und Observability benötigen.

Community-Benchmarks zeigen, dass die meisten Organisationen mit dem SDK beginnen und zum Proxy migrieren, wenn der Nutzungsskalierung steigt.

Schnellstart-Beispiele

SDK-Verwendung

import litellm

response = litellm.completion(

model="gpt-4o",

messages=[{"role": "user", "content": "Explain LiteLLM in one sentence."}]

)

# Provider sofort wechseln

response = litellm.completion(

model="anthropic/claude-3-5-sonnet-20241022",

messages=[{"role": "user", "content": "Explain LiteLLM in one sentence."}]

)

Proxy Server (Docker)

docker run -p 4000:4000 ghcr.io/berriai/litellm:main-latest \

--config /path/to/config.yaml

Modelle, Schlüssel, Budgets und Routen können in config.yaml definiert werden, um eine zentrale Kontrolle zu ermöglichen.

LiteLLM vs Andere LLM Gateways: Vergleich 2026

| Feature | LiteLLM | Bifrost (Maxim AI) | Portkey | Cloudflare AI Gateway |

|---|---|---|---|---|

| Provider Coverage | 140+ / 2,500+ models | Strong | 200+ | Moderate |

| Language / Performance | Python (low-medium latency) | Go (ultra-low ~11μs) | Node.js | Edge-optimized |

| Cost Tracking | Native + custom | Advanced | Strong | Basic |

| Governance (SSO/RBAC) | Enterprise license | Strong | Excellent | Limited |

| Open Source | Fully open-source | Self-hosted free | Hybrid | Proprietary |

| Best For | Flexibility & broad coverage | High-scale production | Enterprise compliance | Edge deployments |

Die Analyse zeigt, dass LiteLLM die Standardwahl für Python-first Teams und breite Modell-Experimentierung bleibt, während Go-basierte Alternativen wie Bifrost bei ultra-hoher Concurrency hervorragend sind.

Anwendungsbeispiele aus der Praxis

- Multi-Model-Anwendungen: Dynamisches Routing zum kostengünstigsten oder leistungsstärksten Modell basierend auf der Aufgabenkomplexität.

- Kostenoptimierung und Budgetierung: Durchsetzung von Kostenlimits pro Benutzer/Team mit automatischen Alerts.

- Hohe Verfügbarkeit: Automatische Fallback-Mechanismen verhindern Ausfälle während Provider-Störungen.

- Enterprise Compliance: Virtuelle Keys, Audit-Trails und Guardrails erfüllen Sicherheitsanforderungen.

- Hybrid Cloud + Lokal: Nahtlose Kombination von Ollama/selbst-gehosteten Modellen mit Cloud-Providern.

LiteLLM wird alles von frühen Startups bis zu großen ML-Platform-Teams unterstützt.

Häufige Fallstricke und fortgeschrittene Tipps

- Latenz bei hoher Parallelität: Python-Overhead kann bei 500+ RPS mehrere hundert Mikrosekunden hinzufügen; mit Prometheus überwachen und für extreme Skalierung Go-basierte Gateways in Betracht ziehen.

- Datenbank-Performance: Intensive Protokollierung in PostgreSQL kann ein Engpass werden — Redis-Caching frühzeitig aktivieren und Connection-Pools optimieren.

- Cold Starts: Große Package-Imports können den Start verzögern; selektive Importe (

from litellm import completion) oder Lazy Loading verwenden. - Caching-Fallstricke: Abgelaufene Cache-Response tauchen sporadisch auf; Cache-TTL für zeitkritische Abfragen immer validieren.

- Fortgeschrittene Tipps: Nutze Custom Callbacks und Policy-as-Code für feingranulierte Kontrolle, wie zum Beispiel Blockieren von PII oder Durchsetzung von Output-Formaten.

- Edge Cases: Nicht jeder Provider unterstützt identische Features (z.B. bestimmte Tool-Calling-Varianten); kritische Pfade immer über Zielmodelle testen.

Teams, die diese Punkte proaktiv behandeln, erreichen deutlich höhere Zuverlässigkeit und geringeren operationalen Aufwand.

Die Zukunft von LiteLLM

Mit konsistenten Major Releases und wachsender Ecosystem-Integration (inklusive tieferer MCP und Agent-Support) festigt LiteLLM weiterhin seine Position als Open-Source-Standard für LLM-Abstraktion. Erwarte expanded Enterprise-Features, noch schnelleres Routing und breitere Protocol-Support in 2026.

Fazit

LiteLLM eliminiert die Friktion fragmentierter LLM-APIs und ermöglicht Entwickler- und Platform-Teams, sich auf den Bau intelligenter Anwendungen zu konzentrieren, statt mit Vendor-Differenzen zu kämpfen. Ob du ein einfaches SDK für schnelles Prototyping oder ein robustes Gateway für Production Governance benötigst, LiteLLM bietet unerreichte Flexibilität im großen Umfang.

Starte heute: pip install litellm, deploye den Proxy via Docker, oder erkunde die vollständige Dokumentation auf docs.litellm.ai. Die Zukunft des vereinheitlichten LLM-Zugangs ist bereits hier.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Was ist OC Maker? Das KI-Tool, das die Erstellung von Originalcharakteren 2026 revolutioniert

Google investiert bis zu 40 Milliarden Dollar in Anthropic mit 5GW Rechenleistung: Das KI-Wettrüsten tritt in eine neue Ära

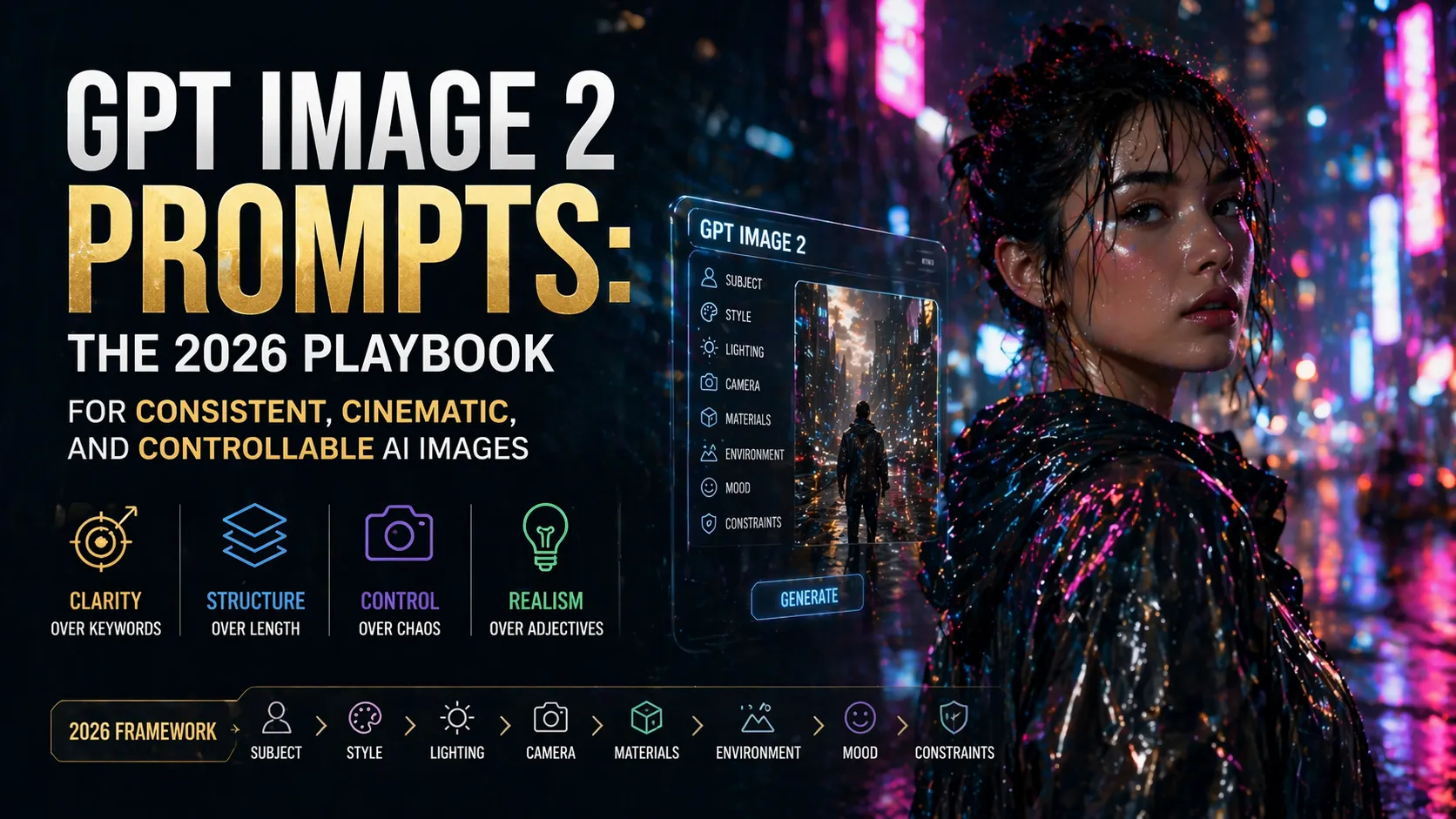

GPT Bild 2 Prompts: Das Playbook 2026 für konsistente, kinematische und kontrollierbare KI-Bilder

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.