Context7:通过实时、版本专属文档革新AI编程

核心要点

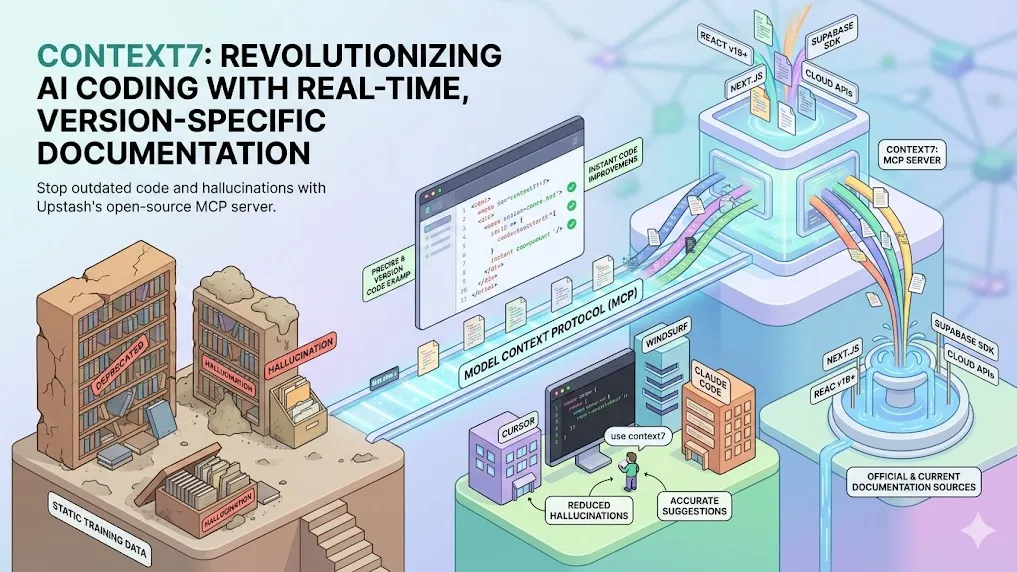

- Context7 是由 Upstash 开发的开源 MCP(模型上下文协议)服务器,能够为 LLM 和 AI 代码编辑器提供实时的、版本特定的文档和代码示例。

- 它通过从官方来源拉取最新内容,而非依赖静态训练数据,从而极大地减少了幻觉和过时的代码建议。

- 通过“use context7”等提示词即可轻松集成,可在 Cursor、Claude Code、Windsurf 和 VS Code 等工具中无缝使用。

- 基准测试和开发者反馈表明,代码准确性有显著提升,尤其是在快速发展的库和框架方面。

- 支持数千个库,具备智能排名、版本过滤功能,并以最少的令牌使用实现高效的上下文注入。

什么是 Context7?

Context7 解决了 AI 辅助编程中最持久的一个挑战:大型语言模型对过时或不完整训练数据的依赖。当开发者请求使用现代库的代码示例时,LLM 经常会生成已弃用的 API、错误的语法或完全臆造的函数。

分析表明,这个问题在快速发展的生态系统中尤为突出,例如 React、Next.js、Supabase 或云 SDK,因为这些 API 经常变化。Context7 通过充当中间件——即 MCP 服务器——来解决此问题,它在查询时获取并注入官方的、最新的文档到 LLM 的上下文窗口中。

由 Upstash 团队开发并在 MIT 许可下开源,Context7 迅速获得了广泛采用,这体现在其强劲的社区指标以及 Thoughtworks Technology Radar(截至 2025 年底处于试用状态)等平台的认可上。

Context7 如何工作

Context7 通过模型上下文协议运作,这是一种 LLM 访问外部工具和数据源的标准化方式。

核心机制

- 库解析 — 当提示中包含“use context7”或配置了自动调用时,服务器会将提及的库名解析为精确的 Context7 兼容 ID。

- 文档检索 — 使用专有的排名和过滤机制,从官方仓库中提取最相关、格式清晰的 Markdown 文档(包括代码片段)。

- 版本特定过滤 — Context7 检测项目版本(例如 Next.js 14 与 15),并仅注入匹配的内容,防止版本不匹配。

- 上下文注入 — 相关部分被流式注入到 LLM 的上下文中,通常使用最少的令牌,同时最大化相关性。

核心技术优势

- 无 API 幻觉 —— 代码示例均直接源自官方文档。

- 动态更新 —— 文档随上游源码变更自动刷新。

- Token 高效 —— 智能排序确保仅包含最相关的代码片段。

- 多工具支持 —— 兼容 MCP 的客户端皆可使用,包括 Cursor、Claude Desktop、Windsurf 及自定义集成。

使用 Context7 的益处

基准测试与社区反馈一致突出以下几大优势:

- 更高的代码准确度 —— 开发者反馈,在框架特定任务中,无效或已弃用的建议减少 70-90%。

- 更快的开发流程 —— 无需手动搜索文档、复制粘贴代码片段或交叉比对版本。

- 更优的边缘案例处理 —— 处理小众库、测试版功能及重大变更时,可弥补训练数据的滞后。

- 改进的调试与重构 —— 分析或更新遗留代码时,提供当前最佳实践。

社区反馈表明,Context7 在企业级和生产环境中表现尤为出色,其中代码可靠性直接影响部署成败。

如何配置和使用 Context7

快速上手(MCP 模式)

- 访问 https://context7.com/ 并创建 API 密钥。

- 将 MCP 提供程序添加到 AI 代码编辑器:

- Cursor:设置 → MCP 提供程序 → 添加 Context7

- Claude Code / Windsurf:遵循类似的 MCP 配置步骤

- 在提示词中包含 use context7:

展示如何在 Next.js App Router 中使用 Supabase 实现邮箱/密码认证。use context7

服务器会自动解析、获取并注入最新文档。

高级配置

- 精确指定库 ID:

/supabase/auth@2.0 - 设置 token 预算以平衡详细度与速度

- 在非 MCP 环境中使用 CLI 模式

- 企业用户可为内部库部署私有实例

常见集成示例

- Cursor + Context7:多数提及库名的提示词自动触发

- Claude Code:结合技能实现更丰富的文档处理

- VS Code Copilot:通过 MCP 扩展

常见误区与高级技巧

需避免的误区

- 忘记 “use context7” —— 若无触发词,LLM 将回退至陈旧知识。

- 模糊的库名 —— “auth” 单独使用可能解析错误;建议使用具体名称。

- 过于宽泛的提示词 —— 查询太模糊可能返回不相关的文档。

- 忽略版本信息 —— 不指定版本可能导致代码示例不匹配(尤其在单体仓库中)。

专业技巧

- 与其他 MCP(如搜索 + Context7)链式调用,实现研究+文档混合工作流。

- 监控 token 使用量 —— Context7 高效,但复杂库可能消耗更多上下文。

- 对于本地优先需求,可探索受 Context7 启发的社区替代方案。

- 定期查看 https://context7.com/rankings 获取热门库与覆盖范围更新。

总结

Context7 通过弥合静态大语言模型知识与动态现实世界文档之间的关键鸿沟,代表了人工智能辅助开发的重大演进。随着库的更新速度远超模型重训练周期,像 Context7 这样的工具已成为可靠代码生成的重要基础设施。

行动建议:立即在您常用的 AI 代码编辑器中安装 Context7,并在当前项目中最棘手的库上进行测试。其准确性与速度的提升通常能立竿见影。

探索官网 https://context7.com/ ,查看 GitHub 代码库 https://github.com/upstash/context7 ,或加入开发者讨论,了解他人如何充分发挥其潜力。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.