Context7: リアルタイム・バージョン固有ドキュメントによるAIコーディングの革命

主なポイント

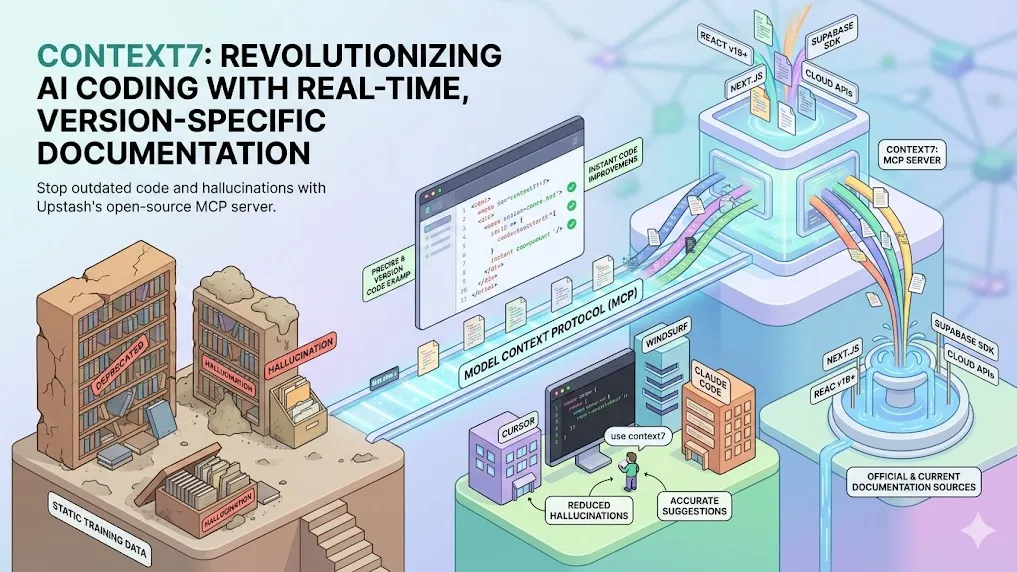

- Context7は、Upstashによって開発されたオープンソースのMCP(Model Context Protocol)サーバーであり、リアルタイムでバージョン固有のドキュメントとコード例をLLMやAIコードエディタに直接提供します。

- 静的トレーニングデータに依存する代わりに、公式ソースから最新のコンテンツを取得することで、誤った推論(ハルシネーション)や古いコード提案を劇的に減らします。

- 「use context7」のようなプロンプトによる簡単な統合で、Cursor、Claude Code、Windsurf、VS Codeなどのツールでシームレスに使用できます。

- ベンチマークと開発者のフィードバックによれば、特に急速に進化するライブラリやフレームワークにおいて、コードの正確性が大幅に向上していることが示されています。

- 数千以上のライブラリをサポートし、インテリジェントなランキング、バージョンフィルタリング、最小限のトークン使用による効率的なコンテキスト注入を実現します。

Context7とは?

Context7は、AI支援コーディングにおける最も根深い課題の一つである 大規模言語モデル(LLM)が古い、または不完全なトレーニングデータに依存していること に対処します。開発者が現代的なライブラリを使用したコード例を要求すると、LLMは頻繁に廃止されたAPI、誤った構文、または完全に事実に基づかない機能を生成してしまいます。

分析によれば、この問題はReact、Next.js、Supabase、クラウドSDKなどAPIが頻繁に変更される高速に進化するエコシステムで特に深刻になります。Context7はこの問題を、クエリ時に 公式の最新ドキュメント を取得し、LLMのコンテキストウィンドウに注入する仲介者——MCPサーバー——として機能することで解決します。

Upstashチームによって開発され、MITライセンスの下でオープンソース化されたContext7は急速に普及し、強力なコミュニティ指標やThoughtworks Technology Radar(2025年末時点でTrialステータス)のようなプラットフォームからの支持にその勢いが反映されています。

Context7の仕組み

Context7は Model Context Protocol(MCP) を通じて動作します。これは、LLMが外部ツールやデータソースにアクセスするための標準化された方法です。

コアメカニズム

- ライブラリ解決 — プロンプトに「use context7」が含まれるか、自動呼び出しが設定されている場合、サーバーは言及されたライブラリ名を正確なContext7互換のIDに解決します。

- ドキュメント取得 — 独自のランキングとフィルタリングを使用して、公式リポジトリからコードスニペットを含む、最も関連性の高い、クリーンなMarkdown形式のドキュメントを取得します。

- バージョン固有フィルタリング — Context7はプロジェクトのバージョン(例:Next.js 14 vs 15)を検出し、一致するコンテンツのみを注入し、不一致を防ぎます。

- コンテキスト注入 — 関連するセクションがLLMのコンテキストにストリーミングされます。通常、関連性を最大化しながら最小限のトークン使用で行われます。

主な技術的メリット

- APIに関する誤った情報の排除 — コード例はすべてソースドキュメントから直接取得されます。

- 動的更新 — ドキュメントは上流ソースの変更に応じて自動的に更新されます。

- トークン効率 — インテリジェントなランキングにより、最も関連性のあるスニペットのみが含まれます。

- 複数ツールサポート — MCP対応クライアント(Cursor、Claude Desktop、Windsurf、カスタム統合など)で動作します。

Context7を使用するメリット

ベンチマークやコミュニティからの報告は、以下のようなメリットを一貫的に強調しています:

- コード精度の向上 — 開発者はフレームワーク固有のタスクにおいて、無効または廃止された提案が70〜90%減少したと報告しています。

- 作業フローの高速化 — ドキュメントを手動で検索したり、スニペットをコピー&ペストしたり、バージョンをクロスリファレンスする必要がなくなります。

- エッジケースへの対応強化 — ニッチなライブラリ、ベータ機能、そしてトレーニングデータが遅れている破壊的変更を扱います。

- デバッグとリファクトリングの改善 — レガシーコードを分析または更新する際に、現在のベストプラクティスを提供します。

コミュニティのフィードバックによれば、Context7はコードの信頼性がデプロイ成功率に直接影響する、企業環境やプロダクション環境で最も効果を発揮します。

Context7のセットアップと使用方法

クイックスタート(MCPモード)

- https://context7.com/ にアクセスし、APIキーを作成します。

- AIコードエディタにMCPプロバイダを追加します:

- Cursor:設定 → MCPプロバイダ → Context7を追加

- Claude Code / Windsurf:類似のMCP設定手順を実行

- プロンプトで use context7 を含める:

Show me how to implement email/password auth with Supabase in Next.js App Router. use context7

サーバーが自動的に解決、取得、そして最新のドキュメントを挿入します。

高度な設定

- 精度を高めるためにライブラリIDを明示的に指定:

/supabase/auth@2.0 - 詳細と速度のバランスのためにトークンバジェットを設定

- 非MCP環境ではCLIモードを使用

- エンタープライズユーザーは内部ライブラリ用にプライベートインスタンスをホストできます

一般的な統合例

- Cursor + Context7:ライブラリを言及するほとんどのプロンプトに対して自動的に動作

- Claude Code:スキルと組み合わせて、さらに豊富なドキュメント処理を実現

- VS Code Copilot:MCP拡張機能を通じて

一般的な落とし穴と高度なヒント

避けるべき落とし穴

- 「use context7」を忘れる — トリガーなしではLLMは古い知識に戻ります。

- 曖昧なライブラリ名 — 「auth」だけでは誤って解決される可能性があります。具体的な名前を優先してください。

- 過度に広範なプロンプト — 曖昧すぎるクエリは関連性の低いドキュメントを返します。

- バージョン情報を無視する — バージョンを指定しないと、モノレポで不一致の例が発生する可能性があります。

プロのヒント

- 他のMCPと連鎖させる(例:検索 + Context7)ことで、ハイブリッド調査 + ドキュメントワークフローを実現。

- トークン使用を監視 — Context7は効率的ですが、複雑なライブラリはより多くのコンテキストを消費します。

- ローカルファーストのニーズには、Context7に触発されたコミュニティの代替案を検討。

- https://context7.com/rankings を定期的にチェックし、最も人気のあるライブラリとカバレッジ更新を確認。

結論

Context7は、静的LLM知識と動的な現実世界のドキュメント間の重要なギャップを橋渡しすることで、AI支援開発における大きな進化を象徴しています。ライブラリがモデルの再トレーニングサイクルよりも速く進化する中で、Context7のようなツールは、信頼性のあるコード生成に欠かせないインフラストラクチャとなります。

行動ステップ: お使いのAIコードエディターにContext7を今すぐインストールし、現在のプロジェクトで最も厄介なライブラリでテストしてください。精度と速度の向上は、多くの場合すぐに実感できます。

公式サイト https://context7.com/ で詳細を確認し、GitHubリポジトリ https://github.com/upstash/context7 でレビューを参照、または開発者ディスカッションに参加して、他のユーザーがその可能性を最大限に活用している方法を見てみましょう。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.