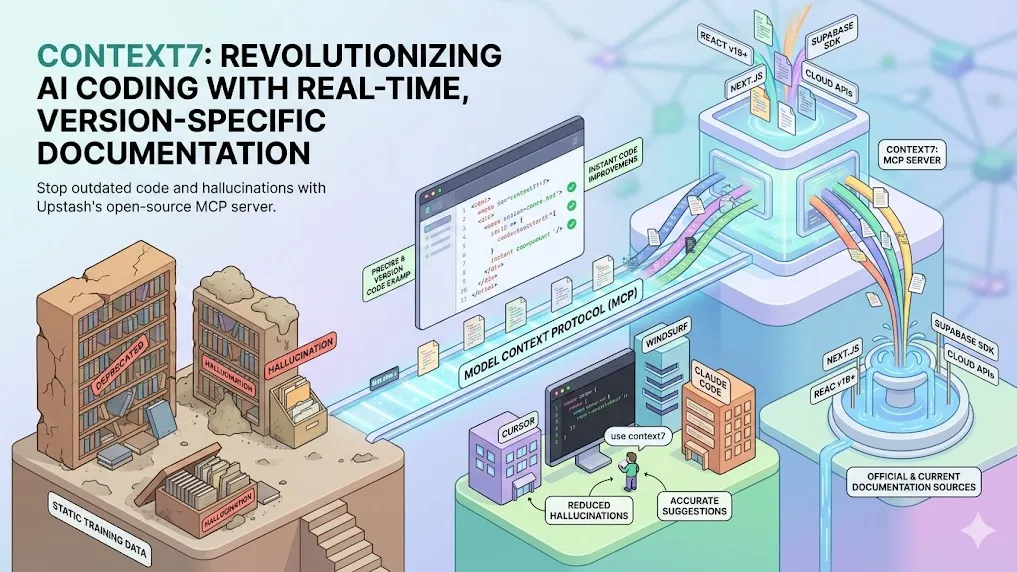

Context7 : Révolutionner le codage IA avec une documentation en temps réel et spécifique aux versions

Principaux points à retenir

- Context7 est un serveur MCP (Model Context Protocol) open-source développé par Upstash, qui fournit en temps réel de la documentation spécifique à une version et des exemples de code directement aux LLM et aux éditeurs de code IA.

- Il réduit considérablement les hallucinations et les suggestions de code obsolètes en récupérant du contenu frais depuis des sources officielles, plutôt que de dépendre de données d'entraînement statiques.

- Une intégration simple via des invites comme "use context7" permet une utilisation fluide dans des outils tels que Cursor, Claude Code, Windsurf et VS Code.

- Les benchmarks et les retours des développeurs indiquent des améliorations significatives de la précision du code, en particulier pour les bibliothèques et frameworks en évolution rapide.

- Prend en charge des milliers de bibliothèques avec un classement intelligent, un filtrage par version et une utilisation minimale de tokens pour une injection de contexte efficace.

Qu'est-ce que Context7 ?

Context7 s'attaque à l'un des défis les plus persistants dans le codage assisté par IA : la dépendance des grands modèles de langage (LLM) à des données d'entraînement obsolètes ou incomplètes. Lorsque les développeurs demandent des exemples de code utilisant des bibliothèques modernes, les LLM génèrent fréquemment des API dépréciées, une syntaxe incorrecte ou des fonctions entièrement hallucinées.

L'analyse montre que ce problème devient particulièrement aigu avec des écosystèmes en évolution rapide comme React, Next.js, Supabase ou les SDKs cloud où les API changent fréquemment. Context7 résout ce problème en agissant comme un intermédiaire – un serveur MCP – qui récupère et injecte une documentation officielle et à jour dans la fenêtre de contexte du LLM au moment de la requête.

Développé par l'équipe Upstash et publié en open-source sous licence MIT, Context7 a rapidement gagné en adoption, comme en témoignent de solides indicateurs communautaires et des approbations de plateformes comme le Thoughtworks Technology Radar (statut "Trial" fin 2025).

Comment fonctionne Context7

Context7 fonctionne via le Model Context Protocol (MCP), un moyen standardisé pour les LLM d'accéder à des outils externes et à des sources de données.

Mécanisme principal

- Résolution de la bibliothèque — Lorsqu'une invite contient "use context7" ou qu'une invocation automatique est configurée, le serveur résout le nom de la bibliothèque mentionnée en un identifiant précis compatible avec Context7.

- Récupération de la documentation — En utilisant un classement et un filtrage propriétaires, il extrait la documentation Markdown formatée la plus pertinente et la plus claire – incluant des extraits de code – depuis les dépôts officiels.

- Filtrage spécifique à la version — Context7 détecte les versions du projet (par exemple, Next.js 14 vs 15) et n'injecte que le contenu correspondant, évitant ainsi les incohérences.

- Injection de contexte — Les sections pertinentes sont transmises en flux dans le contexte du LLM, en utilisant typiquement un minimum de tokens tout en maximisant la pertinence.

Principaux avantages techniques

- Absence d’hallucinations sur les API — Les exemples de code proviennent directement de la documentation source.

- Mises à jour dynamiques — La documentation se rafraîchit automatiquement lorsque les sources amont changent.

- Efficacité des tokens — Un classement intelligent garantit que seuls les extraits les plus pertinents sont inclus.

- Prise en charge multi-outils — Fonctionne avec tous les clients compatibles MCP, y compris Cursor, Claude Desktop, Windsurf et les intégrations personnalisées.

Avantages de Context7

Les benchmarks et retours de la communauté soulignent régulièrement plusieurs atouts :

- Précision accrue du code — Les développeurs rapportent une réduction de 70 à 90 % des suggestions non valides ou obsolètes pour les tâches spécifiques aux frameworks.

- Flux de travail plus rapide — Supprime le besoin de rechercher manuellement les docs, de copier-coller des extraits ou de recouper les versions.

- Idéal pour les cas limites — Gère les bibliothèques de niche, les fonctionnalités bêta et les changements cassants là où les données d’entraînement sont souvent dépassées.

- Débogage et refactorisation améliorés — Fournit les meilleures pratiques actuelles lors de l’analyse ou de la mise à jour de code hérité.

Les retours de la communauté suggèrent que Context7 excelle particulièrement dans les environnements professionnels et de production, où la fiabilité du code a un impact direct sur le succès des déploiements.

Comment installer et utiliser Context7

Démarrage rapide (mode MCP)

- Rendez-vous sur https://context7.com/ et créez une clé API.

- Ajoutez le fournisseur MCP à votre éditeur de code IA :

- Cursor : Paramètres → Fournisseurs MCP → Ajouter Context7

- Claude Code / Windsurf : Suivez des étapes de configuration MCP similaires

- Dans vos prompts, incluez use context7 :

Montre-moi comment implémenter une authentification email/mot de passe avec Supabase dans Next.js App Router. use context7

Le serveur résout, récupère et injecte automatiquement la documentation la plus récente.

Configuration avancée

- Spécifiez explicitement les IDs de bibliothèques pour plus de précision :

/supabase/auth@2.0 - Définissez des budgets de tokens pour équilibrer détail et vitesse

- Utilisez le mode CLI pour les environnements non-MCP

- Les utilisateurs professionnels peuvent héberger des instances privées pour les bibliothèques internes

Exemples courants d’intégration

- Cursor + Context7 : Automatique pour la plupart des prompts mentionnant des bibliothèques

- Claude Code : Combinez avec les compétences pour une gestion encore plus riche de la documentation

- VS Code Copilot : Via les extensions MCP

Pièges courants et astuces avancées

Pièges à éviter

- Oublier "use context7" — Sans ce déclencheur, le LLM utilise ses connaissances obsolètes.

- Noms de bibliothèques ambigus — "auth" seul peut mal être résolu ; préférez des noms spécifiques.

- Prompts trop larges — Des requêtes trop vagues peuvent renvoyer des docs moins pertinentes.

- Ignorer les versions — Ne pas préciser de version peut entraîner des exemples incohérents dans les monorepos.

Conseils avancés

- Enchaînez avec d’autres MCP (ex. : search + Context7) pour des flux de travail hybrides recherche + docs.

- Surveillez l’utilisation des tokens — Context7 est efficace, mais les bibliothèques complexes peuvent consommer plus de contexte.

- Pour les besoins local-first, explorez les alternatives communautaires inspirées de Context7.

- Consultez régulièrement https://context7.com/rankings pour les bibliothèques les plus populaires et les mises à jour de couverture.

Conclusion

Context7 représente une avancée significative dans le développement assisté par IA en comblant l'écart crucial entre les connaissances statiques des LLM et la documentation dynamique du monde réel. Alors que les bibliothèques évoluent plus vite que les cycles de réentraînement des modèles, des outils comme Context7 deviennent une infrastructure essentielle pour une génération de code fiable.

Étape d'action : Installez Context7 dès aujourd'hui dans votre éditeur de code IA préféré et testez-le sur la bibliothèque la plus frustrante de votre projet actuel. L'amélioration en termes de précision et de vitesse est souvent immédiatement perceptible.

Explorez le site officiel sur https://context7.com/, consultez le dépôt GitHub sur https://github.com/upstash/context7, ou rejoignez les discussions entre développeurs pour voir comment d'autres maximisent son potentiel.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Guide des prompts OpenAI GPT-5.5 : Tutoriel étape par étape

Google Investit Jusqu'à 40 Milliards de Dollars dans Anthropic avec un Soutien de 5 GW de Puissance Informatique : La Course à l'IA Entre dans une Nouvelle Ère

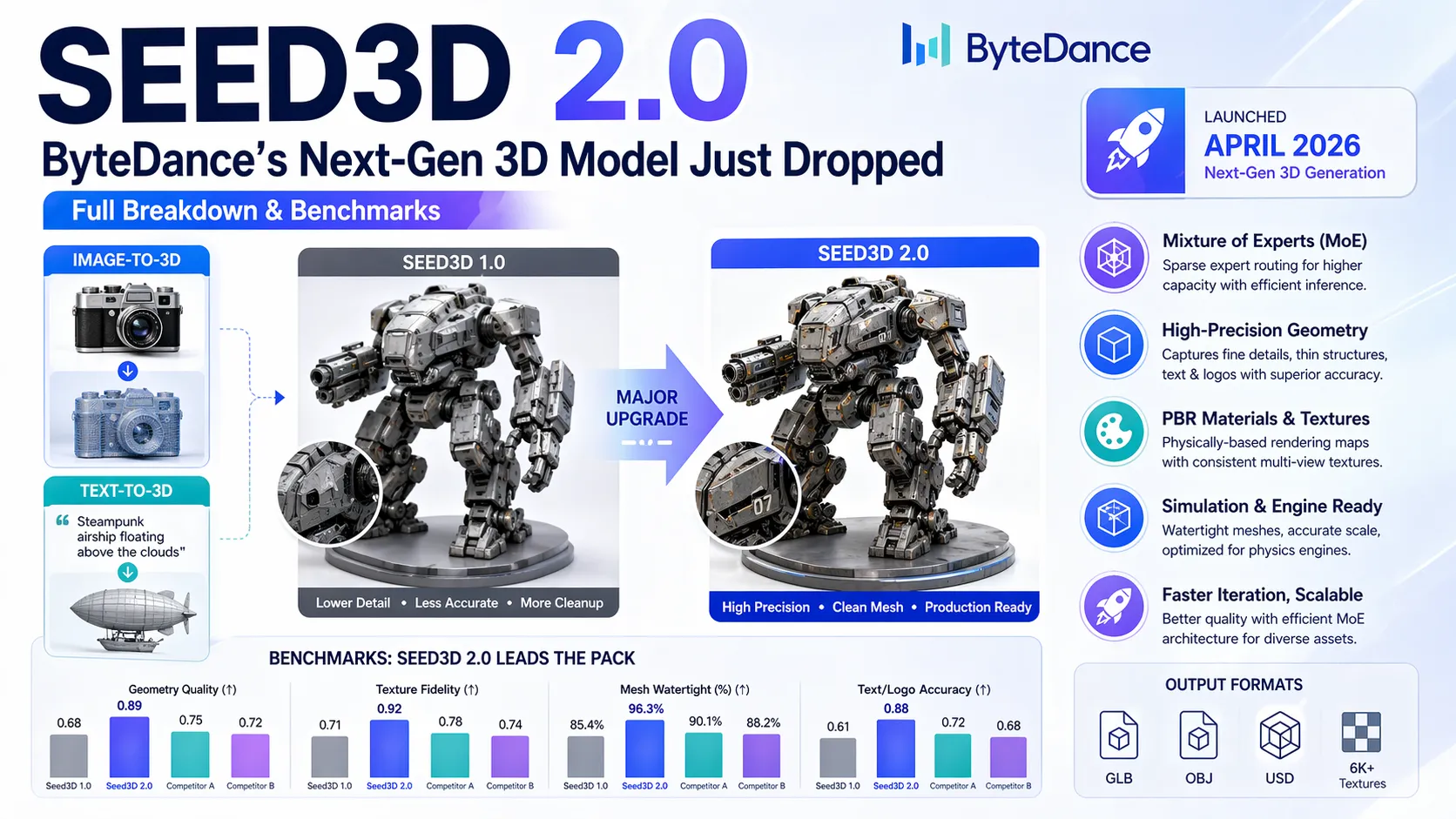

Seed3D 2.0 : Le modèle de nouvelle génération 3D de ByteDance est arrivé – Analyse complète et benchmarks

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.