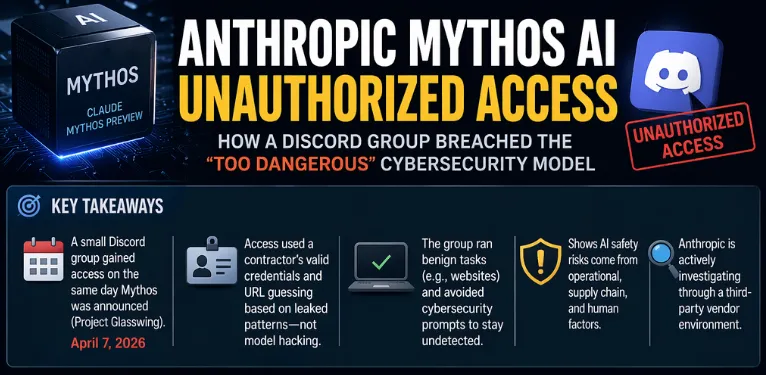

Anthropic神话AI未经授权访问事件:Discord群组如何攻破'过于危险'的网络安全模型

核心要点

- 一个规模较小的 Discord 群组在 Anthropic 的 Mythos(Claude Mythos 预览版)宣布在“Project Glasswing”下进行有限测试的当天,就获得了访问其受限版本的权限。

- 访问权限依赖于一家第三方承包商的合法凭证,并结合了基于 Mercor 数据泄露中泄露的模式的端点 URL 猜测,而非复杂的模型攻击。

- 该群组将模型用于良性任务(例如构建简单的网站),并刻意避免使用网络安全类提示,以规避检测。

- 该事件凸显了 AI 安全风险 往往源于操作、供应链和人为因素,而不仅仅是模型的核心能力。

- Anthropic 正在通过其一家第三方供应商环境,积极调查此次未授权访问事件。

什么是 Anthropic 的 Mythos AI 模型?

Anthropic 开发的 Mythos 是一款专精于网络安全任务的高度先进 AI 模型。据该公司称,该模型在识别和利用跨主流操作系统和网络浏览器的零日漏洞方面,展现出前所未有的能力。

据报道,基准测试和内部测试显示,Mythos 能够生成数以千计的潜在漏洞利用方案,而以往的模型则一无所获。这促使 Anthropic 将其归类为风险过高、不宜公开释放,并将初始访问权限限制在选定的合作伙伴范围内,包括苹果、亚马逊、思科以及参与 Project Glasswing 倡议的其他组织。

该模型被定位为一款防御工具,旨在帮助大型企业和政府机构加强其系统,以应对新兴的 AI 驱动威胁。然而,其潜在的进攻性能力引发了人们对若其落入恶意分子手中可能带来的扩散风险的担忧。

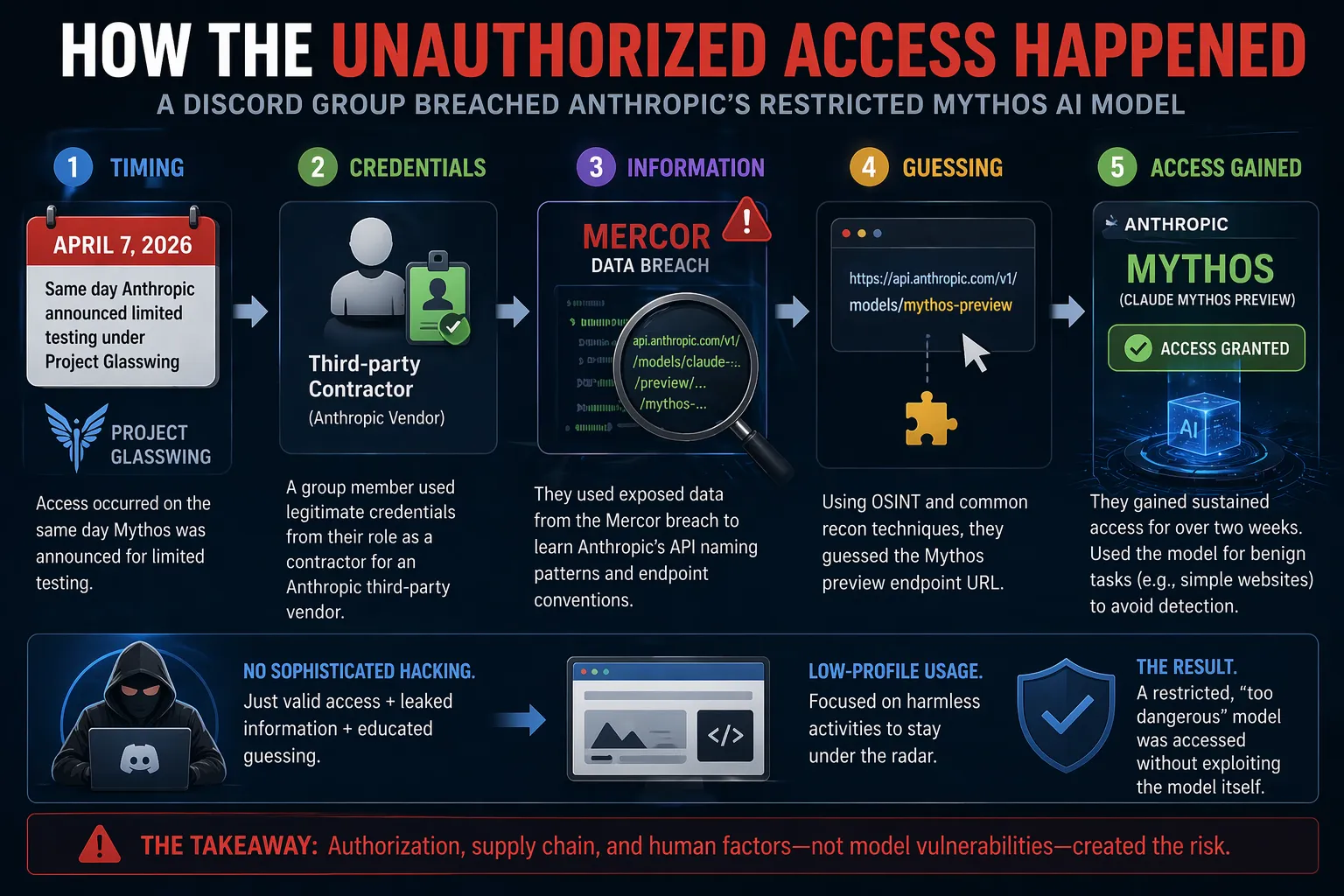

此次未经授权访问是如何发生的

事件报告分析表明,此次入侵手法异常简单,并非针对模型本身的高科技利用:

- 时机选择:访问发生在2026年4月7日——正是Anthropic宣布限量测试开放的同一天。

- 实施方法:一个专注于追踪未发布AI模型的私密Discord频道成员利用了以下条件:

- 一名在Anthropic第三方供应商(参与模型评估工作)担任合同工的群组成员提供的合法凭证。

- 通过近期AI初创公司Mercor大规模数据泄露事件获取的Anthropic API端点命名惯例信息。

- 运用常见的互联网侦查技术对Mythos预览版端点URL进行的合理推测。

多重条件叠加使得该群体获得了超过两周的持续访问权限。他们向记者提供了截图和实时演示以证实其说法。

值得注意的是,该群体避开了高风险的网络安全类提示词测试,转而进行无害活动,例如生成简单网站。这种低调的策略很可能帮助他们更长时间未被察觉。

为何此事件至关重要:超越模型权重的视角

社区反馈与专家讨论均指出,这一事件凸显了AI安全领域的关键现实:最薄弱的环节往往存在于流程和人为因素中,而非技术性的模型防护措施本身。

尽管Mythos的基准测试聚焦于其网络能力,但实际暴露的风险根源却在于:

- 供应链漏洞:拥有合法访问权限的第三方承包商和供应商。

- 可预测的基础设施模式:模型端点可复用的命名惯例。

- 数据泄露的连锁效应:来自无关事件(如Mercor泄露)的信息为侦查提供了便利。

- 信任假设偏差:过度依赖受控环境,却未对供应商访问实施充分的隔离或监控机制。

与过往AI安全事件的对比揭示了一个模式——许多"高危"模型面临的威胁并非来自对模型权重的对抗性攻击,而是源于运营环节的疏漏。本案犹如将先进武器锁在房间内,却让建筑侧门保持敞开。

其他潜在风险场景包括:

- 承包商或合作伙伴之间的凭证共享。

- 公开的技术痕迹(GitHub、文档模式)助长URL预测。

- 当使用行为持续低于特定风险阈值时出现的监控盲区。

受限AI部署中的常见陷阱

分析类似高风险AI发布案例,可发现反复出现的问题:

- 过度强调模型对齐,而对运行时访问控制和审计投入不足。

- 供应商与合作伙伴准入缺乏细粒度、有时限的权限管理或异常检测机制。

- 命名与端点可预测性为熟悉内情的内部人员简化了侦察步骤。

- 未能区隔环境,导致内部测试、供应商评估和受限合作伙伴访问混同。

网络安全领域讨论的先进缓解策略包括:

- 采用严格认证的动态临时端点。

- 行为监控机制,对来源异常的操作模式(即使行为良性)进行标记。

- 定期轮换命名规则与凭证权限范围。

- 聚焦承包商访问路径的供应链安全审计。

对AI安全与网络安全的启示

Mythos事件引发了对强大双用途AI技术治理的更广泛思考。尽管该团队未将模型武器化,但其轻易的访问途径揭示了受限能力如何通过非正式网络快速扩散。

正在测试Mythos的金融机构、政府与企业如今必须重新评估,不仅要考量模型的防御价值,还需审视类似暴露途径的风险。监管机构已开始密切关注事态发展,金融稳定理事会等论坛的讨论已凸显系统性担忧。

与其他AI公司的对比显示,Anthropic并非个例——许多组织都在云部署环境中艰难平衡创新速度与稳健的防护措施。

结论

对Anthropic公司Mythos模型的未授权访问事件及时警示我们:真正的AI安全远不止于训练数据和对齐技术。操作安全、供应链完整性和人为因素同样起着决定性作用。

随着网络安全等敏感领域的AI能力持续发展,各机构必须在推进模型开发的同时,优先建立全面的访问治理体系。AI、网络安全与政策领域的相关方应密切关注Anthropic的调查结果,并考虑为受限部署场景强化最佳实践。

对于从事前沿AI系统工作的专业人员而言,审查内部供应商管理、端点安全及监控协议是当前降低类似暴露风险的推荐举措。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.