Andrej Karpathy如何利用LLMs在Obsidian中构建动态个人知识库

关键要点

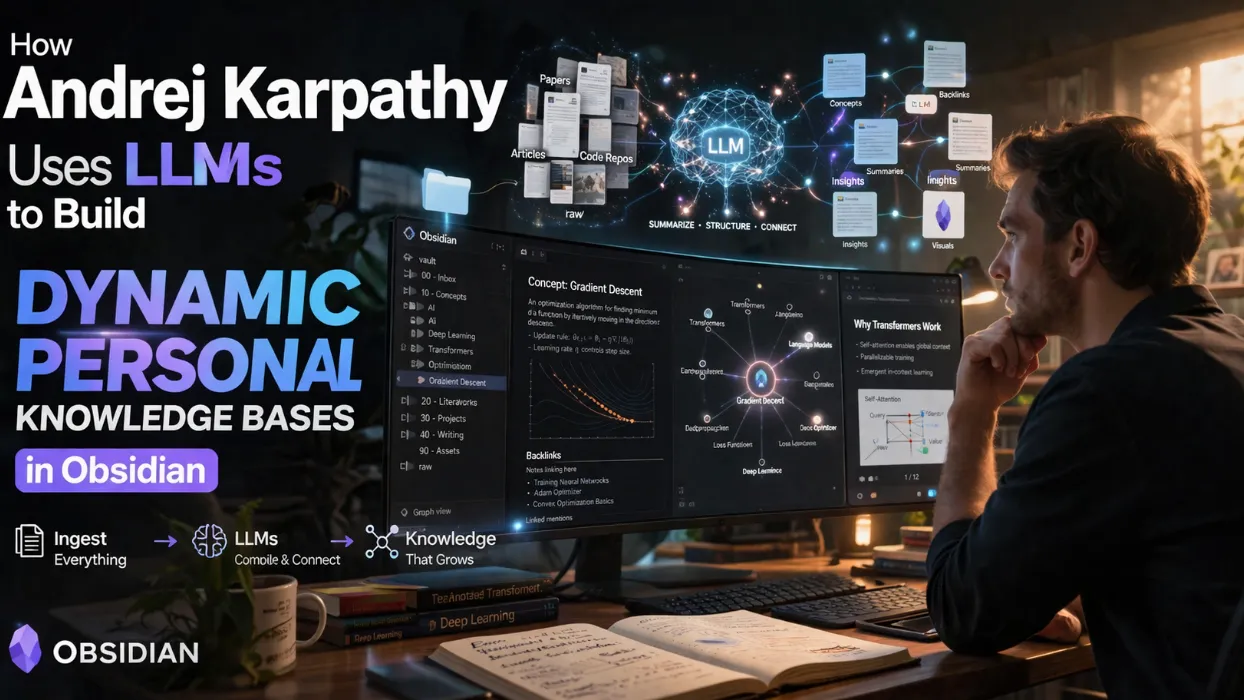

Andrej Karpathy 的系统将原始文档(论文、文章、代码库、图像)摄入到 raw/ 目录中,然后利用 LLM 增量式地将其编译成一个结构化的 Markdown 维基,包含摘要、反向链接、概念文章和互连。

Obsidian 作为轻量级前端,用于查看原始数据、已编译的维基以及生成的输出(如 Marp 幻灯片或 Matplotlib 图表),LLM 处理几乎所有的写作和维护工作。

在规模扩大后(约 100 篇文章,约 40 万字),复杂的问答操作只需依赖最少的 RAG 技术;LLM 自动维护索引和摘要,以实现高效的上下文检索。

通过 LLM 健康状况检查进行代码审查,识别不一致之处,填补缺失数据,建议建立连接,并提出新文章,确保数据完整性。

输出不仅限于文本,还包括渲染的 Markdown、幻灯片、可视化图表或动态 HTML,这些通常会被归档回维基中,随时间积累知识。

社区采纳情况突显了扩展功能,如为控制污染而进行的智能体分离、用于微调的合成数据,以及针对每次查询生成的临时维基。

从代码到知识处理的转变

分析表明,令牌分配发生了根本性变化:近期的前沿 LLM 在知识综合方面表现优于纯粹的代码生成。Karpathy 报告称,他当前令牌吞吐量中很大一部分用于处理以 Markdown 文件和图像形式存储的结构化知识,而非生成临时的终端输出。

这一工作流程将被动的研究消费转变为主动、自我改进的知识库。原始资料积累在专用目录中。随后,LLM 对其进行“编译”——生成摘要、将内容分类为概念、撰写链接文章,并建立反向链接。

类似个人系统的基准测试表明,一旦维基达到临界规模,查询复杂性会急剧增加,而检索开销并不会成比例上升。

数据摄入和编译流程

该流程始于有针对性收集:

源处理:研究论文、文章、GitHub 仓库、数据集和图像被放入 raw/。网络内容通过 Obsidian Web Clipper 转换为 Markdown,图像则本地下载以便 LLM 直接引用。

增量编译:LLM 初始时逐个处理新文档,随后通过模式匹配以提高效率。类似“将此新文档归档到我们的维基”的指令会触发分类、摘要生成和链接建立。

结构创建:生成的维基具有以下特性:

各文档摘要

概念级文章

双向反向链接

基于目录的组织

社区反馈表明,对于较大的摄入量,批处理或多阶段流程可改进目录决策,尽管 Karpathy 在早期阶段仍保持人工参与以确保质量。

Obsidian 作为理想的前端界面

Obsidian 扮演着该系统中简约型“集成开发环境”的角色:

- 可同时查看原始素材、已编译的维基页面及可视化数据

- 利用 Marp 等插件,能够将 LLM 生成的 Markdown 直接渲染为演示幻灯片

- 图谱视图与反向链接导航功能,可揭示内容间自然形成的关联性

专家指出,Obsidian 采用本地优先的 Markdown 基础架构,既最大限度地减少了平台锁定风险,又支持自定义工具的开发。虽存在如 VS Code 搭配 Markdown 扩展等替代方案,但 Obsidian 的生态系统在加速视觉化和交互式探索方面表现更为出色。

社区实践中已涌现出分离策略:维护一个高信息密度的个人知识库,同时设立一个面向智能体的“杂乱”知识库,以此防止生成内容对核心资料造成污染。

高级问答与输出生成

一旦系统规模扩大,该维基便能支持复杂的查询操作:

- LLM 可遍历整个语料库,利用其自主维护的索引与摘要信息

- 当内容量达到约 40 万字时,上下文窗口能够高效处理相关主题群,无需依赖沉重的向量检索增强生成技术

- 输出形式可根据需求灵活调整:Markdown 报告、Marp 幻灯片、Matplotlib 图表,甚至生成动态 HTML/JS 以实现交互式筛选与可视化

生成的成果常被反哺回维基中,形成一个复合增强循环:探索过程不断优化未来的查询效能。Lex Fridman 及其他实践者反馈,他们在播客研究或通过临时微型维基进行移动端语音交互时,也采用了类似配置。

LLM 驱动的代码检查与系统维护

系统的突出特色在于自动化的“健康检查”机制:

- 检测相隔数周摄入的不同来源资料中是否存在矛盾论述

- 利用网络搜索工具填补信息空白

- 识别新颖的关联性与潜在的待撰写文章主题

- 提出后续追问建议以深化覆盖广度

这使得维基从静态存储库转变为动态的研究伙伴。随着系统增长,数据陈旧风险亦随之上升;而通过版本化审计与增量更新,能比一次性批量导入更有效地缓解信息偏移问题。

新兴工具与未来探索方向

用户正在从以下方向扩展系统核心功能:

- 开发自定义命令行界面或简易搜索引擎,并将其作为工具赋予 LLM 使用

- 结合合成数据生成与微调技术,将维基知识嵌入模型权重之中

- 瞬时维基生成:单个查询即可在最终报告前,催生出完整、经过检查、迭代优化的知识库——远超越简单的解码过程

社区分享的架构图清晰展示了从数据摄入到编译、查询、增强的全流程阶段。为非开发人员搭建此类系统的产品化方案,显然蕴含着巨大机遇,毕竟每个组织都沉淀着大量亟待梳理的“原始/”非结构化数据。

与传统个人知识管理体系相比,该系统优势显著:在活跃研究领域,LLM 自动化将人工整理工作量减少了 80-90%,同时反向链接与图谱功能能够揭示人类可能忽略的深层洞见。

挑战与最佳实践

.

- 规模管理:摘要内容可能过时;应优先处理最新的代码差异与审核内容。 .

- 污染控制:在验证通过前,隔离由智能体生成的内容。

- 渐进式采纳:从小规模开始,待模式自然浮现后再推行全面自动化。

- 工具简化:使用扁平化的 Markdown 目录配合

AGENTS.md架构即可;过度设计会延迟价值实现。

可执行建议:从一个研究主题入手。收集 10–20 个资料来源,借助大语言模型(LLM)初步构建知识库,随后通过迭代式查询与规范性检查持续优化。评估价值时,可对比传统搜索与笔记方式,从查询深度与时间节省两方面进行衡量。

结论

安德烈·卡帕西(Andrej Karpathy)提出的基于大语言模型的知识库工作流程,标志着研究者与实践者信息交互方式的一次务实进化。通过将内容汇编、维护与综合任务交由高效模型处理,同时保留 Obsidian 作为直观交互界面,用户得以在更低阻力下获得更深度的理解。

这一方法具有持续积累效应:每一次查询都加固知识基础,每一轮规范性检查都提升内容完整性。随着前沿模型的进步,未来有望出现更全面的工具,能够直接从自然语言问题自动构建完整的临时知识库。

不妨今天就实施一个最小可行版本——导入你下一批研究资料,让大语言模型为你搭建基础框架。从被动消费知识转向主动培育知识,或将重新定义智能体时代下的个人与组织智力形态。

从小处着手,持续迭代,见证你的个人知识库逐步成长为真正的智力增效器。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.