Como Andrej Karpathy Usa LLMs para Construir Bases de Conhecimento Pessoal Dinâmicas no Obsidian

Principais Pontos

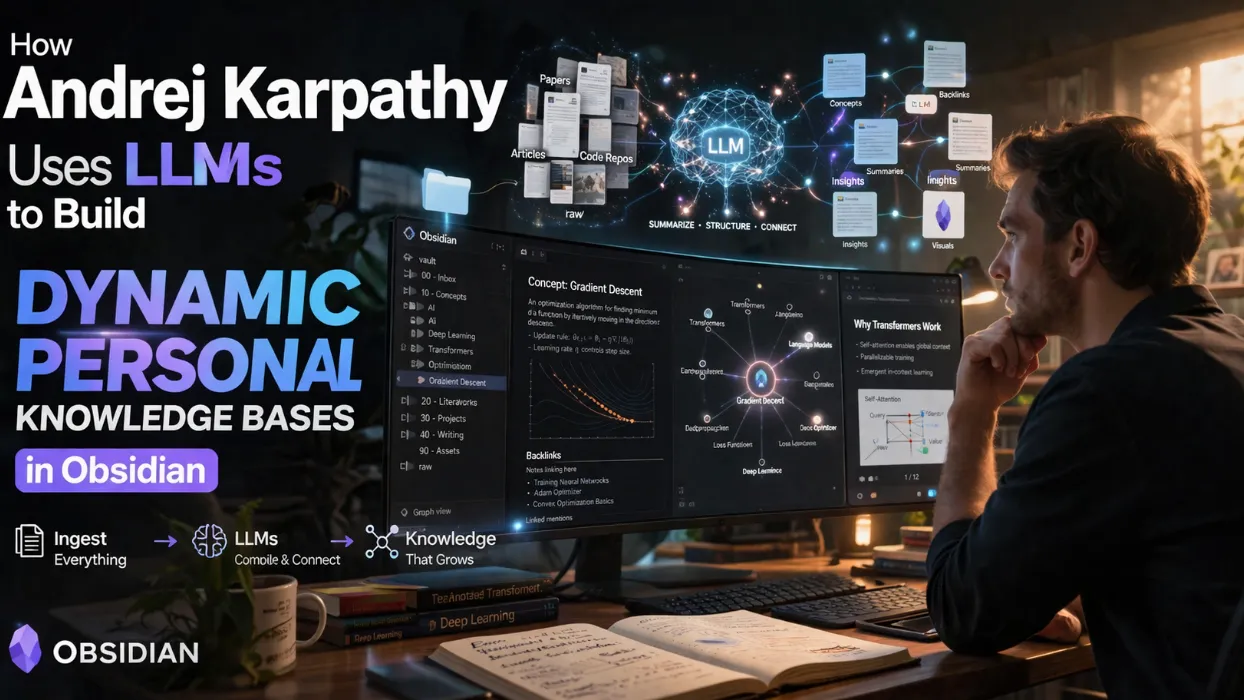

- O sistema de Andrej Karpathy ingere documentos brutos (artigos, papers, repositórios, imagens) em um diretório

raw/, e depois usa LLMs para compilá-los incrementalmente em um wiki estruturado em Markdown com resumos, backlinks, artigos sobre conceitos e interconexões. - O Obsidian serve como a interface leve para visualizar dados brutos, o wiki compilado e saídas geradas como slides Marp ou gráficos Matplotlib, com o LLM lidando com quase toda a escrita e manutenção.

- Em escala (~100 artigos, ~400K palavras), consultas complexas de perguntas e respostas ocorrem com mínima dependência de RAG; o LLM mantém automaticamente índices e resumos para recuperação eficiente de contexto.

- A verificação de saúde (linting) via LLM identifica inconsistências, imputa dados ausentes, sugere conexões e propõe novos artigos, garantindo a integridade dos dados.

- As saídas vão além do texto para incluir Markdown renderizado, slides, visualizações ou HTML dinâmico, frequentemente arquivados de volta no wiki para aumentar o conhecimento ao longo do tempo.

- A adoção pela comunidade destaca extensões como separação de agentes para controle de contaminação, dados sintéticos para fine-tuning e wikis efêmeros gerados por consulta.

A Mudança de Código para Manipulação de Conhecimento

A análise mostra uma mudança fundamental na alocação de tokens: LLMs recentes de vanguarda se destacam mais na síntese de conhecimento do que na geração pura de código. Karpathy relata que uma grande fração de sua produção de tokens agora manipula conhecimento estruturado armazenado como arquivos Markdown e imagens, em vez de saídas efêmeras de terminal.

Este fluxo de trabalho transforma o consumo passivo de pesquisa em uma base de conhecimento ativa e autoaperfeiçoável. Fontes brutas se acumulam em um diretório dedicado. Um LLM então as "compila" incrementalmente—gerando resumos, categorizando o conteúdo em conceitos, redigindo artigos vinculados e estabelecendo backlinks.

Referências de sistemas pessoais similares indicam que, uma vez que um wiki atinge massa crítica, a complexidade das consultas escala dramaticamente sem aumentos proporcionais na sobrecarga de recuperação.

Processo de Ingestão e Compilação de Dados

O pipeline começa com coleta direcionada:

- Manuseio de Fontes: Artigos de pesquisa, papers, repositórios do GitHub, conjuntos de dados e imagens vão para

raw/. Conteúdo web é convertido para Markdown via Obsidian Web Clipper, com imagens baixadas localmente para referência direta do LLM.

# Exemplo de estrutura simplificada

knowledge_base/

├── raw/

│ ├── papers/

│ ├── articles/

│ ├── repos/

│ └── images/

└── wiki/

├── concepts/

├── summaries/

└── index.md

-Karly conforme o sistema evolui

- Compilação Incremental: LLMs processam novos documentos um a um inicialmente, depois usam correspondência de padrões para eficiência. Instruções como "arquive este novo documento em nosso wiki" acionam categorização, resumo e vinculação.

- Criação de Estrutura: O wiki resultante apresenta:

- Resumos por documento

- Artigos no nível de conceito

- Backlinks bidirecionais

- Organização baseada em diretório

O feedback da comunidade sugere que processamento em lote ou pipelines multietapa melhoram decisões de diretório para ingestões maiores, embora Karpathy mantenha as fases iniciais com intervenção humana para garantir qualidade.

Obsidian como o Frontend Ideal

O Obsidian funciona como um "IDE" minimalista para o sistema:

- Visualizações simultâneas dos fontes brutos, do wiki compilado e das visualizações.

- Plugins como o Marp permitem a renderização de slides diretamente a partir de Markdown gerado por LLMs.

- As visualizações de grafo e a navegação por backlinks revelam conexões emergentes.

Especialistas destacam que a base local-first em Markdown do Obsidian minimiza o vendor lock-in enquanto suporta ferramentas personalizadas. Alternativas como o VS Code com extensões para Markdown existem, mas o ecossistema do Obsidian acelera a exploração visual e interativa.

Estratégias de separação surgem em implementações da comunidade: manter um cofre pessoal de high-signal (alta qualidade) juntamente com um cofre "bagunçado" voltado para os agentes, para evitar a contaminação por conteúdo gerado.

Q&A Avançado e Geração de Saída

Uma vez dimensionado, o wiki suporta consultas sofisticadas:

- Os LLMs navegam por todo o corpus, aproveitando índices e resumos mantidos pelo próprio sistema.

- Com aproximadamente 400K palavras, as janelas de contexto lidam com agrupamentos relacionados de forma eficiente, sem a necessidade de RAG vetorial pesado.

- As saídas se adaptam às necessidades: relatórios em Markdown, apresentações de slides com Marp, gráficos com Matplotlib ou até mesmo HTML/JS dinâmico para filtragem interativa e visualizações.

Os artefatos gerados frequentemente são reinseridos no wiki, criando um ciclo cumulativo onde as explorações aprimoram consultas futuras. Lex Fridman e outros relatam configurações semelhantes para pesquisas de podcast ou interações por voz em movimento por meio de mini-wikis temporários.

Linting e Manutenção Dirigidos por LLM

Um recurso destacado são as "verificações de saúde" automatizadas:

- Detectar afirmações inconsistentes entre fontes ingeridas em semanas diferentes.

- Preencher lacunas usando ferramentas de busca na web.

- Identificar conexões novas e artigos candidatos.

- Sugerir perguntas de acompanhamento para aprofundar a cobertura.

Isso transforma o wiki de um repositório estático em um parceiro de pesquisa vivo. Os riscos de dados obsoletos aumentam com o crescimento; auditorias versionadas e atualizações incrementais mitigam o drift (desvio) de forma mais eficaz do que ingestões únicas.

Ferramentas Emergentes e Explorações Futuras

Os usuários estendem o núcleo com:

- CLIs personalizados ou mecanismos de busca simplificados entregues aos LLMs como ferramentas.

- Geração de dados sintéticos combinada com fine-tuning para incorporar o conhecimento do wiki nos pesos do modelo.

- Geração de wikis efêmeros: uma única consulta gera uma base de conhecimento completa, verificada e iterada antes do relatório final—indo muito além da simples decodificação.

Diagramas arquiteturais compartilhados na comunidade visualizam os estágios, desde a ingestão até a compilação, consulta e aprimoramento. Produtos que fazem a ponte disso para não desenvolvedores representam uma oportunidade clara, já que toda organização mantém dados não estruturados ("raw/") aguardando compilação.

Comparações com os PKMs tradicionais (Personal Knowledge Management) destacam as vantagens: a automação por LLM reduz a curadoria manual em 80-90% em domínios de pesquisa ativos, enquanto os backlinks e grafos trazem à tona insights que os humanos poderiam perder.

Desafios e Melhores Práticas

- Gestão de Escala: Os resumos podem ficar desatualizados; priorize diffs recentes e auditorias.

- Controle de Contaminação: Isole conteúdo gerado por agentes até que seja verificado.

- Adoção Incremental: Comece pequeno, deixe os padrões emergirem antes da autonomia total.

- Simplicidade das Ferramentas: Diretórios Markdown planos com esquemas

AGENTS.mdsão suficientes; engenharia excessiva atrasa a entrega de valor.

Insight acionável: Comece com um tópico de pesquisa. Colete 10 a 20 fontes, peça a um LLM para compilar a wiki inicial e, em seguida, itere consultas e linting. Meça o valor pela profundidade das consultas e pelo tempo economizado em comparação com a busca/tomada de notas tradicional.

Conclusão

O fluxo de trabalho de base de conhecimento alimentado por LLM de Andrej Karpathy marca uma evolução prática na forma como pesquisadores e profissionais interagem com a informação. Ao delegar compilação, manutenção e síntese a modelos capazes, mantendo o Obsidian para interação intuitiva, os usuários alcançam um entendimento mais profundo com menos fricção.

Essa abordagem se multiplica ao longo do tempo: cada consulta fortalece a base, cada passagem de linting eleva a integridade. À medida que os modelos de fronteira avançam, espere ferramentas mais amplas que automatizem wikis efêmeras inteiras a partir de perguntas naturais.

Implemente uma versão mínima hoje — ingira seu próximo lote de pesquisa e deixe um LLM construir a fundação. A mudança de consumir conhecimento para cultivá-lo ativamente pode redefinir a inteligência pessoal e organizacional na era agentiva.

Comece pequeno, itere incansavelmente e observe sua wiki pessoal evoluir para um verdadeiro multiplicador intelectual.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Acesso Não Autorizado à IA Mythos da Anthropic: Como um Grupo do Discord Violou o Modelo de Cibersegurança 'Muito Perigoso'

Guia de Prompt do OpenAI GPT-5.5: Tutorial Passo a Passo

O Que É o OC Maker? A Ferramenta de IA que Está Revolucionando a Criação de Personagens Originais em 2026

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.