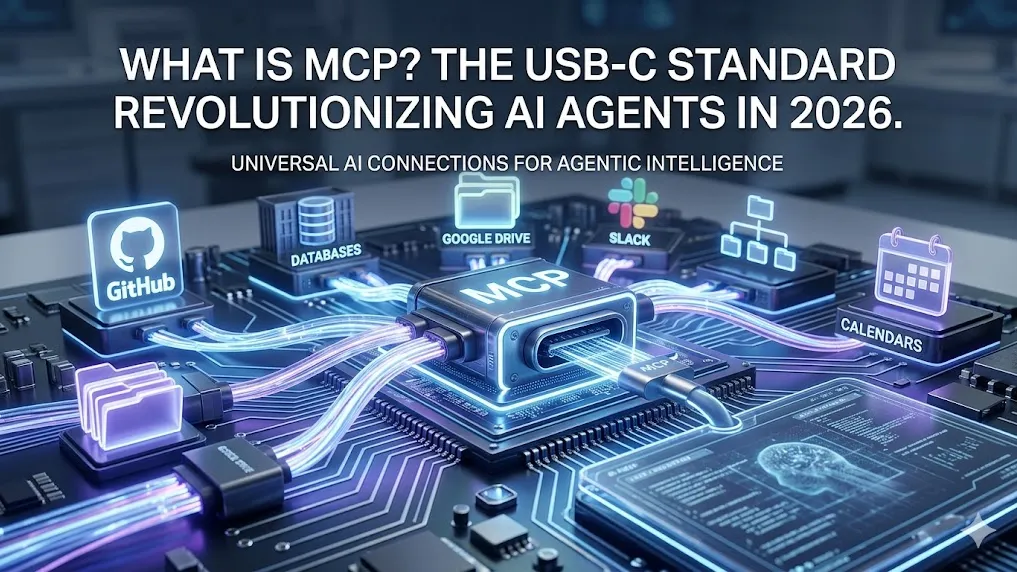

什么是MCP(模型上下文协议)?2026年革新AI代理的USB-C标准

核心要点

- MCP 是由 Anthropic 于 2024 年 11 月推出的开源模型上下文协议,它作为人工智能应用连接外部数据源、工具和工作流程的通用“USB-C 端口”。

- 该协议采用基于 JSON-RPC 2.0 的标准化客户端-服务器架构,同时支持本地(stdio)和远程(HTTP/SSE)传输方式,实现跨生态系统的无缝集成。

- 早期采用者的基准测试显示,集成开发时间最多减少了 80%,使得 AI 代理能够从 GitHub、数据库、日历等来源获取实时上下文,无需为每个平台编写定制代码。

- MCP 与 A2A(代理对代理)等协议互补,专注于垂直工具集成,驱动真正自主的 AI 应用,同时通过 OAuth 2.1、PKCE 和按客户端授权流程确保严格的安全性。

- 到 2026 年,MCP 已在 Claude、ChatGPT、VS Code、Cursor 及数十种企业工具中获得支持,并提供了用于 Google Drive、Slack、Postgres 等的预制服务器——使得即插即用的 AI 扩展成为现实。

什么是模型上下文协议(MCP)?

模型上下文协议(MCP)是一种开放标准,它规范了 AI 应用连接外部系统的方式。由 Anthropic 推出并迅速在行业内广泛采用,MCP 允许大型语言模型和 AI 代理安全地读取数据、执行工具并实时遵循专门的工作流程。

可以将 MCP 视为 AI 的 USB-C 端口。正如 USB-C 为设备提供了充电、数据传输和视频输出的通用连接器一样,MCP 为 AI 客户端提供了一个统一的协议,用于发现并与任何兼容的服务器进行交互——从而消除了对定制集成的需求。

MCP 解决的问题

传统的 AI 集成存在碎片化问题。每个数据源或工具都需要定制代码、身份验证逻辑和维护工作。这导致了数据孤岛,增加了开发成本,并将 AI 代理限制在静态的知识截止日期内。

对 MCP 实施前的分析表明,企业需要花费数月时间为 Slack、GitHub 或内部数据库等构建单独的连接器。MCP 用一个标准化接口取代了这种方式,使 AI 系统能够跨工具保持上下文,并提供更准确、更具可操作性的响应。

深入解析:MCP 架构及其工作原理

MCP 遵循清晰的三层架构:

- MCP 主机:AI 应用程序(例如 Claude Desktop、带有 Copilot 的 VS Code 或自定义智能体框架)。

- MCP 客户端:主机内部的组件,负责发现、连接并调用服务器。

- MCP 服务器:提供工具、资源或提示的提供方(本地 stdio 进程或远程 HTTP 端点)。

通信通过 JSON-RPC 2.0 协议在有状态的会话中进行。服务器在握手期间通告其能力,包括支持的原语:

- 资源:对文件、数据库或文档的读/写访问权限。

- 工具:具有副作用的可执行函数(例如发送电子邮件、创建 Git 分支)。

- 提示:用于专门任务的可复用工作流模板。

传输选项包括用于桌面安全性的本地 stdio,以及用于远程生产环境的带有服务器发送事件(SSE)的 HTTP。会话支持流式响应以处理长时间运行的操作。

以下是一个简化的能力发现请求示例:

{

"jsonrpc": "2.0",

"method": "initialize",

"params": {

"protocolVersion": "2024-11-25",

"clientInfo": {"name": "Claude Desktop", "version": "1.0"}

},

"id": 1

}

服务器将响应其支持的工具、资源和授权要求。

实际用例与成功案例

社区反馈和企业部署突显了 MCP 的多功能性:

- 个性化助手:智能体从 Google Calendar 和 Notion 中提取实时数据,以自动安排会议或总结笔记。

- 开发者工作流:像 Cursor 和 VS Code 这样的工具使用连接到 Git 仓库和 Figma 设计的 MCP 服务器,在一个会话中生成完整的 Web 应用程序。

- 企业分析:聊天机器人安全地查询多个内部数据库,使非技术用户能够通过自然语言运行复杂的 SQL 分析。

- 创意自动化:控制 Blender 的 MCP 服务器根据文本提示生成 3D 模型并触发 3D 打印机。

包括 Block 和 Apollo 在内的早期采用者报告称,智能体部署周期显著加快。

MCP 与传统工具调用、A2A 及其他协议的对比

MCP 并非要取代所有 AI 集成模式——它在一个关键领域表现出色:标准化的上下文和工具访问。

- 与传统函数调用对比:自定义工具模式必须为每个模型和平台重新定义。MCP 服务器一次构建,随处可用。

- 与 A2A(智能体间协议)对比:A2A 处理智能体之间的横向通信以进行任务委派。MCP 专注于与外部系统的纵向连接。许多生产环境将两者结合以实现完整的智能体工作流。

- 与自定义 API 对比:MCP 增加了发现、能力协商、流式传输和统一授权——这些是临时 REST 端点所缺乏的功能。

该协议规范明确地将 MCP 定位为智能体 AI 所缺失的通用适配层。

MCP 带来的益处

- 开发者:一次构建,随处集成——显著降低维护成本。

- AI 平台:即时获取不断扩展的服务生态系统,无需重新开发连接器。

- 最终用户:从其 AI 工具中获得更相关、更具情境感知的响应和自主操作。

2026 年的采用数据显示,启用 MCP 的智能体通过提供实时数据,在复杂场景中将幻觉率降低了 40% 以上,并提高了任务完成准确率。

入门指南:构建与使用 MCP

对于最终用户:通过 Claude Desktop 或 Cursor 直接安装预构建的服务端。几分钟内即可连接 Git 或文件系统等本地工具。

对于开发者:官方 GitHub 仓库提供多种语言的 SDK。一个基本的 Python MCP 服务端只需几十行代码即可搭建,以暴露自定义功能。

高级实现支持远程托管,并为生产环境提供完整的 OAuth 2.1 流程。

安全考量与最佳实践

安全性已内置于 MCP 规范中。主要要求包括:

- 所有 HTTP 传输均采用带 PKCE 的 OAuth 2.1。

- 每客户端的许可流程,以防止“混淆代理人攻击”。

- 最小权限范围与短期令牌。

- 支持代理服务器,可委托第三方 API 并维护审计日志。

2026 年的安全审计强调,应为远程连接启用双向 TLS,并对服务端公告进行严格验证,以避免供应链风险。

常见陷阱与高级技巧

需避免的陷阱:

- 权限设置过宽,导致意外数据暴露。

- 在桌面客户端中忽略许可界面,造成用户体验不佳。

- 在非受信环境之外使用未加密的标准输入输出传输。

高级技巧:

- 针对代码生成或数据分析等长时间运行的操作,实施流式处理。

- 在单个会话中编排多个服务端以实现复杂工作流(例如,GitHub + 数据库 + 通知)。

- 利用能力协商机制,在老旧客户端上优雅降级功能。

规范中定义了会话恢复和回退机制,以处理诸如高延迟远程服务端或离线优先的本地工具等边缘情况。

MCP 在 AI 生态系统中的未来

截至 2026 年,MCP 在社区贡献下持续演进。即将到来的增强功能包括更丰富的多模态资源支持,以及与新兴智能体编排框架的更紧密集成。各大主流平台已承诺遵循该标准,这使 MCP 成为新一代具备情境感知与行动能力的 AI 的基础层。

总结

MCP 将人工智能从孤立的聊天机器人转变为相互连接、具备能力的智能体,它们能理解你的数据并代表你执行操作。无论你是个人用户、开发者还是企业架构师,采用 MCP 都将解锁前所未有的智能水平和生产力。

即刻前往官方文档网站开始探索,试用预构建的服务器,亲身感受其带来的变革。真正实现集成式人工智能的时代已经到来。

Continue Reading

More articles connected to the same themes, protocols, and tools.

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.