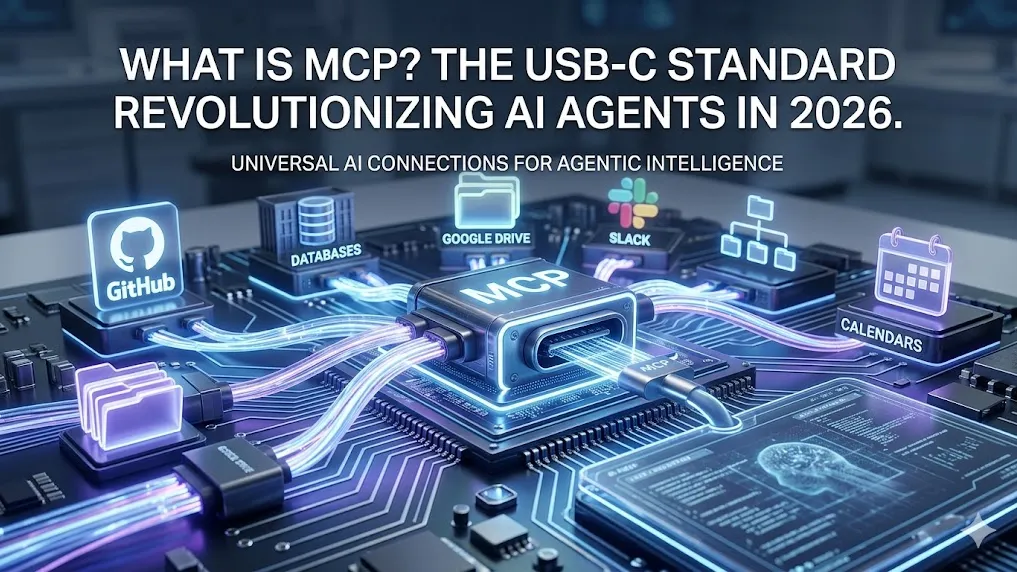

Qu'est-ce que le MCP (Model Context Protocol) ? Le standard USB-C révolutionnant les agents IA en 2026

Points clés

- MCP est le Model Context Protocol (protocole ouvert de contexte de modèle), lancé par Anthropic en novembre 2024, agissant comme un "port USB-C" universel permettant aux applications d'IA de se connecter à des sources de données externes, des outils et des flux de travail.

- Le protocole utilise une architecture client-serveur standardisée basée sur JSON-RPC 2.0, prenant en charge les transports locaux (stdio) et distants (HTTP/SSE) pour une intégration transparente entre les écosystèmes.

- Les benchmarks des premiers adoptants montrent une réduction allant jusqu'à 80 % du temps de développement d'intégration, permettant aux agents d'IA d'accéder à un contexte en temps réel depuis GitHub, des bases de données, des calendriers et plus, sans code personnalisé pour chaque plateforme.

- MCP complète des protocoles comme A2A (Agent-to-Agent) en se concentrant sur l'intégration verticale d'outils, alimentant une IA véritablement agentielle tout en maintenant une sécurité stricte grâce à OAuth 2.1, PKCE et des flux de consentement par client.

- D'ici 2026, MCP est pris en charge dans Claude, ChatGPT, VS Code, Cursor et des dizaines d'outils d'entreprise, avec des serveurs pré-configurés pour Google Drive, Slack, Postgres et plus — faisant des extensions d'IA plug-and-play une réalité.

Qu'est-ce que le Model Context Protocol (MCP) ?

Le Model Context Protocol (MCP) est une norme ouverte qui standardise la manière dont les applications d'IA se connectent à des systèmes externes. Introduit par Anthropic et rapidement adopté par l'industrie, le MCP permet aux grands modèles de langage et agents d'IA de lire des données de manière sécurisée, d'exécuter des outils et de suivre des flux de travail spécialisés en temps réel.

Considérez le MCP comme le port USB-C pour l'IA. Tout comme l'USB-C fournit un connecteur universel pour la charge, le transfert de données et la sortie vidéo entre les appareils, le MCP offre un protocole unique permettant aux clients d'IA de découvrir et d'interagir avec n'importe quel serveur compatible — éliminant le besoin d'intégrations sur mesure.

Le problème que résout le MCP

Les intégrations d'IA traditionnelles souffrent de fragmentation. Chaque source de données ou outil nécessite du code personnalisé, une logique d'authentification et une maintenance dédiée. Cela crée des silos de données, augmente les coûts de développement et limite les agents d'IA à des connaissances statiques figées.

L'analyse des implémentations pré-MCP montre que les entreprises passaient des mois à construire des connecteurs individuels pour Slack, GitHub ou des bases de données internes. Le MCP remplace cela par une interface standardisée, permettant aux systèmes d'IA de maintenir le contexte entre les outils et de fournir des réponses plus précises et exploitables.

Plongée en profondeur : Architecture MCP et fonctionnement

MCP suit une architecture claire à trois niveaux :

- Hôte MCP : L'application d'IA (par ex. Claude Desktop, VS Code avec Copilot, ou un framework d'agent personnalisé).

- Client MCP : Le composant à l'intérieur de l'hôte responsable de la découverte, de la connexion et de l'invocation des serveurs.

- Serveur MCP : Le fournisseur exposant des outils, ressources ou invites (processus stdio local ou point de terminaison HTTP distant).

La communication s'effectue via JSON-RPC 2.0 avec des sessions étatiques. Les serveurs annoncent leurs capacités lors de la négociation, incluant les primitives supportées :

- Ressources : Accès en lecture/écriture aux fichiers, bases de données ou documents.

- Outils : Fonctions exécutables avec effets de bord (par ex., envoyer un email, créer une branche Git).

- Invites : Modèles de flux de travail réutilisables pour des tâches spécialisées.

Les options de transport incluent stdio local pour la sécurité sur poste de travail et HTTP avec Server-Sent Events (SSE) pour un usage distant en production. Les sessions prennent en charge les réponses en flux continu pour les opérations longues.

Voici un exemple simplifié de requête de découverte des capacités :

{

"jsonrpc": "2.0",

"method": "initialize",

"params": {

"protocolVersion": "2024-11-25",

"clientInfo": {"name": "Claude Desktop", "version": "1.0"}

},

"id": 1

}

Le serveur répond avec les outils supportés, les ressources et les exigences d'autorisation.

Cas d'usage réels et succès

Les retours de la communauté et les déploiements en entreprise soulignent la polyvalence de MCP :

- Assistants personnalisés : Les agents récupèrent des données en direct depuis Google Calendar et Notion pour planifier des réunions ou résumer des notes automatiquement.

- Flux de travail développeurs : Des outils comme Cursor et VS Code utilisent des serveurs MCP connectés à des dépôts Git et des maquettes Figma pour générer des applications web complètes en une seule session.

- Analytics d'entreprise : Des chatbots interrogent de multiples bases de données internes de manière sécurisée, permettant aux utilisateurs non techniques d'exécuter des analyses SQL complexes via le langage naturel.

- Automatisation créative : Des serveurs MCP contrôlant Blender génèrent des modèles 3D et déclenchent des imprimantes 3D à partir d'invites textuelles.

Les premiers adoptants, dont Block et Apollo, rapportent des cycles de déploiement d'agents significativement plus rapides.

MCP face à l'appel d'outil traditionnel, A2A, et autres protocoles

MCP n'est pas un remplacement pour tous les modèles d'intégration d'IA — il excelle dans un domaine critique : l'accès standardisé au contexte et aux outils.

- Contre l'appel de fonction traditionnel : Les schémas d'outils personnalisés doivent être redéfinis pour chaque modèle et plateforme. Les serveurs MCP sont construits une fois et fonctionnent partout.

- Contre A2A (Agent-to-Agent Protocol) : A2A gère la communication horizontale entre agents pour la délégation de tâches. MCP se concentre sur les connexions verticales vers les systèmes externes. De nombreuses configurations en production combinent les deux pour des flux de travail agentiques complets.

- Contre les API personnalisées : MCP ajoute la découverte, la négociation des capacités, le streaming et une autorisation unifiée — des fonctionnalités absentes des points de terminaison REST ad hoc.

La spécification du protocole positionne explicitement MCP comme la couche d'adaptation universelle manquante pour l'IA agentique.

Avantages de l'adoption du MCP

- Développeurs : Développez une fois, intégrez partout — réduisant considérablement la charge de maintenance.

- Plateformes d'IA : Bénéficiez d'un accès instantané à un écosystème en expansion de serveurs sans avoir à concevoir de nouveaux connecteurs.

- Utilisateurs finaux : Recevez des réponses plus pertinentes, adaptées au contexte, et des actions autonomes de leurs outils d'IA.

Les métriques d'adoption de 2026 montrent que les agents compatibles MCP réduisent les taux d'hallucination en fournissant des données en direct et améliorent la précision de l'accomplissement des tâches de plus de 40% dans les scénarios complexes.

Commencer : Créer et utiliser le MCP

Pour les utilisateurs finaux : Installez des serveurs pré-construits directement via Claude Desktop ou Cursor. Connectez des outils locaux comme Git ou des systèmes de fichiers en quelques minutes.

Pour les développeurs : Le dépôt GitHub officiel fournit des SDK dans plusieurs langages. Un serveur MCP Python basique peut être mis en place avec seulement quelques dizaines de lignes de code pour exposer des fonctions personnalisées.

Les implémentations avancées prennent en charge l'hébergement distant avec des flux OAuth 2.1 complets pour les environnements de production.

Considérations de sécurité et bonnes pratiques

La sécurité est intégrée à la spécification MCP. Les exigences clés incluent :

- OAuth 2.1 avec PKCE pour tous les transports HTTP.

- Des flux de consentement par client pour prévenir les attaques par délégation confuse.

- Une portée de privilèges minimum et des jetons à durée de vie courte.

- La prise en charge des serveurs mandataires qui délèguent à des API tierces tout en conservant des journaux d'audit.

Les audits de sécurité de 2026 soulignent l'importance d'activer le TLS mutuel pour les connexions distantes et d'appliquer une validation rigoureuse des annonces des serveurs pour éviter les risques liés à la chaîne d'approvisionnement.

Pièges courants et astuces avancées

Pièges à éviter :

- Des autorisations trop larges conduisant à une exposition involontaire des données.

- Négliger l'interface de consentement dans les clients de bureau, causant une friction utilisateur.

- Utiliser des transports stdio non chiffrés en dehors des environnements de confiance.

Astuces avancées :

- Implémentez le streaming pour les opérations de longue durée comme la génération de code ou l'analyse de données.

- Orchestrez plusieurs serveurs dans une seule session pour des flux de travail complexes (par exemple, GitHub + base de données + notification).

- Exploitez la négociation de capacités pour dégrader élégamment les fonctionnalités sur les clients plus anciens.

Les cas particuliers tels que les serveurs distants à haute latence ou les outils locaux fonctionnant en mode déconnecté sont gérés via la reprise de session et des mécanismes de repli définis dans la spécification.

L'avenir du MCP dans l'écosystème de l'IA

À partir de 2026, le MCP continue d'évoluer avec les contributions de la communauté. Les améliorations à venir incluent une prise en charge plus riche des ressources multimodales et une intégration plus étroite avec les nouveaux frameworks d'orchestration d'agents. Les principales plateformes se sont engagées envers la norme, positionnant le MCP comme la couche fondamentale pour la prochaine génération d'IA consciente du contexte et capable d'agir.

Conclusion

MCP transforme l'intelligence artificielle de simples chatbots isolés en agents connectés et compétents, capables de comprendre vos données et d'agir en votre nom. Que vous soyez un utilisateur individuel, un développeur ou un architecte d'entreprise, adopter MCP débloque un nouveau niveau d'intelligence et de productivité.

Commencez à explorer dès aujourd'hui sur le site officiel de la documentation et expérimentez avec les serveurs préconstruits pour constater la différence par vous-même. L'ère d'une IA véritablement intégrée est arrivée.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Qu'est-ce qu'OC Maker ? L'outil d'IA révolutionnant la création de personnages originaux en 2026

Google Investit Jusqu'à 40 Milliards de Dollars dans Anthropic avec un Soutien de 5 GW de Puissance Informatique : La Course à l'IA Entre dans une Nouvelle Ère

Trae IDE GPT-5.4 est-il gratuit ? Analyse des tarifs 2026, limites et guide pour développeurs

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.