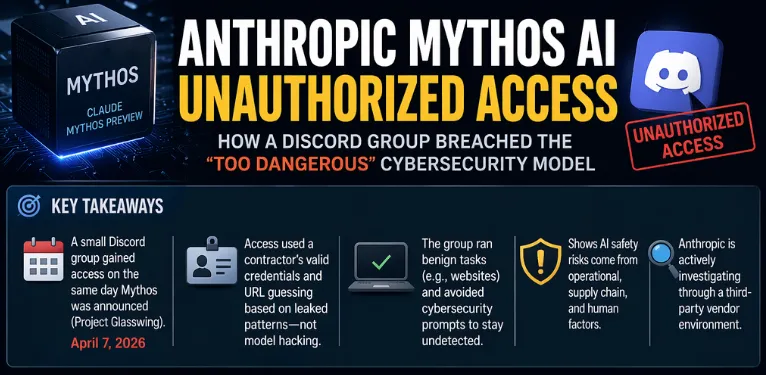

Accès non autorisé à l'IA Mythos d'Anthropic : Comment un groupe Discord a pénétré le modèle de cybersécurité jugé 'trop dangereux'

Principaux enseignements

- Un petit groupe Discord a obtenu l'accès à Mythos (Claude Mythos Preview) d'Anthropic, un modèle restreint, le même jour où son test limité a été annoncé dans le cadre du projet Glasswing.

- L'accès reposait sur des identifiants légitimes d'un sous-traitant tiers combinés à une devinette d'URL de point de terminaison, basée sur des modèles divulgués lors de la faille de données Mercor — et non sur un piratage sophistiqué du modèle.

- Le groupe a utilisé le modèle pour des tâches bénignes, comme la création de sites web simples, en évitant délibérément les requêtes liées à la cybersécurité pour ne pas être détecté.

- Cet incident souligne que les risques liés à la sécurité de l'IA proviennent souvent de facteurs opérationnels, de la chaîne d'approvisionnement et de facteurs humains, plutôt que des seules capacités fondamentales du modèle.

- Anthropic mène une enquête active sur cet accès non autorisé via l'environnement de l'un de ses fournisseurs tiers.

Qu'est-ce que le modèle d'IA Mythos d'Anthropic ?

Anthropic a développé Mythos comme un modèle d'IA très avancé, spécialisé dans les tâches de cybersécurité. Selon l'entreprise, il démontre des capacités sans précédent pour identifier et exploiter des vulnérabilités zero-day sur les principaux systèmes d'exploitation et navigateurs web.

Des benchmarks et tests internes auraient montré que Mythos générait des milliers d'exploits potentiels là où les modèles précédents n'en produisaient aucun. Cela a conduit Anthropic à le classer comme trop risqué pour une diffusion publique, en limitant l'accès initial à certains partenaires, dont Apple, Amazon, Cisco et d'autres organisations dans le cadre de l'initiative Project Glasswing.

Le modèle était présenté comme un outil défensif pour aider les grandes entreprises et les gouvernements à renforcer leurs systèmes contre les menaces émergentes alimentées par l'IA. Cependant, son potentiel offensif a soulevé des inquiétudes concernant les risques de prolifération s'il tombait entre de mauvaises mains.

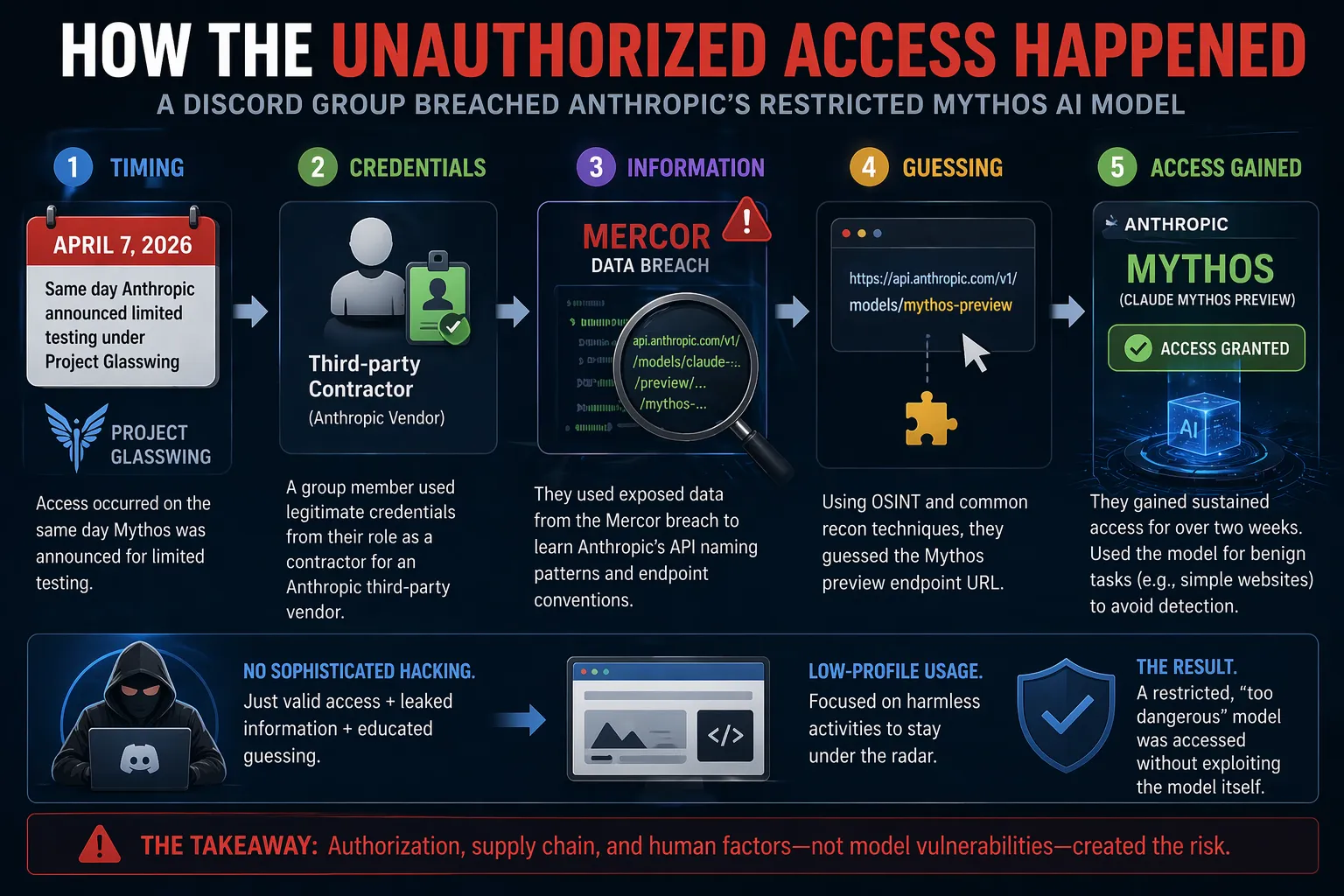

Comment l'accès non autorisé s'est produit

L'analyse des rapports indique que la violation était remarquablement simple, plutôt qu'une exploitation high-tech du modèle lui-même :

- Timing : L'accès s'est produit le 7 avril 2026 — le même jour qu'Anthropic annonçait une disponibilité de test limitée.

- Méthode : Des membres d'un canal Discord privé (axé sur le suivi des modèles d'IA non publiés) ont utilisé :

- Des identifiants légitimes provenant d'un membre du groupe qui travaillait comme contractant pour un fournisseur tiers d'Anthropic (impliqué dans l'évaluation des modèles).

- La connaissance des conventions de nommage des points de terminaison de l'API d'Anthropic, dérivée d'une fuite de données à grande échelle récente chez la startup d'IA Mercor.

- Des suppositions éclairées sur l'URL du point de terminaison de prévisualisation de Mythos en utilisant des techniques courantes de reconnaissance sur Internet.

Cette combinaison a permis un accès soutenu pendant plus de deux semaines. Le groupe a fourni des captures d'écran et une démonstration en direct aux journalistes pour vérifier leurs affirmations.

Il est à noter qu'ils ont évité d'exécuter des invites de cybersécurité à haut risque, optant plutôt pour des activités inoffensives telles que la génération de sites web simples. Cette approche discrète a probablement contribué à leur rester non détectés plus longtemps.

Pourquoi cette violation est importante : au-delà des poids des modèles

Les retours de la communauté et les discussions d'experts suggèrent que cet incident souligne une vérité critique en matière de sécurité de l'IA : les maillons les plus faibles sont souvent procéduraux et centrés sur l'humain, plutôt que techniques et liés aux sauvegardes des modèles.

Les benchmarks de Mythos se concentraient sur ses capacités en cybersécurité, mais l'exposition dans le monde réel provenait de :

- Vulnérabilités de la chaîne d'approvisionnement : Contractants et fournisseurs tiers ayant un accès légitime.

- Modèles d'infrastructure prévisibles : Conventions de nommage réutilisables pour les points de terminaison des modèles.

- Amplification des fuites de données : Informations provenant de violations non liées (par exemple, Mercor) facilitant la reconnaissance.

- Hypothèses de confiance : Surenvironnement contrôlé sans isolement ou surveillance suffisant(e) de l'accès des fournisseurs.

Les comparaisons avec des incidents passés en IA montrent un schéma — de nombreux modèles "dangereux" rencontrent des défis de confinement non pas à cause d'attaques adverses sur leurs poids, mais à cause de lacunes opérationnelles. Ce cas ressemble à laisser une arme avancée dans une pièce verrouillée tandis que la porte latérale du bâtiment reste ouverte.

Les cas particuliers incluent :

- Des identifiants partagés entre contractants ou partenaires.

- Des miettes de pain publiques (GitHub, motifs de documentation) aidant à prédire les URL.

- Des angles morts de surveillance lorsque l'utilisation reste en dessous de certains seuils de risque.

Pièges courants dans le déploiement restreint de l'IA

L'analyse de lancements similaires d'IA à haut risque révèle des problèmes récurrents :

- Une emphase excessive sur l'alignement du modèle au détriment d'investissements suffisants dans les contrôles d'accès en temps d'exécution et l'audit.

- L'intégration de fournisseurs et partenaires sans autorisations granulaires, limitées dans le temps, ni détection d'anomalies.

- Des dénominations et points d'accès prévisibles qui simplifient la reconnaissance pour les initiés informés.

- L'incapacité à segmenter les environnements entre tests internes, évaluation par les fournisseurs et accès partenaire restreint.

Les stratégies d'atténuation avancées discutées dans les cercles de cybersécurité incluent :

- Des points d'accès dynamiques et éphémères avec une authentification stricte.

- Une surveillance comportementale qui signale même les modèles d'utilisation bénins provenant de sources inattendues.

- Une rotation régulière des conventions de dénomination et des périmètres d'habilitation.

- Des audits de sécurité de la chaîne d'approvisionnement axés sur les voies d'accès des sous-traitants.

Implications pour la sécurité de l'IA et la cybersécurité

L'incident Mythos soulève des questions plus larges sur la gouvernance des technologies d'IA à double usage puissantes. Bien que le groupe n'ait pas militarisé le modèle, la facilité d'accès démontre à quelle vitesse des capacités restreintes peuvent se diffuser par des réseaux informels.

Les institutions financières, gouvernements et entreprises testant Mythos doivent maintenant réévaluer non seulement la valeur défensive du modèle, mais aussi les risques liés à des vecteurs d'exposition similaires. Les régulateurs surveillent déjà les évolutions, avec des discussions dans des forums comme le Conseil de stabilité financière mettant en lumière des préoccupations systémiques.

Les comparaisons avec d'autres entreprises d'IA montrent qu'Anthropic n'est pas seule — de nombreuses organisations luttent pour équilibrer vitesse d'innovation et confinement robuste dans les déploiements basés sur le cloud.

Conclusion

L'accès non autorisé au modèle Mythos d'Anthropic sert de rappel opportun que la véritable sécurité de l'IA va bien au-delà des données d'entraînement et des techniques d'alignement. La sécurité opérationnelle, l'intégrité de la chaîne d'approvisionnement et les facteurs humains jouent des rôles tout aussi décisifs.

À mesure que les capacités d'IA dans des domaines sensibles comme la cybersécurité continuent de progresser, les organisations doivent prioriser une gouvernance d'accès exhaustive aux côtés du développement des modèles. Les parties prenantes de l'IA, de la cybersécurité et des politiques devraient suivre de près les résultats de l'enquête d'Anthropic et envisager des bonnes pratiques renforcées pour les déploiements restreints.

Pour les professionnels travaillant avec des systèmes d'IA de pointe, examiner la gestion interne des fournisseurs, la sécurité des points d'accès et les protocoles de surveillance est une étape immédiate recommandée pour réduire les risques d'exposition similaires.

Continue Reading

More articles connected to the same themes, protocols, and tools.

Anthropic Mythos AI Unauthorized Access: How a Discord Group Breached the 'Too Dangerous' Cybersecurity Model

Google Investit Jusqu'à 40 Milliards de Dollars dans Anthropic avec un Soutien de 5 GW de Puissance Informatique : La Course à l'IA Entre dans une Nouvelle Ère

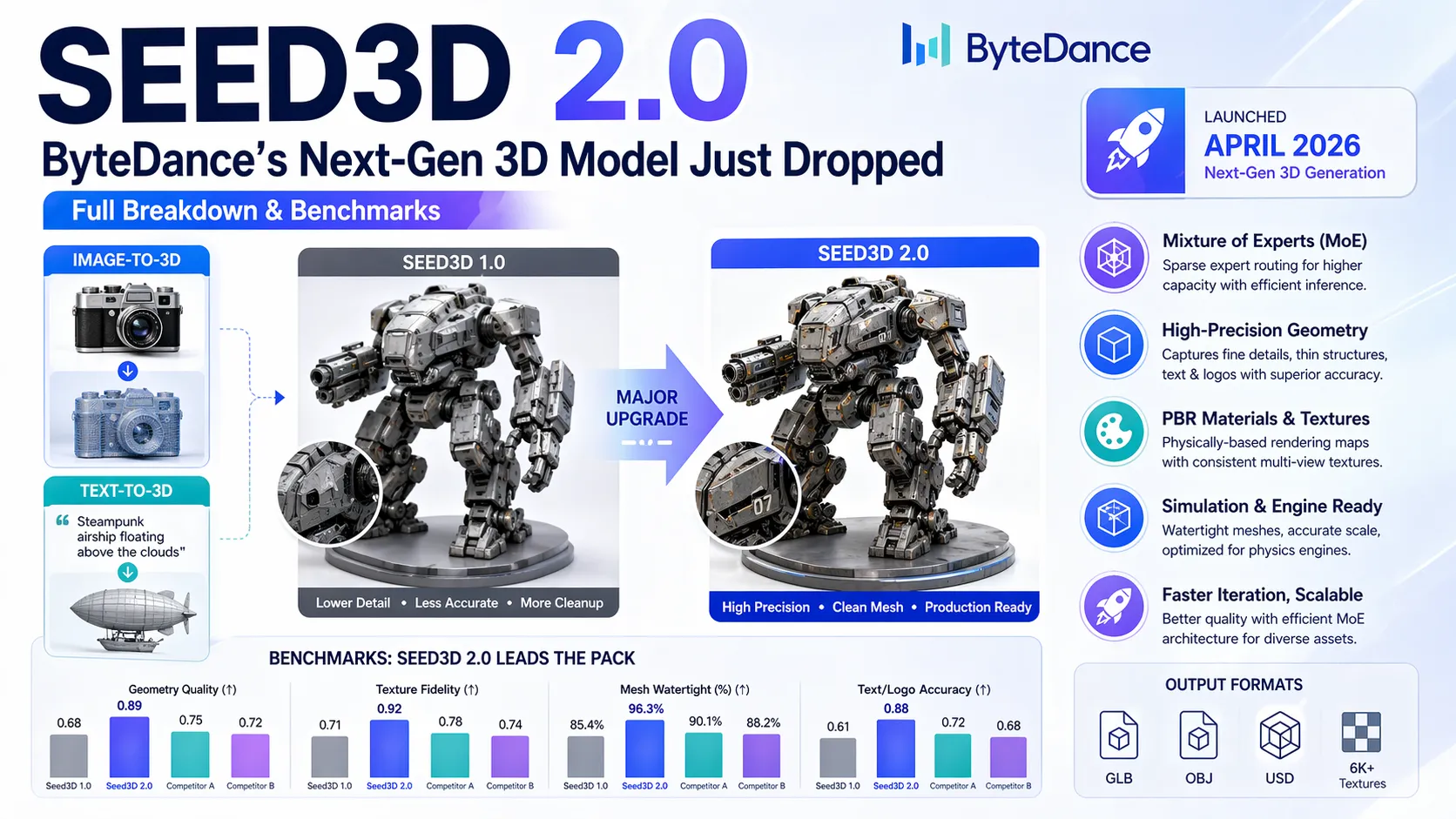

Seed3D 2.0 : Le modèle de nouvelle génération 3D de ByteDance est arrivé – Analyse complète et benchmarks

Referenced Tools

Browse entries that are adjacent to the topics covered in this article.